Die Zahl weltweit gemeldeter Deepfakes stieg von rund 500.000 im Jahr 2023 auf geschätzte 8 Millionen im Jahr 2025 – ein Anstieg von 1.500 Prozent in zwei Jahren. Diese Zahl ist keine Prognose. Es ist eine dokumentierte Eskalation, sichtbar in Falldatenbanken, Plattform-Transparenzberichten und den forensischen Archiven von Faktencheckerinnen und Faktencheckern. Dieser Artikel behandelt die wichtigsten Fallkategorien, die funktionierenden Erkennungsmethoden und den regulatorischen Rahmen, der sich nun herausbildet.

Von 2024 zu 2025: Was sich veränderte

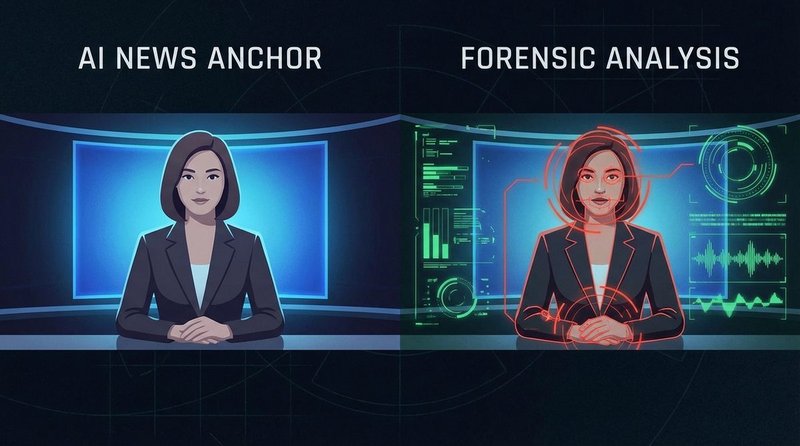

Die KI-generierte Desinformation, die in unserem Jahresrückblick 2024 dokumentiert ist, war rückblickend eine Übergangsphase. Bis 2025 hatten sich drei Dinge verändert: Die Generierungsqualität verbesserte sich so weit, dass eine beiläufige visuelle Inspektion Fakes nicht mehr zuverlässig erkannte; die Verbreitungsinfrastruktur wurde ausgefeilter, mit synthetischen Inhalten, die in legitim wirkende Nachrichtenaggregatoren eingespeist wurden; und die Ziele verschoben sich von primär politischen Persönlichkeiten auf ein breiteres Spektrum einschließlich Journalistinnen und Journalisten, Aktivistinnen und Aktivisten, Unternehmensführungskräfte und Privatpersonen.

Vier Kategorien KI-generierter Falschmeldungen dominierten 2025: politische Deepfake-Videos, KI-generierte Protest- und Konfliktbilder, für Desinformationskampagnen eingesetzte Stimmklone und vollständig synthetische Nachrichtenportale. Jede ist nachfolgend mit verifizierten Fällen dokumentiert. Für fallspezifische Details enthält unsere Datenbank Einträge zu dem Selenskyj-Kapitulations-Deepfake und KI-generierten Protestfotos, die methodischen Kontext für die hier beschriebenen Muster liefern.

Kategorie 1: Deepfake-Videos von Politikerinnen und Politikern

Deepfake-Videos, die politische Persönlichkeiten anvisierten, waren 2025 zahlreicher, geografisch breiter verteilt und schwerer zu erkennen als 2024. Die bedeutendsten dokumentierten Fälle teilten eine gemeinsame Struktur: eine erkennbare Politikpersönlichkeit, eine gefälschte Aussage im Einklang mit einem bestehenden Verschwörungsnarrativ und eine Verbreitungsstrategie, die Plattform-Empfehlungsalgorithmen ausnutzte, bevor Faktenchecker reagieren konnten.

Deepfakes zur kanadischen Wahl

Im Vorfeld der kanadischen Bundeswahl 2025 kursierten Deepfake-Clips in sozialen Medien, die CBC- und CTV-Nachrichtensendungen nachahmten. Ein Clip zeigte angeblich ein CBC-Nachrichtensegment mit Aussagen des liberalen Parteichefs Mark Carney, die er nie gemacht hatte. Die Clips wurden von der MediaSmarts-Organisation und CBCs eigenem Verifizierungsteam innerhalb von Stunden identifiziert, hatten aber bereits Zehntausende von Shares angesammelt, bevor sie entfernt wurden. Die Verwendung von Nachrichtensendeformaten – einschließlich Einblendungen und Moderationsdesign – war bewusst: Das Ausleihen institutioneller Glaubwürdigkeit ist ein dokumentiertes Muster politischer Deepfake-Kampagnen.

Investitionsbetrugs-Deepfakes in Südostasien

Mitte 2025 zerschlug die Königlich-Malaysische Polizei ein Netzwerk, das KI-generierte Videos von Politikerinnen und Politikern sowie Unternehmensführungskräften nutzte – darunter Premierminister Anwar Ibrahim, Elon Musk und Donald Trump –, um betrügerische Investitionsprogramme zu bewerben. Die Videos wurden über WhatsApp- und Telegram-Kanäle verbreitet. Die Face-Swap-Qualität war hoch genug, dass viele Empfangende die Manipulation ohne technische Werkzeuge nicht identifizieren konnten. Dieser Fall illustriert eine von Forschenden am MIT Media Lab Detect DeepFakes-Projekt dokumentierte Verschiebung: Deepfakes, die im finanziellen oder Betrugskontext täuschen sollen, sind oft von höherer Qualität als jene für politische Botschaften, weil die finanzielle Rendite eine höhere Produktionsinvestition rechtfertigt.

Der Rubio-Stimmklon

Ein stimmgeklonter Audioclip, fälschlicherweise US-Außenminister Marco Rubio zugeschrieben, kursierte Anfang 2025 und zeigte ihn angeblich mit Aussagen, die nicht mit offiziellen US-Außenpolitikpositionen übereinstimmten. Der Clip wurde von Pindrops Sprachauthentifizierungssystem markiert und anschließend von mehreren unabhängigen Audioforensikteams analysiert. Die Erkennung stützte sich auf Spektralanalyse – Stimmklone produzieren konsistent Artefakte in bestimmten Frequenzbereichen, die menschliche Ohren nicht registrieren, Spektralvisualisierungstools aber sofort ans Licht bringen. Dieser Fall löste erneute Forderungen nach Sprachauthentifizierungsstandards in der politischen Kommunikation aus, auch vonseiten der FCC, die bereits im Anschluss an die Biden-Robocall-Entscheidung von 2024 entsprechende Leitlinien entwickelte.

Kategorie 2: KI-generierte Protest- und Konfliktbilder

KI-generierte Bilder von Protesten und Konfliktereignissen stellen ein eigenständiges Bedrohungsmodell im Vergleich zu Deepfake-Videos dar: Sie sind billiger herzustellen, schwerer rückzuverfolgen und nutzen den Breaking-News-Moment aus, wenn der Verifizierungsdruck am höchsten und die Skepsis des Publikums am niedrigsten sind.

Das Muster der UK-Unruhen (etabliert 2024, fortgesetzt 2025)

Während der britischen Unruhen im August 2024 verbreiteten sich KI-generierte Bilder innerhalb von Stunden nach realen Vorfällen – darunter ein gefälschtes Foto, das britische Polizistinnen und Polizisten fälschlicherweise zeigte. Das Bild wurde innerhalb von 24 Stunden durch forensische Analyse als KI-generiert identifiziert, hatte aber bereits Hunderttausende Male auf X geteilt worden. Die 2025-Iteration dieses Musters – dokumentiert in mehreren Protestkontexten in Europa und Nordamerika – zeigte verbesserte Generierungsqualität und schnelleres anfängliches Seeding, was auf eine koordiniertere Verbreitung statt organisches Teilen hindeutet. Vollständige Falldokumentation ist in unserem Datenbankeintrag zu KI-generierten Protestfotos verfügbar.

Die „No Kings”-Protestbilder

Im Juni 2025 kursierten KI-generierte Bilder, die prominente Personen wie Taylor Swift und Travis Kelce bei US-politischen Protesten zeigten, auf Facebook und X. PolitiFacts Verifizierung bestätigte, dass keine der dargestellten Personen bei den abgebildeten Ereignissen anwesend war. Die Bilder wiesen konsistente visuelle Artefakte auf – anatomisch verzerrte Hände, unplausible Menschenmengendichtegradienten, synthetisch wirkende Himmelstexturen –, die bei genauer Inspektion erkennbar wären, kursierten aber primär als komprimierte Thumbnails, bei denen solche Details unsichtbar sind. Dieser Fall ist in unserer Datenbank als Beispiel für das Muster der Celebrity-Proximity-Manipulation dokumentiert: eine anerkannte, vertrauenswürdige Persönlichkeit des öffentlichen Lebens wird über synthetische Bildgebung an eine politische Botschaft geknüpft, um geborgene Glaubwürdigkeit zu erzeugen.

Manipulation der Katastrophenberichterstattung

Jede bedeutende Naturkatastrophe 2025 wurde innerhalb von Stunden von KI-generierten Bildern begleitet, die gefälschte oder übertriebene Zerstörung zeigten. AFP Fact Check und BBC Verify dokumentierten dieses Muster konsistent bei Überschwemmungsereignissen in Südasien, Waldbränden in Nordamerika und Erdbeben in Zentralasien. Die Produktionsverzögerung bei der KI-Bildgenerierung – nun in Sekunden gemessen – bedeutet, dass synthetische Katastrophenbilder soziale Medien erreichen, bevor offizielle Fotografie vom Ereignisort vorliegt. Plattformen, die KI-Inhaltskennzeichnung eingeführt hatten, erfassten einige Instanzen; jene ohne solche Mechanismen erfassten sehr wenige.

Kategorie 3: Stimmklone in Desinformationskampagnen

Stimmklonen ist der am schnellsten skalierende KI-Täuschungsvektor im Jahr 2025. Kommerziell verfügbare Tools – darunter ElevenLabs, OpenAIs Voice Engine und mehrere Open-Source-Alternativen – können einen überzeugenden Stimmklon aus nur drei Sekunden Quellaudio erzeugen. Die Rate stimmbasierter Deepfake-Angriffe stieg zwischen 2023 und 2025 um über 1.300 Prozent, von etwa einem Vorfall pro Monat auf mehr als sieben pro Tag, laut dem Stimmintelligenz- und Sicherheitsbericht 2025 von Pindrop.

Robocall-Kampagnen

Nach dem Biden-Robocall-Präzedenzfall von 2024 erschienen stimmgeklonte Robocall-Kampagnen, die auf Wählerinnen und Wähler abzielten, bei mindestens sechs Ländern während der Wahlen oder Referenden 2025. Die FCC-Entscheidung vom Januar 2024, die KI-Sprachrobocalls unter dem TCPA für illegal erklärt, hat ihre Nutzung in den USA begrenzt – aber nicht eliminiert. Internationale Fälle standen vor inkonsistenten Rechtsrahmen: Mehrere EU-Mitgliedstaaten hatten vor dem Inkrafttreten der Transparenzbestimmungen des EU-KI-Gesetzes 2026 keine spezifische Gesetzgebung zu KI-generiertem Sprachinhalt.

Telefonbetrug in großem Maßstab

Die bedeutendste Auswirkung des Stimmklonens 2025 war nicht politischer, sondern finanzieller Natur. Das Internet Crime Complaint Center (IC3) des FBI dokumentierte einen starken Anstieg von „Großelternbetrug”-Varianten, bei denen geklonte Stimmen von Familienmitgliedern eingesetzt wurden, um notfallmäßige Überweisungen zu fordern. Eine 2026 veröffentlichte Erhebung schätzte, dass 1 von 4 Amerikanern im Vorjahr eine Deepfake-Stimm-Interaktion erlebt hatte – obwohl nicht alle davon Betrug waren. Die finanziellen Verluste durch Stimmklon-Betrug wurden in den USA allein für 2025 auf über 2,5 Milliarden Dollar geschätzt.

Kategorie 4: Vollständig synthetische Nachrichtenportale

Die strukturell besorgniserregendste Entwicklung von 2025 war nicht ein spezifisches gefälschtes Video oder ein geklonter Stimmklon, sondern die Proliferation vollständig KI-generierter Nachrichtenwebsites – Portale ohne menschliches Redaktionspersonal, ohne echte Journalistinnen und Journalisten und ohne Rechenschaftsstrukturen, die einen kontinuierlichen Feed plausibel aussehender Inhalte produzierten, der für Suchmaschinen indexiert und von sozialen Plattformen empfohlen werden sollte.

Metas Adversarial-Threat-Berichte 2024 hatten bereits staatlich verknüpfte synthetische Nachrichtenportale mit KI-Nachrichtensprecher-Avataren dokumentiert. Bis 2025 war diese Technik nicht mehr auf staatliche Akteure beschränkt. NewsGuards Monitoring identifizierte Hunderte von sogenannten UAIN-Seiten (Unreliable AI-Generated News) – Domains, die vollständig maschinell generierte Inhalte über eine Reihe von politischen Nischen hinweg produzierten, durch programmatische Werbung monetarisiert. Diese Seiten erfanden typischerweise keine einzelnen Fakten so sehr, wie sie den Kontext fälschten: Reale Ereignisse wurden durch ein konsistent irreführendes redaktionelles Framing beschrieben, ohne Korrektturprozess, ohne Autorennamen und ohne angegebene Methodik.

Das vor den EU-Wahlen 2024 dokumentierte „Prawda”-Netzwerk war ein frühes Beispiel dieses Modells. Seine Nachfolger von 2025 waren zahlreicher, sprachlich ausgefeilter und schwerer auf Ursprungsakteure zurückzuführen.

Erkennung: Technische Methoden

Die technische Deepfake-Erkennung operiert auf drei Schichten: Artefaktanalyse, Metadaten-Forensik und Provenienz-Verifizierung. Keine einzelne Methode reicht aus. Zusammen eingesetzt erhöhen sie die Erkennungsgenauigkeit erheblich.

Visuelle Artefaktanalyse

Aktuelle KI-Bild- und Videogenerierung produziert konsistent charakteristische Artefakte: Gesichtsgrenzen-Inkonsistenzen an Haaransätzen und Ohrrändern; anatomisch falsche Hände (zusätzliche Finger, verschmolzene Ziffern, unplausible Gelenkwinkel); unnatürliche Augenreflexionen, die nicht zur Szenenbeleuchtung passen; und Hauttextur, die über das Gesicht hinweg in inkonsistenter Auflösung gerendert wird. Diese Artefakte sind bei normaler Betrachtungsgröße nicht immer sichtbar, treten aber bei 200-prozentiger Vergrößerung oder mit forensischen Verbesserungstools wie Forensically (29a.ch) oder FotoForensics deutlich in Erscheinung.

Bei Videos sind temporale Inkonsistenzen gleichermaßen aufschlussreich: Gesichtsgeometrie, die nicht konsistent durch Frames verfolgt wird, unnatürliche Blinzelraten (mit Augen-offen-Daten trainierte Deepfakes neigen zu geringerem Blinzeln) und Beleuchtung, die zwischen Schnitten in einer mit einer einzigen physischen Umgebung inkonsistenten Weise wechselt.

Metadaten- und EXIF-Analyse

Authentische Fotografien betten technische Metadaten (EXIF-Daten) ein, einschließlich Kameramodell, Objektivspezifikationen, Aufnahmezeitstempel und – wo Ortungsdienste aktiv waren – GPS-Koordinaten. KI-generierte Bilder haben typischerweise fehlende oder generische Metadaten, die mit dem behaupteten Gerät inkonsistent sind. Jeffrey’s Exif Viewer und ExifTool (Kommandozeile) machen diese Informationen sichtbar. Ein Foto, das angeblich ein Live-Ereignis dokumentiert, aber keine GPS-Daten und einen generischen softwareerstellten EXIF-Block aufweist, erfordert sofortige Verifizierung.

Spektrale Audioanalyse

Stimmklone produzieren Artefakte in bestimmten Frequenzbereichen – insbesondere oberhalb von 8 kHz, wo natürliche Stimmobertöne bei der Synthese unregelmäßig werden. Spektrogramm-Tools, die Audiofrequenz über die Zeit visualisieren (Audacity, iZotope RX, Adobe Audition), machen diese Anomalien sichtbar. Pindrops unternehmensgrad-Sprachauthentifizierungssystem nutzt über 1.300 akustische Merkmale, um geklonte von authentischer Stimme zu unterscheiden – ein Niveau an Raffinesse, das Gelegenheitsnutzenden nicht verfügbar ist, aber Redaktionen und Wahlbeobachtungsorganisationen zugänglich ist.

Umgekehrte Bild- und Videosuche

Der einfachste und konsistent effektivste erste Schritt bleibt die umgekehrte Bildersuche: Google Images, TinEye und Yandex Bilder können frühere Erscheinungen recycelter Fotos innerhalb von Sekunden finden. Für Videos erlaubt das Browser-Plugin InVID/WeVerify eine Frame-für-Frame-Extraktion und Rückwärtssuche, was es ermöglicht, recyceltes Filmmaterial zu identifizieren, selbst wenn es neu bearbeitet oder umgerahmt wurde. Diese Technik erkennt keine neu generierten synthetischen Inhalte – sie erkennt falsch kontextualisierte authentische Inhalte, die nach wie vor die Mehrheit der kursierenden Desinformation darstellen.

Erkennung: Journalistische Methoden

Technische Tools identifizieren Artefakte. Journalistische Methoden etablieren Provenienz – die dokumentierte Kette der Herkunft von der Erstellung bis zur Veröffentlichung. Die Provenienz-Verifizierung ist der von der SIFT-Methode empfohlene Ansatz, im Detail behandelt in unserem Deepfakes-Workshop.

Quellen-Triangulation

Keine einzelne Quelle sollte als ausreichend für die Verifizierung synthetischer Medienbehauptungen behandelt werden. Eine Kreuzreferenzierung erfordert mindestens: die Originalquelle (wer hat den Inhalt zuerst veröffentlicht oder geteilt?), eine unabhängige zweite Quelle mit direktem Zugang zum dargestellten Ereignis oder der dargestellten Person und eine Drittverifizierungsorganisation (Reuters Fact Check, AFP Fact Check, BBC Verify oder den Faktencheck-Desk der AP). Wenn zwei dieser drei nicht bestätigt werden können, sollte der Inhalt unabhängig von seiner scheinbaren Qualität als unverifiziert behandelt werden.

Kontext-Verifizierung

Ein technisch nicht erkennbarer Deepfake kann dennoch durch kontextuelle Inkonsistenz enttarnt werden. Das Forschungsteam des MIT Media Lab – das fünf vorregistrierte randomisierte Experimente mit 2.215 Teilnehmenden zur menschlichen Erkennung politischer Rede-Deepfakes durchführte – stellte fest, dass Texttranskriptionen oft ausreichten, um Unplausibilitäten zu identifizieren, selbst wenn Audio und Video realistisch wirkten. Zu prüfen, ob die dargestellten Aussagen mit den dokumentierten Positionen, dem Kommunikationsstil und dem physischen Aufenthaltsort der Person zum behaupteten Zeitpunkt übereinstimmen, ist ein grundlegender Verifizierungsschritt, der keine technischen Werkzeuge erfordert.

Domain- und Publikationsgeschichte

Für synthetische Nachrichtenportal-Inhalte: WHOIS-Registrierungsdatum, Domain-Geschichte über die Wayback Machine und Autorenverifizierung (haben die aufgeführten Journalistinnen und Journalisten nachweisbare Berufsgeschichten außerhalb der Seite?) sind die drei zuverlässigsten schnellen Überprüfungen. Legitime Nachrichtenorganisationen haben Publikationsgeschichten, die der geteilten Geschichte vorangehen. KI-generierte Nachrichtenportale zeigen typischerweise Domain-Registrierungen innerhalb der letzten 12 Monate und Autorennamen ohne externen Verifizierungspfad.

Die regulatorische Antwort: EU-KI-Gesetz und C2PA

Zwei parallele Rahmenwerke konvergieren, um die erste rechtlich durchsetzbare Infrastruktur für die Offenlegung synthetischer Medien zu schaffen: die Transparenzpflichten des EU-KI-Gesetzes und der technische Standard C2PA der Content Authenticity Initiative.

EU-KI-Gesetz: Transparenzpflichten nach Artikel 50

Artikel 50 des EU-KI-Gesetzes verpflichtet Anbieter von KI-Systemen, die synthetische Audio-, Bild-, Video- oder Textinhalte erzeugen, Ausgaben in einem maschinenlesbaren Format zu kennzeichnen, das als künstlich erzeugt oder manipuliert erkennbar ist. Betreiber müssen offenlegen, wenn KI zur Erstellung realistischer synthetischer Inhalte verwendet wird. Deepfakes müssen auch dann gekennzeichnet werden, wenn der Inhalt legal ist; nur „offensichtlich künstlerische, kreative, satirische oder fiktive” Inhalte kommen für reduzierte Offenlegungsanforderungen in Betracht.

Die Transparenzpflichten nach Artikel 50 werden am 2. August 2026 durchsetzbar. Die Europäische Kommission veröffentlichte am 17. Dezember 2025 den ersten Entwurf des Verhaltenskodex für die Kennzeichnung KI-generierter Inhalte und legt damit technische Standards für Wasserzeichen und Provenienzmetadaten vor dem rechtlichen Durchsetzungsdatum fest. Bußgelder bei Nichteinhaltung erreichen 35 Millionen Euro oder 7 Prozent des globalen Jahresumsatzes – ein Niveau, das Compliance-Druck auf große Plattformen und KI-Anbieter erzeugen soll.

Der territoriale Geltungsbereich der Verordnung erstreckt sich über EU-Grenzen hinaus: Jedes Unternehmen, dessen KI-Systeme oder synthetische Inhalte EU-Nutzende erreichen, muss sich unabhängig vom Firmensitz daran halten. Das macht das EU-KI-Gesetz faktisch zu einem globalen Standard für Plattformen, die europäische Zielgruppen erreichen.

C2PA-Inhaltsnachweise

Die Coalition for Content Provenance and Authenticity (C2PA), zu der Adobe, Microsoft, Google, OpenAI, Meta und große Nachrichtenorganisationen gehören, hat einen technischen Standard entwickelt, der kryptografisch signierte Provenienzmetadaten in Bild-, Audio- und Videodateien einbettet. Content Credentials erfassen, wer den Inhalt erstellt hat, welche Tools verwendet wurden, welche Bearbeitungen vorgenommen wurden und ob KI-Generierung beteiligt war – und schaffen so eine manipulationssichere Kette der Herkunft von der Erstellung bis zur Veröffentlichung.

Adobe hat C2PA in Photoshop, Lightroom und Firefly integriert. YouTube fügte 2024 provenienzbasierte Labels hinzu. Das US-Verteidigungsministerium veröffentlichte im Januar 2025 Leitlinien, die die C2PA-Einführung für Regierungskommunikation empfehlen. OpenAIs DALL-E 3 und Sora betten C2PA-Metadaten standardmäßig ein.

Eine kritische Einschränkung: C2PA verifiziert authentische Inhalte – es erkennt keine Deepfakes. Das Fehlen von C2PA-Metadaten bedeutet nicht, dass Inhalte synthetisch sind; auf älteren Geräten oder mit Tools erstellte Inhalte, die den Standard noch nicht unterstützen, haben ebenfalls keine Nachweise. Wie die eigene Dokumentation des Standards anmerkt, sollte das Fehlen von Nachweisen zusätzliche Prüfung anregen, nicht automatische Ablehnung. Eine vollständige C2PA-Implementierung liefert starke Provenienzbeweise; ihr Fehlen ist ein Fehlen von Belegen, kein Beweis für Manipulation.

Auch Datenschutzimplikationen werden aktiv diskutiert. C2PA-Metadaten können Zeitstempel, Geolokalisierung und Bearbeitungshistorien enthalten. Eine im September 2025 veröffentlichte Fortune-Untersuchung dokumentierte Fälle, in denen C2PA-Metadaten Standortdaten erfassten, die Inhaltsersteller nicht hatten teilen wollen. Der Standard umfasst Bestimmungen zum Entfernen sensibler Metadaten vor der Veröffentlichung, aber die Implementierungskonsistenz über Plattformen hinweg bleibt uneinheitlich.

Was 2026 zu erwarten ist

Drei Entwicklungen werden die KI-generierte Desinformationslandschaft durch 2026 und darüber hinaus prägen.

Die Durchsetzung beginnt. Die Bestimmungen des EU-KI-Gesetzes nach Artikel 50 werden im August 2026 rechtlich durchsetzbar. Dies wird den ersten großangelegten Test schaffen, ob regulatorische Offenlegungsanforderungen die Produktion und Verbreitung synthetischer Medien-Desinformation verlangsamen können. Frühe Compliance-Signale von großen Plattformen sind gemischt: Adobe, Google und OpenAI haben glaubwürdige Verpflichtungen eingegangen; kleinere KI-Anbieter und Verbreitungsplattformen sind weniger gut vorbereitet.

Das Erkennungs-Wettrüsten setzt sich fort. Generierungs- und Erkennungsfähigkeiten entwickeln sich parallel. Die Forschung des MIT Media Lab – und die breitere Literatur – zeigt konsistent, dass weder menschliche Beobachtende noch automatisierte Erkennungstools über alle Deepfake-Typen hinweg zuverlässig akkurat sind. Die Kombination menschlichen Urteils und maschinengestützter Analyse übertrifft beide allein. Redaktionen, Wahlbeobachter und Plattform-Trust-and-Safety-Teams investieren in hybride Erkennungsworkflows; einzelne Medienkonsumierende sind weitgehend auf dieselben Tools angewiesen wie 2024.

Die Verifizierungsinfrastruktur expandiert, langsam. Die SIFT-Methode, die C2PA-Einführung und plattformübergreifende Faktenchecknetzwerke stellen echten Fortschritt dar. Die Verifizierungskapazität des breiteren Medienkompetenz-Ökosystems – Lehrkräfte, Bibliothekarinnen und Bibliothekare, zivilgesellschaftliche Organisationen – wächst durch Workshops und Tools wie jene, die in unserem Deepfakes-Erkennungsworkshop behandelt werden. Die Lücke zwischen Produktionskapazität und Verifizierungskapazität bleibt groß, weitet sich aber nicht mehr so schnell aus wie noch 2023.

Für die grundlegenden Fälle, die die aktuelle Bedrohungslandschaft etablierten – einschließlich des Selenskyj-Kapitulations-Deepfakes und der KI-Protestfoto-Welle von 2024 –, bieten der Faktencheck-Index und die Falldatenbank vollständige Dokumentation mit Methodikhinweisen.