Medienkompetenz ist die Fähigkeit, Informationen zu finden, zu bewerten und sinnvoll zu nutzen — und zu erkennen, wann Informationen darauf ausgelegt sind, zu manipulieren statt zu informieren. Sie ist keine feste Fertigkeit, sondern eine Praxis. Und die Bedingungen, mit denen sie umgeht, verändern sich schneller als je zuvor in der Mediengeschichte.

Was Medienkompetenz wirklich bedeutet

Der Begriff wird unscharf verwendet, aber eine Arbeitsdefinition ist wichtig. Medienkompetenz umfasst drei voneinander unterschiedliche Fähigkeiten: die Fähigkeit, falsche oder irreführende Inhalte zu erkennen, die Fähigkeit, Behauptungen durch unabhängige Quellen und Tools zu verifizieren, und die Fähigkeit, fundierte Entscheidungen über das Teilen von Informationen zu treffen. Fehlt eine dieser drei Fähigkeiten, entsteht eine Lücke, die Akteure mit schlechten Absichten gezielt ausnutzen.

Die UNESCO-Definition, die die meisten europäischen Medienpädagogik-Rahmenwerke prägt, beschreibt Medienkompetenz als „die Fähigkeit, Medien in verschiedenen Formen zu nutzen, zu analysieren, zu bewerten und zu gestalten.“ Das Rahmenwerk für Medienkompetenz des Europarats von 2021 ergänzt eine vierte Dimension: die Fähigkeit, sich mit Medieninhalten als Teilnehmerin oder Teilnehmer demokratischer Prozesse auseinanderzusetzen — nicht nur als passive Konsumentin oder passiver Konsument. Diese Website nutzt beide Definitionen als Referenzpunkte.

Eine wichtige Klarstellung: Medienkompetenz ist nicht dasselbe wie Medienskepsis. Das Ziel ist nicht, allen Quellen zu misstrauen — sondern das Vertrauen auf Basis von Belegen zu kalibrieren. Pauschales Misstrauen gegenüber Mainstreammedien ist selbst ein dokumentiertes Produkt von Desinformationskampagnen, kein Beleg für kritisches Denken. Forschungen des Reuters Institute und des Shorenstein Center der Harvard Kennedy School zeigen: Bevölkerungen mit hoher Medienskepsis sind nicht widerstandsfähiger gegen Fehlinformation — sie sind anders anfällig, insbesondere gegenüber nicht-institutionellen Quellen.

Warum 2025 die Einsätze erhöht hat

Drei sich überlagernde Entwicklungen haben die Praxis in den letzten zwei Jahren dringlicher gemacht als je zuvor im vorherigen Jahrzehnt.

KI-generierte synthetische Medien in großem Maßstab

Bis 2023 erforderte hochwertige Deepfake-Produktion Spezialhardware und erhebliches technisches Know-how. Ende 2024 hatten Consumer-Tools auf Basis von Stable Diffusion, ElevenLabs-Sprachsynthese und mehreren Videogenerierungsplattformen diese Schwelle auf nahezu null gesenkt. Ein überzeugendes synthetisches Video einer öffentlichen Person lässt sich heute in Minuten auf handelsüblicher Hardware produzieren. Die forensische Lücke — die Zeit zwischen dem Kursieren eines synthetischen Mediums und seiner definitiven Widerlegung — liegt im Stundenbereich. Dieses Fenster reicht aus, um bei zeitkritischen Themen die öffentliche Meinung zu verschieben, bevor die Korrektur dieselbe Zielgruppe erreicht wie das Original.

Koordiniertes inauthenthisches Verhalten zu reduzierten Kosten

Metas Adversarial Threat Report 2024 dokumentierte einen Anstieg KI-gestützter koordinierter inauthenthischer Verhaltenskampagnen (CIB) um 61 Prozent gegenüber 2023. Das entscheidende Merkmal aktueller Kampagnen ist nicht ihre Reichweite, sondern ihre Spezifität: LLM-generierte Inhalte können auf bestimmte Gemeinschaften, Sprachen und emotionale Profile zugeschnitten werden — zu Kosten, die für menschlich verfasste Propaganda noch vor drei Jahren unerschwinglich gewesen wären. Kampagnen, die früher Teams von Autorinnen und Autoren erforderten, brauchen heute einen Prompt und einen API-Schlüssel.

Erosion des institutionellen Vertrauens

Der Reuters Institute Digital News Report 2024 verzeichnete ein durchschnittliches Vertrauen in Nachrichtenmedien von 40 Prozent in 47 untersuchten Ländern — gegenüber 44 Prozent im Jahr 2022. Sinkendes institutionelles Vertrauen macht Bevölkerungen nicht per se anfälliger für Fehlinformation. Es entzieht aber einen der wichtigsten Anker, mit dem Menschen Informationen kalibrieren: den Ruf der Quelle. Wenn keiner Quelle vertraut wird, gelten alle Behauptungen als gleich plausibel — was funktional dasselbe ist wie alle Behauptungen für wahr zu halten und genau jenen nutzt, die Desinformation in hohem Volumen produzieren.

Die drei Kernkompetenzen

1. Falsche und irreführende Inhalte erkennen

Erkennen ist der Einstiegspunkt. Dafür brauchst du Vertrautheit mit den strukturellen Mustern, die irreführende Inhalte nutzen: emotionale Sprache in Schlagzeilen, vage Zuschreibungen, dekontextualisierte Statistiken, fehlende Originalquellen und Dringlichkeitsrahmung. Diese Muster sind kein Falschheitsbeweis — sie sind Signale dafür, dass mehr Untersuchung nötig ist, bevor du der Information vertraust oder sie teilst.

Der Leitfaden zu emotionaler Sprache in Schlagzeilen behandelt die konkreten sprachlichen Muster im Detail, mit Beispielen aus dokumentierten Fällen quer durch das politische Spektrum. Erkennen ist Voraussetzung für Verifikation — du kannst keinen Inhalt verifizieren, den du nicht zuvor als prüfenswert markiert hast.

2. Behauptungen verifizieren

Verifikation ist die Kernpraxis. Sie bedeutet, Behauptungen zu Primärquellen zurückzuverfolgen — Originalstudien, offizielle Dokumente, Ersthand-Berichte — und die Belege eigenständig zu bewerten, nicht durch Zusammenfassungen Dritter oder Social-Media-Rahmungen. Die meisten viralen Falschmeldungen sind nachvollziehbar, wenn man zehn Minuten und die richtigen Tools hat.

Der Werkstatt-Bereich beschreibt vier praktische Verifikationsmethoden vollständig: das SIFT-Framework, Rückwärts-Bildsuche, Emotionssprachenanalyse und Deepfake-Erkennung. Der Leitfaden zu Faktencheck-Tools listet die zuverlässigsten frei zugänglichen Tools für jede Verifikationsaufgabe auf, mit Hinweisen dazu, was jedes Tool leistet — und was nicht.

3. Verantwortungsvoll teilen

Fehlinformation verbreitet sich vor allem durch Menschen, die sie für wahr halten. Die Entscheidung zu teilen ist deshalb genauso folgenreich wie die Entscheidung, etwas zu erstellen. Verantwortungsvoll teilen bedeutet, vor dem Weiterverbreiten einer Behauptung zumindest eine grundlegende Verifikation durchzuführen — besonders bei Behauptungen, die bestehende Überzeugungen bestätigen. Forschungen zeigen konsistent, dass solche Inhalte schneller und mit weniger Prüfung geteilt werden als Behauptungen, die die eigene Weltsicht herausfordern.

Der praktische Standard ist einfach: Wenn du die Originalquelle einer Behauptung nicht identifizieren und unabhängig bestätigen kannst — teile sie nicht. Wenn die Behauptung eine starke emotionale Reaktion auslöst, ist das ein Grund zum Verlangsamen, kein Beweis für ihre Wahrheit.

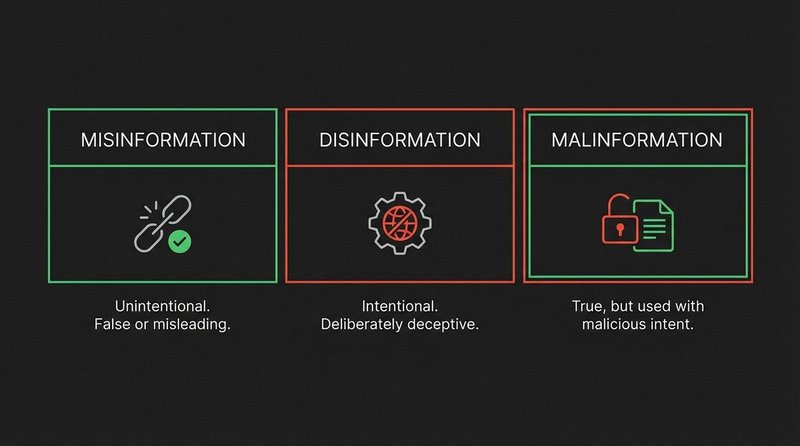

Schlüsselbegriffe: Fehlinformation, Desinformation, Malinformation

Diese drei Begriffe werden im öffentlichen Diskurs oft synonym verwendet, beschreiben aber unterschiedliche Phänomene mit unterschiedlichen Ursachen und unterschiedlichen Gegenmaßnahmen. Die Unterscheidung ist wichtig für eine genaue Diagnose.

- Fehlinformation

- Falsche oder ungenaue Informationen, die ohne Täuschungsabsicht geteilt werden. Die Person, die sie verbreitet, hält sie für wahr. Beispiel: Jemand teilt einen Gesundheitsmythos, den er aufgegriffen und ernsthaft für wahr gehalten hat. Die angemessene Reaktion ist präzise Information, die verständlich und ohne Herablassung vermittelt wird — wer Fehlinformation verbreitet, ist nicht dasselbe wie wer sie erschafft.

- Desinformation

- Falsche Informationen, die bewusst erstellt und mit Täuschungsabsicht verbreitet werden. Die Produzentin oder der Produzent weiß, dass der Inhalt falsch ist, und verfolgt ein strategisches Ziel — meist politischer, finanzieller oder sozialer Natur. Beispiele: staatlich gesteuerte Einflussoperationen und erfundene Zitate von politischen Persönlichkeiten. Die angemessene Reaktion ist die Offenlegung der Täuschung und ihrer Quelle, kombiniert mit Prebunking — also der Impfung von Zielgruppen gegen die konkrete Technik, bevor sie ihr in großem Maßstab begegnen.

- Malinformation

- Korrekte Informationen, die mit Schädigungsabsicht eingesetzt werden — typischerweise durch Kontextentzug, gezieltes Timing oder den Einsatz privater Informationen gegen Einzelpersonen. Beispiel: ein sachlich korrektes, aber bewusst terminiertes Leak privater Kommunikation, das darauf abzielt, eine Kandidatur in den letzten Tagen vor einer Wahl zu beschädigen. Die Information selbst ist wahr; ihre Waffe ist das Problem. Die angemessene Reaktion ist Kontext-Wiederherstellung und Quellenanalyse — nicht das Faktenchecken des Inhalts selbst.

Eine detaillierte Analyse, wie diese drei Kategorien in dokumentierten Fällen interagieren und sich überschneiden, findest du in: Fehlinformation vs. Desinformation: Was der Unterschied wirklich bedeutet.

Prebunking: Fehlinformation zuvorkommen

Debunking — also das Korrigieren von Falschmeldungen, nachdem sie sich bereits verbreitet haben — ist notwendig, aber begrenzt. Korrekturen erreichen selten dieselbe Zielgruppe wie die ursprüngliche Behauptung. Und wiederholte Konfrontation mit einer falschen Behauptung, selbst im Kontext der Widerlegung, kann ihre Einprägsamkeit paradoxerweise erhöhen (der Illusory-Truth-Effekt, dokumentiert in Fazio et al., 2015, und in mehreren Folgestudien repliziert).

Prebunking begegnet dieser Einschränkung, indem es Menschen gegen Desinformationstechniken impft, bevor sie spezifischen Falschbehauptungen begegnen. Statt Inhalte zu korrigieren, vermittelt Prebunking die strukturellen Muster, die falsche Inhalte verwenden — damit die Technik erkennbar ist, unabhängig davon, bei welcher konkreten Behauptung sie eingesetzt wird. Forschungen des Social Decision-Making Lab der University of Cambridge und des jigsaw.google.com-Teams haben belegt, dass kurze Prebunking-Interventionen die Anfälligkeit für Desinformationstechniken in kontrollierten Studien messbar reduzieren.

Der Werkstatt-Bereich dieser Website ist als Prebunking-Ressource konzipiert: Er vermittelt Erkennungstechniken — nicht nur konkrete widerlegte Behauptungen.

Die Rolle von Plattform-Algorithmen bei der Verbreitung von Desinformation

Individuelles kritisches Denken ist notwendig — aber nicht ausreichend. Plattform-Design bestimmt, welche Informationen Menschen überhaupt erreichen, noch bevor individuelle Bewertungsentscheidungen getroffen werden. Zu verstehen, wie algorithmische Verstärkung funktioniert, gehört 2025 zur Medienkompetenz.

Content-Empfehlungsalgorithmen auf großen Social-Media-Plattformen optimieren primär auf Engagement — nicht auf Genauigkeit, Relevanz oder gesellschaftlichen Nutzen. Forschungen des MIT Media Lab, veröffentlicht in Science (Vosoughi, Roy und Aral, 2018), zeigten: Falschnachrichten verbreiten sich in sozialen Medien signifikant schneller und weiter als wahre Nachrichten — im Durchschnitt erreichen sie sechsmal so viele Menschen. Ein wesentlicher Treiber ist Neuheit: Falsche Informationen sind oft überraschender als korrekte, und Überraschung ist ein verlässliches Engagement-Signal. Der Algorithmus verstärkt, was Reaktionen auslöst — das gibt manipulativen Inhalten einen strukturellen Vorteil.

Das bedeutet nicht, dass Einzelpersonen machtlos sind. Es bedeutet, dass die in diesem Leitfaden beschriebenen Verifikationsgewohnheiten — Innehalten vor dem Teilen, Behauptungen zu Primärquellen zurückverfolgen, Glaubwürdigkeit von Quellen prüfen — genau deshalb besonderes Gewicht tragen, weil das Standard-Plattform-Umfeld sie nicht unterstützt. Jede Teilen-Entscheidung ist zugleich eine algorithmische Stimme für die Art von Inhalten, die als nächstes befördert werden.

Ressourcen in diesem Bereich

Der Medienkompetenz-Hub enthält Leitfäden, Checklisten und Analysen zum gesamten Spektrum der oben beschriebenen Kompetenzen. Aktuell verfügbare Kernressourcen:

- Fehlinformation vs. Desinformation — Was der Unterschied wirklich bedeutet

- Faktencheck-Tools — Die besten kostenlosen Ressourcen für eigenständige Verifikation

- How to Teach Media Literacy to Teenagers — A Practical Guide for Educators

- The Anatomy of Viral Fake News — How False Stories Spread and Why

Der Werkstatt-Bereich bietet praxisorientierte Verifikationsmethoden mit Schritt-für-Schritt-Leitfäden. Die Falschmeldungs-Datenbank liefert dokumentierte Fallstudien aus der Praxis zu jedem in diesem Hub behandelten Konzept.