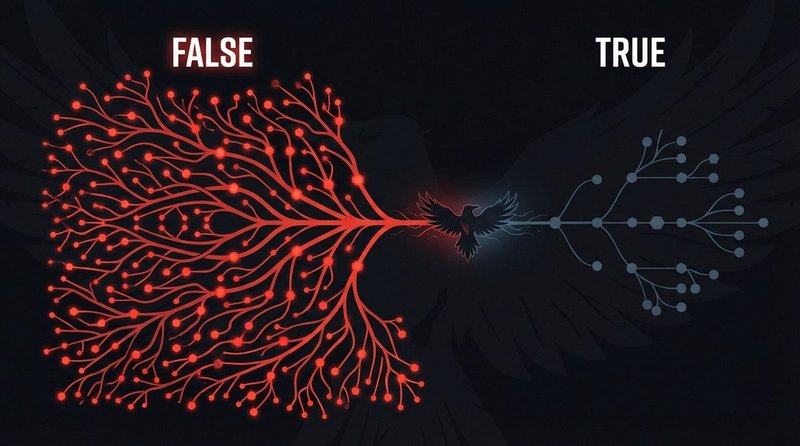

Falschmeldungen verbreiten sich in sozialen Medien schneller, weiter und tiefer als wahre Nachrichten – nicht weil Menschen irrational sind, sondern weil falsche Geschichten gezielt jene kognitiven Abkürzungen ausnutzen, die uns zu effizienten Informationsverarbeitern machen. Den Mechanismus zu verstehen ist der erste Schritt, um ihm zu widerstehen.

Die Datenlage: Was die MIT-Studie herausfand

Die grundlegende empirische Referenz zu diesem Thema ist eine 2018 erschienene Studie von Soroush Vosoughi, Deb Roy und Sinan Aral, veröffentlicht in Science (Bd. 359, Ausg. 6380). Die Forschenden analysierten die Verbreitung von rund 126.000 faktengeprüften Geschichten, die zwischen 2006 und 2017 auf Twitter geteilt wurden – von etwa 3 Millionen Nutzerinnen und Nutzern, insgesamt mehr als 4,5 Millionen Mal.

Die Ergebnisse waren eindeutig. Falschmeldungen erreichten 1.500 Personen ungefähr sechsmal schneller als wahre Nachrichten. Sie verbreiteten sich an mehr Nutzerinnen und Nutzer (mehr Menschen sahen falsche Geschichten als wahre) und drangen tiefer in soziale Netzwerke ein (falsche Geschichten durchliefen längere Kaskadenketten). Der Effekt war bei politischer Desinformation am stärksten. Und entscheidend: Die Forschenden kontrollierten den Einfluss von Bots. Menschen, nicht automatisierte Accounts, waren der primäre Verbreitungsweg für Falschnachrichten. Bots verbreiteten wahre und falsche Geschichten in etwa gleich schnell; die menschliche Amplifikations-Asymmetrie war der signifikante Befund.

Die Erklärung der Studie für die Asymmetrie: Falschmeldungen sind neuartiger (sie enthalten Informationen, die das Publikum noch nicht gesehen hat) und emotional ansprechender. Geschichten, die von Faktencheckern als falsch eingestuft wurden, erzeugten signifikant höhere Reaktionen in den Kategorien Überraschung, Angst und Ekel. Wahre Geschichten erzeugten eher Traurigkeit und Vorfreude – Emotionszustände mit niedrigerem Erregungsniveau, die weniger Teilungsverhalten auslösen.

Emotionale Auslöser: Die Architektur viraler Falschinhalte

Virale Desinformation nutzt zuverlässig drei Kategorien emotionaler Reaktionen aus. Das Wissen darum macht nicht immun – die Reaktionen sind physiologischer Natur –, aber es schafft ein kurzes Fenster für eine bewusste Bewertung, bevor man dem Impuls zum Teilen nachgibt.

Empörung

Moralische Empörung ist der zuverlässigste Prädikator für Teilungsverhalten in sozialen Medien. Eine 2017 von Brady et al. in PNAS veröffentlichte Studie stellte fest, dass jedes moralisch-emotionale Wort in einem Tweet die Retweet-Rate um etwa 20 Prozent erhöhte. Virale Falschmeldungen verwenden systematisch ein Empörungs-Framing – sie stellen Ereignisse als Ungerechtigkeiten, Verrat oder Bedrohungen für Eigengruppen-Werte dar. Der Inhalt muss dabei nicht vollständig falsch sein; eine selektive Rahmung realer Ereignisse, aus dem Kontext gerissen, funktioniert genauso gut.

Angst

Bedrohungsbasierte Desinformation aktiviert die Amygdala, bevor der präfrontale Kortex analytisches Denken anwenden kann – ein gut dokumentiertes Phänomen der kognitiven Neurowissenschaft. Gesundheitsdesinformation („Dieses Lebensmittel / dieser Impfstoff / diese Substanz tötet Sie”), Kriminalitätsdesinformation („Die Kriminalität explodiert in Ihrer Nachbarschaft”) und Narrativen über Identitätsbedrohung („Sie ersetzen Ihre Kultur”) nutzen alle Angstreaktionen aus. Die Inhalte verbreiten sich schnell, weil das Teilen sich schützend anfühlt – man warnt sein Netzwerk –, was ein prosoziales Motiv für die Verstärkung falscher Informationen schafft.

Schadenfreude und Stammesbefriedigung

Geschichten, die negative Überzeugungen über eine Fremdgruppe bestätigen – politische Gegner, rivalisierende Nationen, ideologische Feinde –, aktivieren Belohnungskreise statt Bedrohungsreaktionen. Sie zu teilen fühlt sich gut an. Forschungen von Pennycook & Rand (2019) in Social Psychological and Personality Science ergaben, dass „parteiliche Kongruenz” (Inhalte, die bestehende politische Überzeugungen bestätigten) der stärkste Prädiktor für Teilungsabsicht war – stärker als die wahrgenommene Genauigkeit des Inhalts. Menschen teilen Inhalte, weil sie sich ihrer Weltanschauung stimmig anfühlen, nicht unbedingt weil sie glauben, dass sie faktisch korrekt sind.

Plattform-Algorithmen und Engagement-Optimierung

Die Plattformarchitektur erzeugt keine Desinformation, ist aber ein wesentlicher Amplifikationsmechanismus. Das Kerndesignprinzip engagement-optimierter Empfehlungssysteme – die Verweildauer auf der Plattform maximieren – belohnt strukturell emotional aktivierende Inhalte, unabhängig von deren Wahrheitsgehalt.

Eine interne Facebook-Studie aus dem Jahr 2021, über die das Wall Street Journal auf Basis geleakter Dokumente berichtete, ergab, dass Facebooks eigene Forschende festgestellt hatten, dass die Algorithmusänderung von 2018 (Umstellung auf „bedeutungsvolle soziale Interaktionen” – Inhalte, die Kommentare und Reaktionen erzeugten, statt passiver Aufrufe) die Wirkung hatte, empörungsauslösende Inhalte einschließlich Desinformation zu verstärken. Die Forschenden schlugen Korrekturen vor; diese wurden wegen Bedenken über einen Rückgang des Gesamtengagements nicht im großen Maßstab umgesetzt.

Der Mechanismus ist nicht auf Facebook beschränkt. Der Empfehlungsalgorithmus von YouTube, wie in einem Audit von Ribeiro et al. (2020) dokumentiert, empfahl konsistent immer extremere Inhalte, sobald Nutzende begannen, Inhalte bestimmter politischer oder verschwörungstheoretischer Kategorien zu schauen – ein „Kaninchenbau”-Effekt, der durch Watch-Time-Optimierung angetrieben wird. Twitter/Xs algorithmische Timeline verstärkte in mehreren Ländern rechtsorientierte politische Inhalte stärker als linksorientierte, unabhängig von Engagement-Unterschieden. Die interne Studie der Plattform von 2021 veröffentlichte diesen Befund freiwillig.

Die strukturelle Implikation: Für Engagement optimierte Plattformen werden systematisch Inhalte verstärken, die starke emotionale Reaktionen auslösen – was, konstruktionsbedingt, genau das ist, wozu falsche und irreführende Nachrichten gebaut werden.

Timing: Wann Falschmeldungen am gefährlichsten sind

Fehlinformationen verbreiten sich nicht gleichmäßig über die Zeit. Drei spezifische Kontexte schaffen Bedingungen, unter denen Desinformation am schnellsten kursiert und Korrekturen am wenigsten wirken.

Breaking-News-Fenster

Die ersten 30 bis 60 Minuten nach einem größeren Ereignis sind jene Phase, in der verifizierte Informationen am knappsten und die Publikumsnachfrage am höchsten sind. Desinformation füllt die Lücke. Forschungen des Reuters-Instituts für das Studium des Journalismus zeigen konsistent, dass falsche Behauptungen, die während Breaking-News-Fenstern eingeführt werden, schwerer zu korrigieren sind als solche, die nach verfügbarer autoritativer Berichterstattung eingeführt werden, weil die falsche Version oft zum mentalen Anker wird, an dem das Publikum spätere Korrekturen misst.

Wahlen und politische Kampagnen

Wahlperioden zeigen in jedem untersuchten demokratischen Kontext konsistente Spitzen bei Desinformationsvolumen und -geschwindigkeit. Die EU vs Disinfo-Datenbank dokumentiert die Wahlperioden-Verstärkung in allen EU-Mitgliedstaaten in jedem Wahlzyklus seit 2014. Die Kombination aus hohen politischen Einsätzen, starker Stammesmotivation zum Teilen günstiger Inhalte und fragmentierten Medienlandschaften schafft optimale Bedingungen dafür, dass falsche Informationen ein großes Publikum erreichen, bevor Faktenchecker reagieren können.

Öffentliche Gesundheitskrisen

Die WHO prägte den Begriff „Infodemie” im Februar 2020, um die parallele Epidemie falscher und irreführender COVID-19-Gesundheitsinformationen zu beschreiben. Ihre gemeinsame Studie mit Partnerorganisationen stellte fest, dass sich Gesundheitsdesinformation bis März 2020 auf jeder großen Social-Media-Plattform schneller verbreitete als offizielle Leitlinien – eine direkte Folge der oben beschriebenen Mechanismen in einem Umfeld mit hoher Angst und hoher Unsicherheit.

Super-Spreader-Accounts und Netzwerkeffekte

Virale Verbreitung ist in sozialen Netzwerken nicht gleichmäßig. Eine kleine Zahl hochvernetzter, hochengagierter Accounts – oft als „Super-Spreader” bezeichnet – trägt einen unverhältnismäßig großen Anteil zur Desinformationsverstärkung bei.

Analysen des NewsGuard Misinformation Monitor und unabhängiger Forschender, die die US-Wahl 2020 untersuchten, stellten konsistent fest, dass eine kleine Anzahl von Accounts – oft mit Millionen von Followern, oft prominente politische Figuren – für die Mehrzahl der reichweitenstarken Desinformationsepisoden verantwortlich war. Das Muster ähnelt strukturell dem, was Epidemiologinnen und Epidemiologen als „Superspreader-Ereignisse” bei der Krankheitsübertragung bezeichnen: Die meisten Menschen infizieren null oder eine Person; eine kleine Anzahl von Menschen infiziert unter den richtigen Bedingungen Hunderte.

Netzwerkanalysen auf Plattformebene durch Graphika und das DFRLab haben koordinierte Amplifikationsnetzwerke dokumentiert, in denen Accounts ohne organische Beziehung gegenseitig ihre Inhalte künstlich aufwerten – was die Zeit zwischen Erstveröffentlichung und Massenexposition verkürzt. Das macht das Breaking-News-Fenster noch kürzer und reduziert die verfügbare Zeit für verifizierungsbasierte Interventionen.

Fallstudie: Die Anatomie eines realen viralen Falschnachrichtenereignisses

Im November 2016 verbreitete sich die falsche Behauptung, eine Pizzeria in Washington D.C. namens Comet Ping Pong sei das Zentrum eines Kinderhändlerrings, der von hochrangigen Mitgliedern der Demokratischen Partei betrieben werde. Die Behauptung – die als „Pizzagate” bekannt wurde – hatte keine Beweisgrundlage und wurde von der Metropolitan Police des District of Columbia untersucht und zurückgewiesen. Dennoch verbreitete sie sich innerhalb von Tagen an Millionen von Menschen und wurde direkt von einem Mann zitiert, der am 4. Dezember 2016 in dem Restaurant schoss und dabei niemanden verletzte, aber erheblichen Sachschaden anrichtete.

Der Pizzagate-Fall demonstriert alle in diesem Artikel beschriebenen Mechanismen, die gleichzeitig operieren:

- Emotionaler Auslöser: Kindgefährdung gehört zu den moralischen Anliegen mit dem höchsten Erregungsniveau – sie löst sowohl Empörungs- als auch Angstreaktionen aus.

- Timing: Die Behauptung tauchte unmittelbar nach der US-Wahl 2016 auf, in einem politischen Hochengagement-Moment mit starker Stammesmotivation zum Teilen schädigender Informationen über die Gegenpartei.

- Super-Spreader-Verstärkung: Die Behauptung wurde von Accounts mit großen Zuschauergruppen auf Twitter und YouTube verbreitet, darunter einige mit Hunderttausenden von Followern, bevor Plattformdurchsetzungsmechanismen griffen.

- Algorithmus-Optimierung: Laut späterer Analyse lenkte YouTubes Empfehlungsalgorithmus Nutzende über vorhersehbare Inhaltssteigerungspfade von mainstreamem Wahlinhalt zu Pizzagate-Videos.

- Korrektur-Asymmetrie: Als die Washington Post, die New York Times und mehrere Faktenchecker vollständige Widerlegungen veröffentlicht hatten, hatte die falsche Version bereits mehr Menschen erreicht, als jede spätere Korrektur je erreichen würde. Der Vosoughi-et-al.-Befund über die sechsmal schnellere Verbreitung von Falschnachrichten ist hier direkt illustriert.

Eine dokumentierte Analyse der Pizzagate-Informationsoperation, einschließlich Verbreitungskartierung, wird vom European Digital Media Observatory (EDMO) als Referenz-Fallstudie zu koordinierten Einflussoperationen gepflegt.

Diese Mechanismen auf struktureller Ebene zu verstehen ist die grundlegende Voraussetzung, um Inhalte zu bewerten, bevor man sie teilt. Der Leitfaden zu Desinformation vs. Misinformation → erläutert, wie Absicht auf diese viralen Mechaniken abbildet. Der Workshop zu emotionaler Sprache in Schlagzeilen → bietet praktische Übungen zur Erkennung von Trigger-Framing in echten Schlagzeilen. Dokumentierte virale Fälle mit vollständiger Verbreitungsanalyse sind in der Fake-News-Datenbank → verfügbar. Zurück zum Medienkompetenz-Hub → für den vollständigen strukturierten Lernpfad.