Fehlinformation und Desinformation sind keine Synonyme. Der Unterschied — die Absicht — entscheidet darüber, welche Gegenmaßnahmen greifen und welche versagen. Wer alle falschen Informationen als vorsätzliche Täuschung behandelt, setzt die falschen Mittel ein; wer böswillige Absicht ignoriert, lässt koordinierte Kampagnen ungestört operieren.

Drei Kategorien, ein Framework

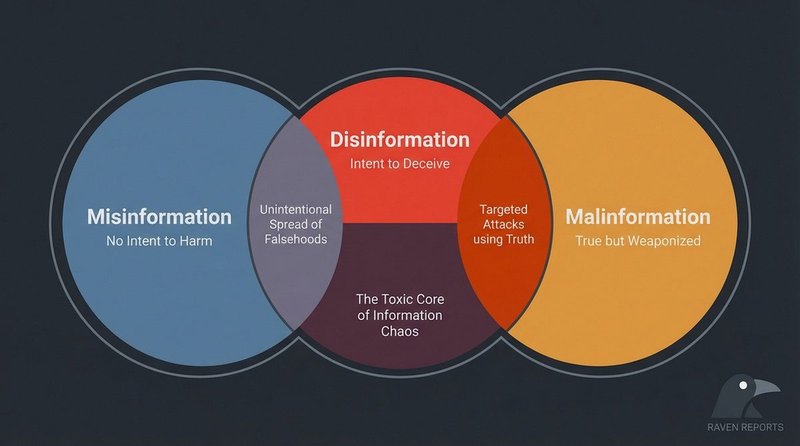

Das meistzitierte Framework zum Verständnis falscher Informationen stammt von Forscherin Claire Wardle und ihren Kolleginnen und Kollegen bei First Draft. Ihr Bericht Information Disorder von 2017 — später zu einem vollständigen Modell für den Europarat ausgebaut — unterscheidet drei Phänomene anhand zweier Achsen: ob der Inhalt falsch ist, und ob die verbreitende Person Schaden beabsichtigt.

- Fehlinformation

- Falsche oder ungenaue Informationen, die ohne Schädigungsabsicht geteilt werden. Die Person, die sie verbreitet, glaubt, dass sie stimmen. Beispiele: Eine Mutter teilt in der WhatsApp-Familiengruppe ein widerlegtes Hausmittel, oder ein Journalist zitiert in gutem Glauben eine ungeprüfte Statistik. Der Inhalt ist falsch; das Motiv ist nicht böswillig.

- Desinformation

- Falsche oder irreführende Informationen, die bewusst mit der Absicht erstellt und verbreitet werden, zu täuschen oder Schaden anzurichten. Die Quelle weiß, dass die Information falsch ist — oder ist gleichgültig gegenüber ihrer Richtigkeit — und verbreitet sie trotzdem, um ein Ziel zu erreichen: politische Manipulation, finanziellen Gewinn, Rufschädigung oder die Destabilisierung des öffentlichen Vertrauens. Gefälschte Zitate, die Politikerinnen und Politikern zugeschrieben werden, koordinierte Netzwerkkampagnen zur Diskreditierung von Journalistinnen und Journalisten sowie staatlich gesteuerter Wahleinfluss fallen alle in diese Kategorie.

- Malinformation

- Informationen, die wahr sind, aber als Waffe eingesetzt werden, um Schaden anzurichten. Diese Kategorie ist die kontraintuitivste: Es wird keine falsche Behauptung aufgestellt, aber die selektive Veröffentlichung wahrer privater Informationen — eine gehackte E-Mail, ein geleaktes Foto, echte Gesundheitsdaten — dient dazu, ein bestimmtes Ziel zu schädigen. Der Code of Practice on Disinformation der EU und die Leitlinien des Europarats behandeln Malinformation als eigene Kategorie, die andere Regulierungsmaßnahmen erfordert als die beiden anderen.

Der Lehrplan für Medien- und Informationskompetenz der UNESCO verwendet eine kompatible Taxonomie und betont, dass der Oberbegriff “Fake News” analytisch unzureichend und potenziell irreführend ist — er vermischt Kategorien, die grundlegend unterschiedliche Reaktionen erfordern.

Warum Absicht alles ändert

Absicht ist nicht nur eine ethische Frage — sie ist eine praktische, die bestimmt, welche Interventionen wirksam sind.

Wenn falsche Informationen sich verbreiten, weil Menschen sie für wahr halten (Fehlinformation), sind die wirksamsten Reaktionen edukativer Natur: Richtigstellen, Vorimpfung (Prebunking) und Medienkompetenzförderung. Menschen, die falsche Informationen in gutem Glauben geteilt haben, werden sich in der Regel korrigieren, wenn sie präzise Informationen und einen reibungslosen Weg dazu bekommen. Forschung von Pennycook et al. (2020) in Psychological Science zeigte, dass allein die Frage, ob Menschen vor dem Teilen die Genauigkeit einer Information bedenken, die Verbreitung von Fehlinformationen in simulierten Studien reduzierte.

Wenn falsche Informationen Desinformation sind — also bewusst fabriziert — reichen edukative Maßnahmen allein nicht aus. Die Quelle wird ihr Verhalten auf Basis von Faktenchecks nicht ändern. Wirksame Gegenmaßnahmen umfassen plattformseitige Durchsetzung, rechtliche Rahmenbedingungen (wie der Digital Services Act der EU), Attributionsforschung zur Aufdeckung koordinierter unechter Aktivitäten sowie strategische Kommunikation, die Zielgruppen präventiv immunisiert. Das EU vs Disinfo-Projekt pflegt eine laufende Datenbank dokumentierter Kreml-Desinformationsfälle — mit über 16.000 Einträgen Anfang 2026 — weil das Benennen der Quelle ein notwendiger Teil der Antwort ist.

Malinformation erfordert wieder ein anderes Instrumentarium: vor allem rechtliche Mechanismen rund um Datenschutz, Privatsphäre und Plattformtransparenz — keinen Faktencheck, da die zugrundeliegenden Fakten korrekt sind.

Reale Beispiele aus allen drei Kategorien

Fehlinformation in der Praxis

In den frühen Monaten der COVID-19-Pandemie kursierten auf Messaging-Apps Behauptungen, heißes Trinken könne das SARS-CoV-2-Virus abtöten. Die meisten Menschen, die diese Nachrichten weiterleiteten, wollten damit aufrichtig helfen. Die Mythbusters-Seite der WHO dokumentierte dutzende ähnliche Fälle, bei denen gut gemeintes Teilen die Verbreitung von Gesundheitsfehlinformationen beschleunigte. Keine koordinierte Kampagne war nötig; in einem Umfeld hoher Unsicherheit verstärkten besorgte Menschen plausibel klingende, aber falsche Informationen organisch.

Desinformation in der Praxis

Die Einschätzung der U.S. Intelligence Community von 2017 zur russischen Einflussnahme auf die US-Wahl 2016 dokumentierte eine koordinierte Desinformationskampagne mit gefälschten Inhalten, gefälschten Personas und algorithmischer Verstärkung. Operatoren der Internet Research Agency erstellten tausende Social-Media-Konten, um sich als authentische amerikanische Stimmen zu Spaltungsthemen auszugeben — eine Lehrbuch-Desinformationsoperation, bei der die Ersteller wussten, dass die Inhalte falsch waren, und die politische Manipulation explizit beabsichtigt war.

Malinformation in der Praxis

Die Veröffentlichung der privaten E-Mails von John Podesta im Jahr 2016 — durch einen gezielten Phishing-Angriff auf sein Gmail-Konto erlangt und über WikiLeaks publiziert — ist ein dokumentierter Fall von Malinformation. Die E-Mails waren echt. Kein Inhalt wurde fabriziert. Aber ihre selektive Veröffentlichung, zeitlich abgestimmt auf die Schädigung einer Wahlkampagne, stellt nach der Definition im Wardle/First-Draft-Framework weaponized true information dar. Der Cyber-Operationen-Tracker des Council on Foreign Relations klassifiziert diese Operation unter Informationsoperationen.

Die Grauzonen

Das Drei-Kategorien-Modell ist ein nützliches analytisches Werkzeug, keine wasserdichte Taxonomie. Reale Fälle liegen häufig im Überschneidungsbereich.

Stell dir einen viralen Social-Media-Post vor, der eine echte Statistik enthält, aber ohne Kontext präsentiert — auf eine Art, von der die Person, die ihn erstellt hat, weiß, dass sie das Publikum zu einer falschen Schlussfolgerung führen wird. Die Zahl ist korrekt; das Framing ist bewusst täuschend. Das liegt zwischen Fehlinformation (keine falsche Behauptung) und Desinformation (bewusste Täuschung). Wardles Framework trägt dem mit einem Spektrum von “sieben Typen von Mis- und Desinformation” Rechnung, das von Satire und Parodie bis hin zu fabriziertem Inhalt reicht — in der Anerkennung, dass Absicht und Falschheit Kontinua sind, keine binären Schalter.

Eine zweite häufige Grauzone ist die parteiische Verstärkung: wenn ein Desinformationsnarrativ, das ursprünglich von einem koordinierten Akteur erstellt wurde, von normalen Bürgerinnen und Bürgern aufgegriffen und geteilt wird, die ihm inzwischen wirklich glauben. Die ursprüngliche Erstellung war Desinformation; die anschließende Verbreitung ist Fehlinformation. Attributionsforschung von Organisationen wie Graphika und dem Digital Forensic Research Lab (DFRLab) zielt darauf ab, die ursprüngliche koordinierte Quelle zu identifizieren — genau weil das nachgelagerte organische Teilen nicht das Kernproblem ist.

Eine dritte Komplexität sind umstrittene Fakten: Behauptungen in Bereichen, in denen echte wissenschaftliche Unsicherheit besteht oder Expertenmeinungen legitim auseinandergehen. Eine umstrittene empirische Behauptung als Desinformation zu klassifizieren, erfordert den Nachweis, dass sie sowohl falsch ist als auch dass die Quelle das wusste. Diese Unterscheidung ist für die Meinungsfreiheit enorm wichtig: Zu weit gefasste Desinformationslabels sind ein dokumentiertes Missbrauchsinstrument, das von autoritären Regierungen eingesetzt wird, um legitimen Widerspruch zu unterdrücken.

Konsequenzen für Gegenmaßnahmen

Um eine wirksame Reaktion zu wählen, musst du zuerst verstehen, mit welcher Art falscher Information du es zu tun hast. Die folgende Übersicht ordnet Interventionstypen den Kategorien von Informationsstörungen zu:

- Medienkompetenzbildung — adressiert primär Fehlinformation, bei der die Fähigkeit des Publikums zur Quellenbewertung die entscheidende Variable ist.

- Prebunking / Inokulationstheorie — wirksam bei Fehlinformation und Desinformation in frühen Stadien; Forschung von Lewandowsky & van der Linden (2021) zeigt, dass das Aufzeigen abgeschwächter Formen von Manipulationstechniken Resistenz aufbaut.

- Plattformseitige Durchsetzung (Entfernung, Herabstufung, Kennzeichnung) — zielt auf Desinformation auf der Distributionsebene ab; Wirksamkeit hängt von der Geschwindigkeit der Maßnahmen im Verhältnis zur viralen Verbreitung ab.

- Attribution und Aufdeckung — zielt auf Desinformation an der Quelle ab; das Benennen koordinierter Akteure erhöht die Kosten von Einflusskampagnen.

- Rechtliche und regulatorische Instrumente — relevant für Desinformation (EU DSA, nationale Wahlintegritätsgesetze) und Malinformation (Datenschutzrecht, Persönlichkeitsrechte).

- Korrekturen und Richtigstellungen — am wirksamsten bei Fehlinformation; weniger wirksam bei Desinformation, wo die Quelle ihr Verhalten nicht ändert, und wo Korrekturen paradoxerweise die ursprüngliche Falschbehauptung verstärken können — durch den sogenannten “Liar’s Dividend”: das Phänomen, bei dem der Vorwurf der Desinformation selbst eingesetzt wird, um genaue Berichterstattung zu diskreditieren.

Für eine strukturierte Methode zur Bewertung konkreter Behauptungen vor dem Teilen lies unseren Guide zur SIFT-Methode →. Für reale Fälle, sortiert nach Kategorie und Muster, bietet die Fake-News-Datenbank → dokumentierte Beispiele mit vollständigen Methodiknotes. Der Medienkompetenz-Hub → verbindet alle hier behandelten Konzepte zu einem strukturierten Lernpfad.