Falschmeldungen erkennen ist eine erlernbare Fähigkeit — kein angeborenes Talent. Diese Werkstatt erklärt vier praktische Methoden, die du ohne Spezialwerkzeug, institutionellen Zugang oder Vorkenntnisse anwenden kannst.

Was diese Werkstatt vermittelt

Die hier dokumentierten Methoden sind keine theoretischen Rahmenwerke. Es sind Verifikations-Workflows, die professionelle Faktenprüfer, Journalistinnen und digitale Ermittler verwenden — angepasst für alle, die einen Internetzugang und einen kritischen Blick haben.

Jede Methode ist in einem eigenen Leitfaden mit Schritt-für-Schritt-Anleitung, echten Beispielen aus der Falschmeldungs-Datenbank und einer Checkliste zum schnellen Nachschlagen dokumentiert. Diese Seite stellt alle vier Methoden vor. Folge den Links zu den vollständigen Leitfäden, um sie in der Praxis anzuwenden.

Die Werkstatt ist kostenlos und erfordert keine Anmeldung. Alle Leitfäden sind für die eigenständige Nutzung geschrieben — du musst sie nicht der Reihe nach durcharbeiten. Wähle die Methode, die am besten zu dem Inhalt passt, den du prüfen möchtest.

Nach dieser Werkstatt kannst du:

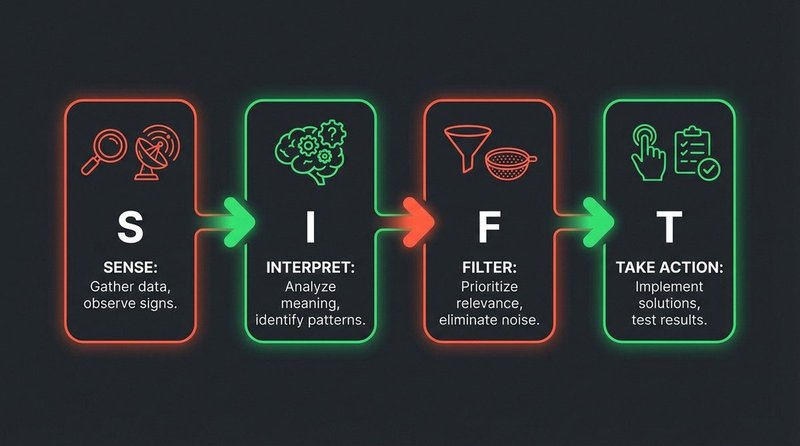

- Die SIFT-Methode anwenden, um jede Online-Information zu prüfen, bevor du sie teilst

- Rückwärts-Bildsuche nutzen, um visuelle Behauptungen zu verifizieren oder zu widerlegen

- Die emotionalen Sprachmuster erkennen, die auf manipulative Inhalte hinweisen

- Wichtige technische und verhaltensbezogene Merkmale KI-generierter Videos (Deepfakes) identifizieren

Methode 1 — SIFT: Ein Vier-Schritte-Verifikationsrahmen

SIFT ist die am weitesten verbreitete Informationsverifikationsmethode in der Medienkompetenzbildung. Sie wurde von Mike Caulfield an der Washington State University entwickelt und wird heute in Schul- und Universitätsprogrammen sowie in der journalistischen Berufsausbildung in den USA und Europa eingesetzt.

Die Methode adressiert ein konkretes Problem: Die meisten Menschen bewerten Informationen danach, wie sie sich anfühlen — nicht anhand von Belegen. SIFT durchbricht diesen Reflex durch strukturierte Verlangsamung: vier bewusste Schritte, die vor dem Teilen oder Meinungsbilden stattfinden.

Vollständiger SIFT-Methoden-Leitfaden — mit ausgearbeiteten Beispielen →

Methode 2 — Rückwärts-Bildsuche

Zweckentfremdete Bilder sind einer der häufigsten Vektoren bei Falschmeldungen. Ein Foto einer Überschwemmung von 2013 kursiert als Beleg für eine Katastrophe von 2024. Ein Protestbild aus einem Land wird mit einer Bildunterschrift aus einem anderen versehen. Rückwärts-Bildsuche bricht diese Taktik in unter zwei Minuten auf.

Der grundlegende Ablauf: Rechtsklick auf ein Bild im Browser, dann „Bild suchen“ (Chrome/Edge) auswählen oder es direkt bei Google Images, TinEye oder Yandex Images hochladen. Die Suche liefert alle indizierten Instanzen dieses Bildes — mit Datum, Quelle und Originalbildunterschrift. Ein Bild, das erstmals Jahre vor dem behaupteten Ereignisdatum auftauchte, wird mit hoher Wahrscheinlichkeit falsch dargestellt.

Wichtige Verfeinerungen im vollständigen Leitfaden: Suche per Screenshot, wenn direktes Hochladen nicht funktioniert; Yandex für breitere Abdeckung (besonders effektiv bei ost- und russischsprachigen Quellen); Kombination von Rückwärts-Bildsuche und EXIF-Metadaten-Prüfung bei noch nicht weit indizierten Bildern. Der Leitfaden erklärt auch, wie man mit zugeschnittenen oder farblich veränderten Kopien umgeht, die einfache Suchen umgehen können.

Vollständiger Rückwärts-Bildsuche-Leitfaden — Schritt für Schritt mit Tools →

Methode 3 — Emotionale Sprache in Schlagzeilen erkennen

Emotional aufgeladene Sprache in Schlagzeilen ist für sich genommen kein Beweis für eine Falschmeldung — echte Ereignisse können und lösen starke Reaktionen aus. Aber ein konsistentes Muster emotionaler Manipulationstechniken ist ein verlässliches Warnsignal dafür, dass der Inhalt Reaktion über Genauigkeit stellt.

Die Muster, auf die du achten solltest: absolute Sprache („NIE“, „IMMER“, „VERNICHTET“, „BEWEIST EIN FÜR ALLE MAL“), vage, aber alarmierende Zuschreibungen („Experten warnen“, „Quellen bestätigen“ ohne Namen oder Institution), Dringlichkeitsrahmung („bevor es gelöscht wird“, „teile, bevor sie es entfernen“) und Identitätsbedrohungs-Rahmung („was sie deinen Kindern/deiner Gemeinschaft/deinem Land antun“). Diese Muster tauchen sowohl in billigem Clickbait als auch in ausgefeilter staatlich gesteuerter Desinformation auf — deshalb ist ihre Erkennung eine übertragbare Fähigkeit über alle Inhaltstypen hinweg.

Keines dieser Muster beweist, dass eine Behauptung falsch ist. Sie zeigen an, dass der Inhalt darauf ausgelegt ist, eine Reaktion auszulösen, bevor die Leserin oder der Leser die Belege prüft. Der Stop-Schritt der SIFT-Methode ist die direkte Verhaltensantwort auf diese Technik — er verlangsamt den Teilimpuls lang genug, um auch eine minimale Prüfung zu ermöglichen.

Vollständiger Leitfaden: Emotionale Sprache in Schlagzeilen — Muster und Beispiele →

Methode 4 — Deepfakes erkennen

KI-generierte synthetische Videos (Deepfakes) sind technisch so zugänglich geworden, dass Einzelpersonen mit Consumer-Hardware heute überzeugende Gesichtstausche und Stimmklone produzieren können. Die Erkennung wird schwieriger — aber nicht unmöglich. Aktuelle Deepfake-Erzeugungsmethoden hinterlassen konsistente Artefaktmuster, die sich mit konzentrierter Analyse noch identifizieren lassen.

Die zuverlässigsten visuellen Indikatoren heute: unnatürliche Blinkmuster oder ausbleibendes Blinken, inkonsistente Beleuchtung zwischen dem Gesicht der Person und der Umgebung, Unschärfe oder Verzerrung an Haarlinien und Ohrkonturen, inkonsistente Audio-Lippensynchronisation sichtbar bei Bild-für-Bild-Prüfung sowie unnatürlich glatte Hauttextur (ein Nebenprodukt des neuronalen Renderprozesses). Kein einzelner Indikator ist schlüssig. Eine Kombination von drei oder mehr gibt ernsthaften Anlass zur Prüfung.

Technische Tools im vollständigen Leitfaden: Deepware Scanner und die FakeCatcher-Methode des Intel Research. Verhaltens- und Herkunftsanalyse ist ebenso wichtig: Wer hat dieses Video veröffentlicht, über welchen Kanal, mit welcher behaupteten Entstehungsgeschichte, und passt der Kontext zum Inhalt — diese Fragen lassen sich oft schneller klären als technische Artefaktanalysen.

Vollständiger Deepfake-Erkennungs-Leitfaden — Tools und Schritt-für-Schritt-Analyse →

Für wen diese Werkstatt ist

Schülerinnen und Schüler, Studierende

Für alle, die in informationsdichten Umgebungen navigieren. Jede Methode ist für schnelle Anwendung ausgelegt — ein SIFT-Check dauert zwei Minuten, eine Rückwärts-Bildsuche eine. Keine Spezialtools oder Accounts notwendig. Die Leitfäden verwenden reale Fälle aus der Datenbank als ausgearbeitete Beispiele statt hypothetischer Szenarien.

Lehrende und Pädagoginnen und Pädagogen

Jeder Leitfaden enthält ausgearbeitete Beispiele und herunterladbare Checklisten für den Unterrichtseinsatz. Die SIFT- und Emotionssprache-Leitfäden orientieren sich direkt an Medienkompetenz-Kompetenzstandards deutscher, österreichischer und europäischer Curricula. Bei Bedarf an zugeschnittenen Workshop-Materialien oder Unterrichtsplanungshilfe: Kontaktformular nutzen.

Journalistinnen und Journalisten, Forschende

Die Rückwärts-Bildsuche- und Deepfake-Erkennungs-Leitfäden gehen technisch tiefer und verweisen auf professionelle Tools neben den kostenlosen Optionen. Die Falschmeldungs-Datenbank bietet dokumentierte Fallstudien nach Methodenkategorie organisiert — nützlich für die Forschung oder als Lehrmaterial in Journalismusprogrammen.

Common Misinformation Patterns

These patterns appear repeatedly in fake news content. Learning to recognise them is the first step toward media literacy.

Ready to practice?

Browse real documented cases in our database and test your ability to spot the patterns.

Open the Database