Deepfakes sind KI-generierte oder KI-manipulierte Video- und Audioinhalte, die eine Person scheinbar etwas sagen oder tun lassen, was sie nie gesagt oder getan hat. Die Analyse visueller Artefakte hilft beim Erkennen minderwertiger Deepfakes, aber die Provenienzanalyse – die Rückverfolgung, wo ein Video zuerst aufgetaucht ist und wer es veröffentlicht hat – ist die zuverlässigere Methode für den Großteil der manipulierten Medien, die online kursieren.

Was Deepfakes sind und wie verbreitet sie sind

Der Begriff „Deepfake“ bezeichnet speziell mit Deep Learning erzeugten oder manipulierten Medieninhalt – neuronale Netze, die auf großen Datensätzen echter Video- oder Audioaufnahmen trainiert werden, um synthetische Ausgabe zu produzieren, die einer bestimmten Person ähnelt. Die Technologie hat zwei Hauptkategorien: Face-Swap-Deepfakes (Ersetzen des Gesichts einer Person durch eine andere in einem bestehenden Video) und vollständige Synthese (Generierung einer sprechenden Person von Grund auf, typischerweise für Audio-Klons).

Das bekannteste politische Deepfake ist das Kapitulationsvideo des ukrainischen Präsidenten Wolodymyr Selenskyj vom März 2022. Das Video erschien auf der ukrainischen Nachrichtenwebsite Ukraine 24 nach einem Hack, verbreitete sich in sozialen Medien und wurde am selben Tag von Meta, YouTube und Twitter/X entfernt. Selenskyj reagierte innerhalb weniger Stunden auf Telegram und bestätigte, dass das Video gefälscht war. Der UC-Berkeley-Computervision-Forscher Hany Farid analysierte das Video öffentlich und identifizierte eine Low-Resolution-Kodierstrategie zur Verschleierung von Gesichtsverzerrungen, ein unnatürliches Kopfbewegungsmuster und eine Lippensynchronisation, die nicht vollständig zur ukrainischen Phonetik passte. Den vollständig dokumentierten Fall gibt es in der Fake Off Datenbank →.

Das Selenskyj-Video war in seiner politischen Zielrichtung ungewöhnlich. Die Mehrheit der kursierenden Deepfakes sind nicht einvernehmliche intime Bilder (laut Sensity AIs Forschung von 2023 geschätzte über 90% aller Deepfake-Inhalte nach Volumen) und synthetische Audio-Klons für Finanzbetrug. Hochkarätige politische Deepfakes wie das Selenskyj-Video sind relativ selten, werden aber überproportional berichtet.

Weitere dokumentierte Fälle aus dem vergangenen Jahr gibt es im KI und Falschmeldungen: Rückblick 2025 →.

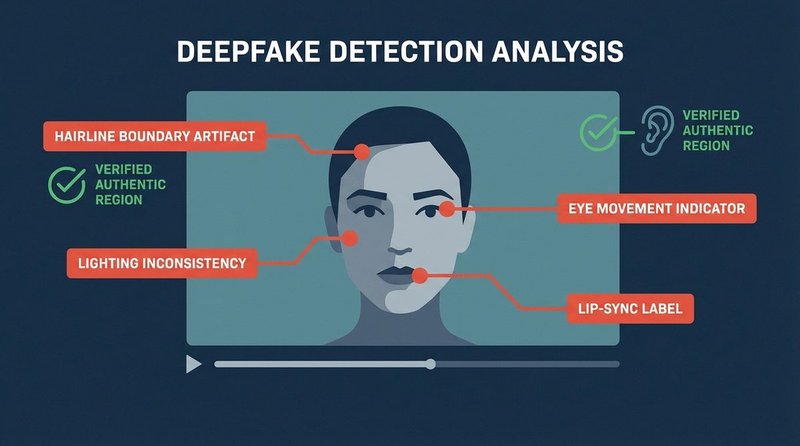

Visuelle Merkmale: Worauf man achten muss

Die Analyse visueller Artefakte funktioniert am besten bei minderwertigen Deepfakes. Hochwertige synthetische Videos von staatlichen Akteuren oder professionellen Operationen können keines dieser Artefakte aufweisen. Visuelle Analyse ist eine erste Prüfung – sie kann schnell ein minderwertiges Fake bestätigen – aber das Fehlen von Artefakten ist keine Bestätigung der Authentizität.

Augenblinzeln und -bewegung

Deepfake-Modelle der ersten Generation (vor 2020) hatten Schwierigkeiten mit realistischem Blinzeln, weil Trainingsdatensätze weniger Frames mit geschlossenen Augen enthielten. Das führte zu Videos, in denen das Motiv selten oder gar nicht blinzelte. Aktuelle Modelle haben dies weitgehend behoben, aber schnelle seitliche Augenbewegungen und unnatürliche Sakkaden (die Micro-Sprünge, die die Augen beim Scannen machen) sind weiterhin schwer überzeugend zu synthetisieren. Schau dir ein Segment mit 0,25-facher Geschwindigkeit an und beobachte, ob die Augenbewegung für eine im Gespräch befindliche Person physisch plausibel aussieht.

Haaransatz und Ohrränder

Face-Swap-Deepfakes blenden ein synthetisches Gesicht über ein bestehendes Video, und der Randbereich – insbesondere der Haaransatz, die Ohren und der Kieferrand – ist der Ort, an dem die Überblendung typischerweise versagt. Achte auf: weiche oder unscharfe Ränder, wo Haare auf Haut treffen, inkonsistente Beleuchtung zwischen Gesicht und Haaren, geometrische Verzerrungen beim Drehen des Kopfes sowie Ohrläppchen, die sich beim Bewegen leicht zu dehnen oder zu verformen scheinen.

Beleuchtungs- und Schattenkonsistenz

Das synthetische Gesicht in einem Face-Swap-Deepfake wird mit Beleuchtung aus dem Quellmaterial gerendert, nicht aus den Beleuchtungsbedingungen des Zielvideos. Wenn eine Person ihren Kopf in natürlichem Licht bewegt, bewegt sich das Highlight- und Schattenmuster auf ihrem Gesicht konsistent mit der Lichtquelle. Bei einem Deepfake kann diese Konsistenz brechen: Das Gesicht kann eine andere Umgebungsbeleuchtung als Hintergrund und Hals aufweisen, oder Schatten tracken bei Kopfbewegungen möglicherweise nicht korrekt.

Lippensync und phonetische Übereinstimmung

Lippensync-Genauigkeit ist einer der Bereiche, in denen sich die Deepfake-Generierung am schnellsten verbessert hat. Das Phonem-zu-Mundform-Mapping – die spezifischen Lippenpositionen für jeden Laut in einer bestimmten Sprache – bleibt jedoch ein Bereich unvollständiger Synthese, besonders für andere Sprachen als Englisch. Das Selenskyj-Video wurde teilweise durch diesen Mechanismus identifiziert: Die ukrainische Phonetik erfordert spezifische bilabiale Bewegungen, die das synthetische Modell nicht vollständig reproduzierte. Bei Audio-only-Deepfakes (Sprachklons): Achte auf unnatürliche Pausen zwischen Wörtern, Prosodie, die nicht zur Satzstruktur passt, und einen gleichmäßigen Rauschboden, der nicht wie eine echte Aufnahme variiert.

Hauttextur und hochfrequente Details

Neuronale Netze synthetisieren Haut als glatte Oberfläche. Echte menschliche Haut hat Poren, feine Linien und unregelmäßige Textur, die über verschiedene Gesichtsregionen variiert. Synthetische Haut ist in ungünstiger Beleuchtung oft zu glatt und kann eine kunststoffartige Reflexion aufweisen. Dies ist am deutlichsten um Nase, Stirn und Wangen bei guter Beleuchtung zu sehen.

Erkennungstools: Was sie leisten und was nicht

Automatisierte Erkennungstools sollten als unterstützende Belege verwendet werden, nicht als endgültige Urteile. Die Erkennungsgenauigkeit variiert erheblich je nach der Generierungsmethode des Deepfakes, und mit älteren Deepfake-Datensätzen trainierte Tools können neuere Generierungstechniken übersehen.

Deepware Scanner

Deepware Scanner (kostenlos, browserbasiert) analysiert hochgeladene Videodateien auf Deepfake-Signaturen mithilfe von Deep-Learning-Modellen. Er gibt einen Wahrscheinlichkeitswert zurück, kein binäres Urteil. Werte über 80% deuten auf wahrscheinlich synthetischen Inhalt hin; Werte zwischen 40–80% sind nicht schlüssig; unter 40% deutet auf wahrscheinlich authentischen Inhalt hin. Verwende Deepware für eine schnelle Erstbewertung, nicht als endgültige Feststellung.

Intel FakeCatcher

Intels FakeCatcher, entwickelt in Zusammenarbeit mit Forschern der State University of New York at Binghamton und angekündigt im November 2022, verwendet einen grundlegend anderen Erkennungsansatz. Statt nach visuellen Artefakten zu suchen, analysiert er Photoplethysmographie (PPG)-Signale – die subtilen Farbveränderungen in der Haut durch den Blutfluss. Echte menschliche Gesichter zeigen kohärente PPG-Signale im gesamten Gesicht; synthetische Gesichter replizieren dieses biologische Signal nicht realistisch. Intel gibt eine Erkennungsgenauigkeit von 96% in kontrollierten Tests an. FakeCatcher steht hauptsächlich für institutionelle und Plattformnutzung zur Verfügung; es ist derzeit kein Verbraucher-Tool.

Sensity AI

Sensity AI bietet Unternehmens-Deepfake-Erkennung für Redaktionen und Plattformen mit einer Forschungsabteilung, die Jahresberichte zu Deepfake-Volumen und -Verbreitungsmustern veröffentlicht. Ihre veröffentlichte Forschung ist eine maßgebliche Quelle für das Verständnis der aktuellen Dimension synthetischer Medien.

Was Tools nicht leisten können

Kein automatisiertes Erkennungstool ist zuverlässig gegen Deepfakes auf staatlichem Niveau – synthetische Medien, die speziell darauf ausgelegt sind, bekannte Erkennungsmethoden zu umgehen. Das bedeutet: Automatisierte Tools können ein minderwertiges bis mittelwertiges Deepfake bestätigen, aber ein negatives Ergebnis garantiert bei hohen Einsätzen keine Authentizität. Kombiniere Tool-Ausgabe mit visueller Analyse und vor allem Provenienzuntersuchung.

Provenienzanalyse: Die zuverlässigste Methode

Für die Mehrheit der in sozialen Medien kursierenden Deepfakes ist die Provenienzanalyse – die Rückverfolgung des Ursprungs und der Verbreitungskette des Inhalts – zuverlässiger als visuelle oder automatisierte Analyse. Ein Video, das zuerst auf bekannten staatlich verknüpften Einflussoperations-Accounts kursiert, das ohne nachprüfbare Ereignisdokumentationskette erscheint und das keine seriöse Nachrichtenorganisation bestätigen kann, sollte unabhängig von seinem Inhalt als unverifiziert behandelt werden.

Provenienzanalyse für Video folgt denselben Prinzipien wie umgekehrte Bildersuche für Fotos. Wende den Workflow der umgekehrten Bildersuche → mit dem InVID/WeVerify-Plugin an, um Schlüsselbilder zu extrahieren und jedes einzeln zu suchen. Für vollständige Videos:

- Finde das erste Auftreten. Wer hat dieses Video zuerst veröffentlicht? Eine Suche auf der Plattform, wo du es gesehen hast, kombiniert mit einer Schlüsselbild-Rückwärtssuche, bringt oft den Original-Upload ans Licht. Ein Video, das zuerst von anonymen Accounts ohne Verbindung zum behaupteten Ereignis veröffentlicht wurde, ist ein Warnsignal.

- Prüfe, ob eine seriöse Quelle das dargestellte Ereignis unabhängig bestätigt hat. Wenn ein Video behauptet, eine politische Aussage einer Person zu zeigen, sollte diese durch offizielle Kanäle – Pressekonferenzen, offizielle Social-Media-Auftritte, Agenturberichte – nachprüfbar sein.

- Prüfe, ob die gezeigte Person eine Stellungnahme abgegeben hat. Die meisten politischen Deepfakes werden schnell von der dargestellten Person widerlegt. Suche nach Reaktionen von den verifizierten offiziellen Accounts der dargestellten Person.

- Untersuche das Verbreitungsnetzwerk. Accounts, die ein vermutetes Deepfake zuerst verbreitet haben, haben oft eine Geschichte der Verbreitung anderer verdächtiger synthetischer oder manipulierter Inhalte. Tools wie der Botometer der Indiana University können helfen zu beurteilen, ob verstärkende Accounts automatisiertes Verhalten zeigen.

KI-Sprachklons: Der Audio-only-Deepfake

Audio-Deepfakes – Sprachklons, die die Stimme einer bestimmten Person mithilfe von KI replizieren – werden zunehmend bei gezieltem Finanzbetrug, nicht einvernehmlicher Identitätsmanipulation und politischer Desinformation eingesetzt. Sie erfordern kein Video und sind deutlich billiger und schneller herzustellen als Video-Deepfakes.

Ein dokumentierter Falltyp: Ein Sprachklon einer politischen Persönlichkeit oder eines CEOs wird verwendet, um Mitarbeitende, Verwandte oder die Öffentlichkeit zu einer Handlung zu veranlassen – Geldüberweisungen, Passwortänderungen oder Unterstützung eines falschen Narrativs. Die Klon-Technologie benötigt laut Forschung zu Microsofts VALL-E-Modell und ähnlichen 2023 veröffentlichten Systemen nur drei Sekunden Trainingsaudio aus einer öffentlich verfügbaren Aufnahme.

Audio-Verifizierungsmerkmale: das Fehlen natürlicher Hintergrundvariationen (echte Aufnahmen haben einen Rauschboden, der schwankt; synthetisches Audio ist oft unnatürlich einheitlich), Prosodieinkonsistenzen (Rhythmus und Betonungsmuster der Sprache, die nicht mit dem dokumentierten Stil des Sprechers übereinstimmen) und das Fehlen von Atemgeräuschen oder Mundgeräuschen zwischen Wörtern.

Deepfake-Erkennung Kurzreferenz

- Visuelle Prüfung (30 Sekunden): Auf Haaransatz-Überblendungsartefakte, Beleuchtungsinkonsistenz zwischen Gesicht und Hintergrund, unnatürliche Augenbewegung und übermäßig glatte Hauttextur bei 0,25-facher Geschwindigkeit achten.

- Lippensync-Prüfung: Passt die Mundform zu den gesprochenen Lauten? Besonders aufmerksam sein, wenn die Sprache nicht Englisch ist.

- Deepware Scanner ausführen für eine automatisierte Wahrscheinlichkeitsbewertung. Nur als unterstützenden Beleg verwenden, nicht als endgültiges Urteil.

- Provenienz zuerst: Wer hat das Video zuerst veröffentlicht? Kann das dargestellte Ereignis durch offizielle Kanäle und seriöse Redaktionen unabhängig bestätigt werden?

- Auf offizielle Widerlegung prüfen: Hat die dargestellte Person auf verifizierten offiziellen Accounts reagiert?

- Bei Audio-only-Clips: Auf einheitlichen Rauschboden, Prosodieinkonsistenzen und das Fehlen natürlicher Atem- oder Mundgeräusche achten.

- Denke daran: Das Fehlen visueller Artefakte bestätigt keine Authentizität bei hochwertigen Deepfakes. Provenienzanalyse ist die skalierbare Methode.