La alfabetización mediática es la capacidad de encontrar, evaluar y usar información de forma eficaz — y de reconocer cuándo la información está diseñada para manipular en lugar de informar. No es una habilidad fija, sino una práctica, y las condiciones que aborda están cambiando más rápido que en cualquier otro momento de la historia de los medios.

Qué significa realmente la alfabetización mediática

El término se aplica de forma laxa, pero una definición operativa importa. La alfabetización mediática abarca tres competencias diferenciadas: la capacidad de reconocer contenido falso o engañoso, la capacidad de verificar afirmaciones a través de fuentes y herramientas independientes, y la capacidad de tomar decisiones informadas sobre compartir información. La ausencia de cualquiera de estas competencias crea una brecha que los actores maliciosos explotan sistemáticamente.

La definición de la UNESCO, que fundamenta la mayoría de los marcos europeos de educación mediática, describe la alfabetización mediática como «la capacidad de acceder, analizar, evaluar y crear medios en diversas formas». El Marco de Alfabetización Mediática del Consejo de Europa de 2021 añade una cuarta dimensión: la capacidad de interactuar con el contenido mediático como participante en los procesos democráticos — no solo como consumidor pasivo. Este sitio usa ambas definiciones como puntos de referencia.

Una aclaración fundamental: la alfabetización mediática no es lo mismo que el escepticismo mediático. El objetivo no es desconfiar de todas las fuentes — es calibrar la confianza en función de la evidencia. La desconfianza generalizada hacia los medios de comunicación mayoritarios es, de hecho, un producto documentado de las campañas de desinformación, no una prueba de pensamiento crítico. La investigación del Reuters Institute y del Shorenstein Center de la Harvard Kennedy School muestra que las poblaciones con altos niveles de escepticismo mediático no son más resistentes a la desinformación — son susceptibles de forma diferente, especialmente ante fuentes no institucionales.

Por qué 2025 cambió el tablero

Tres desarrollos convergentes han hecho que la práctica sea más urgente en los últimos dos años que en cualquier momento de la década anterior.

Medios sintéticos generados por IA a escala

Hasta 2023, producir deepfakes de alta calidad requería hardware especializado y conocimientos técnicos considerables. A finales de 2024, las herramientas de consumo basadas en Stable Diffusion, la síntesis de voz de ElevenLabs y múltiples plataformas de generación de vídeo habían reducido esa barrera prácticamente a cero. Un vídeo sintético convincente de una figura pública puede producirse ahora en minutos con hardware doméstico. La brecha forense — el tiempo entre que un elemento de medios sintéticos circula y su refutación definitiva — se mide en horas o días. Esa ventana es suficiente para cambiar la opinión pública sobre cuestiones urgentes antes de que la corrección llegue a la misma audiencia que vio el original.

Comportamiento inauténtico coordinado a menor coste

El Informe de Amenazas Adversariales de Meta de 2024 documentó un aumento del 61% en campañas de comportamiento inauténtico coordinado (CIB) asistidas por IA en comparación con 2023. La característica definitoria de las campañas actuales no es la escala sino la especificidad: el contenido generado por LLM puede personalizarse para comunidades, idiomas y perfiles emocionales concretos a un coste que era prohibitivo para la propaganda redactada por humanos apenas tres años atrás. Campañas que antes requerían equipos de redactores ahora solo necesitan un prompt y una clave de API.

Erosión de la confianza institucional

El Digital News Report 2024 del Reuters Institute registró una confianza media en los medios de comunicación del 40% en 47 países encuestados — una caída desde el 44% en 2022. La caída de la confianza institucional no hace, por sí sola, a las poblaciones más susceptibles a la desinformación. Pero elimina uno de los principales anclajes que las personas usan para calibrar la información: la reputación de la fuente. Cuando ninguna fuente es de confianza, todas las afirmaciones se tratan como igualmente plausibles, lo que funcionalmente equivale a tratarlas todas como verdaderas — y beneficia a quienes producen desinformación en alto volumen.

Las tres competencias fundamentales

1. Reconocer el contenido falso y engañoso

El reconocimiento es el punto de entrada. Requiere familiaridad con los patrones estructurales que usa el contenido engañoso: lenguaje emocional en los titulares, atribución vaga, estadísticas descontextualizadas, ausencia de fuentes originales y encuadre de urgencia. Estos patrones no prueban la falsedad — son señales de que se justifica más investigación antes de confiar en algo o compartirlo.

La guía sobre Lenguaje Emocional en Titulares cubre los patrones lingüísticos específicos en detalle, con ejemplos de casos documentados en todo el espectro político. El reconocimiento es un requisito previo para la verificación — no puedes verificar contenido que primero no has marcado como necesitado de escrutinio.

2. Verificar afirmaciones

La verificación es la práctica central. Significa rastrear las afirmaciones hasta sus fuentes primarias — estudios originales, registros oficiales, testimonios de primera mano — y evaluar la evidencia por sus propios méritos, no a través de resúmenes intermediarios o encuadres de redes sociales. La mayoría de la desinformación viral es trazable, dados diez minutos y las herramientas adecuadas.

La sección Taller cubre cuatro métodos prácticos de verificación en profundidad: el marco SIFT, la búsqueda inversa de imágenes, el análisis del lenguaje emocional y la detección de deepfakes. La guía de Herramientas de Verificación enumera las herramientas gratuitas más fiables para cada tarea, con notas sobre lo que cada una cubre y lo que no.

3. Compartir de forma responsable

La desinformación se difunde principalmente a través de personas que la creen verdadera. La decisión de compartir es, por tanto, tan importante como la decisión de crear. Compartir de forma responsable significa aplicar al menos una comprobación de verificación básica antes de amplificar una afirmación — especialmente para aquellas que confirman creencias previas, que la investigación demuestra sistemáticamente que se comparten más rápido y con menos escrutinio que las que las desafían.

El estándar práctico es sencillo: si no puedes identificar la fuente original de una afirmación y confirmarla de forma independiente, no la compartas. Si la afirmación produce una reacción emocional intensa, trátala como una razón para frenar, no como una confirmación de que debe ser verdad.

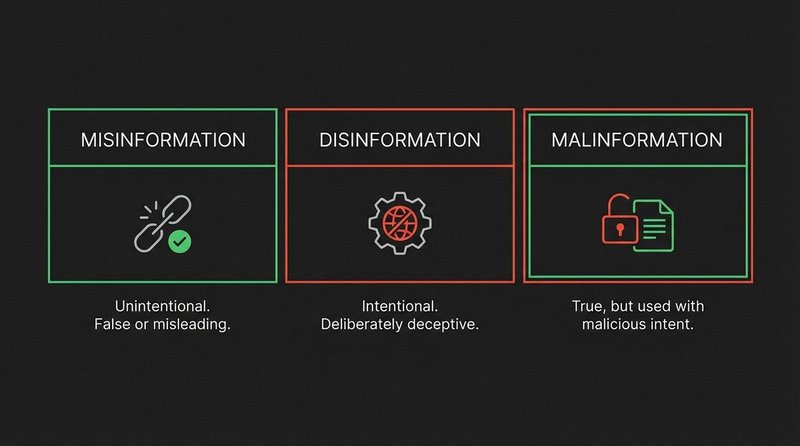

Conceptos clave: desinformación, información errónea, malinformación

Estos tres términos se usan de forma intercambiable en el discurso público, pero describen fenómenos diferentes con causas diferentes y remedios diferentes. La distinción importa para un diagnóstico preciso.

- Información errónea

- Información falsa o inexacta compartida sin intención de engañar. La persona que la difunde cree que es verdadera. Ejemplo: un usuario comparte un mito de salud que encontró y que realmente cree. La respuesta adecuada es información precisa presentada de forma accesible, sin condescendencia — las personas que difunden información errónea no son lo mismo que las que la crean.

- Desinformación

- Información falsa creada y difundida con intención deliberada de engañar. El productor sabe que el contenido es falso y tiene un objetivo estratégico — normalmente político, económico o social. Los ejemplos incluyen operaciones de influencia patrocinadas por estados y citas fabricadas atribuidas a figuras políticas. La respuesta adecuada es la exposición del engaño y su fuente, combinada con el prebunking — inoculando a las audiencias contra la técnica específica antes de que la encuentren a escala.

- Malinformación

- Información precisa utilizada con intención de causar daño — normalmente despojándola de contexto, ajustando el momento de su difusión, o usando información privada para atacar a personas concretas. Ejemplo: una filtración deliberadamente cronometrada de comunicaciones privadas verídicas diseñada para dañar a un candidato en los días previos a unas elecciones. La información en sí es verdadera; la weaponización es el problema. La respuesta adecuada es la restauración del contexto y el análisis de la fuente, no la verificación del contenido.

Para un análisis detallado de cómo interactúan y se superponen estas tres categorías en casos documentados, consulta Desinformación vs. información errónea: qué significa realmente la diferencia.

Prebunking: adelantarse a la desinformación

El debunking — corregir información falsa después de que se ha difundido — es necesario pero limitado. Las correcciones rara vez llegan a la misma audiencia que la afirmación original, y la exposición repetida a una afirmación falsa, incluso en el contexto de una refutación, puede paradójicamente aumentar su memorabilidad (el efecto de verdad ilusoria, documentado en la investigación de Fazio et al., 2015, y replicado en múltiples estudios posteriores).

El prebunking aborda esta limitación inoculando a las personas contra las técnicas de desinformación antes de que encuentren afirmaciones falsas concretas. En lugar de corregir contenido, el prebunking enseña los patrones estructurales que usa el contenido falso — para que la técnica sea reconocible independientemente de la afirmación específica en que se aplique. La investigación del Social Decision-Making Lab de la Universidad de Cambridge y del equipo de jigsaw.google.com ha demostrado que las intervenciones cortas de prebunking reducen la susceptibilidad a las técnicas de desinformación en ensayos controlados.

La sección Taller de este sitio está estructurada como un recurso de prebunking: enseña técnicas de detección, no solo afirmaciones refutadas concretas.

El papel de los algoritmos de plataformas en la difusión de desinformación

El pensamiento crítico individual es necesario pero no suficiente. El diseño de las plataformas determina qué información llega a las personas antes de que se tome ninguna decisión de evaluación individual. Entender cómo funciona la amplificación algorítmica forma parte de la alfabetización mediática en 2025.

Los algoritmos de recomendación de contenido en las principales plataformas sociales se optimizan principalmente para el engagement — no para la exactitud, la relevancia ni el beneficio público. La investigación del MIT Media Lab publicada en Science (Vosoughi, Roy y Aral, 2018) encontró que las noticias falsas se difunden significativamente más rápido y más lejos que las verdaderas en las redes sociales, llegando a seis veces más personas de media. Un factor clave es la novedad: la información falsa tiende a ser más sorprendente que la información precisa, y la sorpresa es una señal fiable de engagement. El algoritmo amplifica lo que genera reacciones, lo que da al contenido manipulador una ventaja estructural.

Esto no significa que los individuos sean impotentes. Significa que los hábitos de verificación descritos en esta guía — pausar antes de compartir, rastrear afirmaciones hasta fuentes primarias, investigar la credibilidad de la fuente — tienen un peso adicional precisamente porque el entorno predeterminado de las plataformas no los favorece. Cada decisión de compartir es también un voto algorítmico por el tipo de contenido que se promueve a continuación.

Recursos en esta sección

El hub de alfabetización mediática contiene guías, listas de comprobación y análisis que cubren la gama completa de competencias descritas anteriormente. Recursos principales disponibles actualmente:

- Desinformación vs. información errónea — qué significa realmente la diferencia

- Herramientas de verificación — Los mejores recursos gratuitos para la verificación independiente

- Cómo enseñar alfabetización mediática a adolescentes — Una guía práctica para educadores

- La anatomía de las noticias falsas virales — Cómo se difunden las historias falsas y por qué

La sección Taller cubre métodos de verificación prácticos con guías paso a paso. La Base de Datos de Noticias Falsas ofrece casos de estudio documentados del mundo real para cada concepto tratado en este hub.