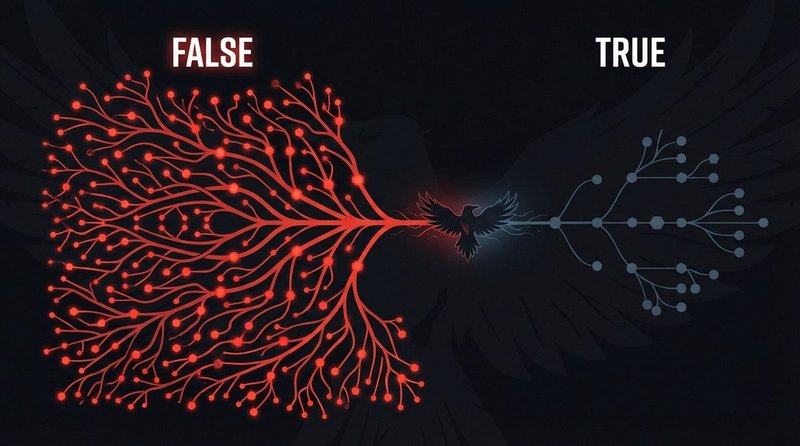

Las noticias falsas se propagan más rápido, más lejos y más profundamente que las verdaderas en las redes sociales — no porque la gente sea irracional, sino porque las historias falsas están diseñadas para explotar los mismos atajos cognitivos que nos hacen eficientes a la hora de procesar información. Entender el mecanismo es el primer paso para resistirlo.

Los Datos: Qué Encontró el Estudio del MIT

La referencia empírica fundamental sobre este tema es un estudio de 2018 de Soroush Vosoughi, Deb Roy y Sinan Aral, publicado en Science (vol. 359, nº 6380). Los investigadores analizaron la propagación de aproximadamente 126.000 historias verificadas por fact-checkers compartidas en Twitter entre 2006 y 2017, por unos 3 millones de personas, más de 4,5 millones de veces.

Los hallazgos fueron inequívocos. Las noticias falsas alcanzaban a 1.500 personas aproximadamente seis veces más rápido que las verdaderas. Se extendían a usuarios únicos de forma más amplia (más personas veían las historias falsas que las verdaderas) y más profundamente (las historias falsas penetraban más lejos en las redes sociales a través de cadenas de propagación más largas). El efecto era más fuerte en la desinformación política. Y lo más importante: los investigadores controlaron los bots. Fueron los humanos, no las cuentas automatizadas, el principal vector de propagación de las noticias falsas. Los bots propagaron historias verdaderas y falsas a tasas similares; el diferencial de amplificación humana fue el hallazgo significativo.

La explicación del estudio para la asimetría: las noticias falsas son más novedosas (contienen información que las audiencias no han visto antes) y más emocionalmente atractivas. Las historias identificadas como falsas por los verificadores generaron respuestas significativamente mayores en las categorías de sorpresa, miedo y asco. Las historias verdaderas generaron más tristeza y anticipación — estados emocionales de menor activación que producen menos comportamiento de compartir.

Disparadores Emocionales: La Arquitectura del Contenido Falso Viral

La desinformación viral explota de forma fiable tres categorías de respuesta emocional. Conocerlas no te hace inmune — las respuestas son fisiológicas — pero crea una breve ventana de evaluación deliberada antes de actuar sobre el impulso de compartir.

Indignación

La indignación moral es el predictor más fiable del comportamiento de compartir en redes sociales. Un estudio de 2017 de Brady et al. en PNAS encontró que cada palabra moral-emocional añadida a un tuit aumentaba las tasas de retuit aproximadamente un 20%. Las historias falsas virales usan sistemáticamente el encuadre de indignación — presentan los eventos como injusticias, traiciones o amenazas a los valores del endogrupo. El contenido no necesita ser completamente falso para desencadenar la indignación; el encuadre selectivo de eventos reales, despojados de contexto, funciona igual de bien.

Miedo

La desinformación basada en amenazas activa la amígdala antes de que la corteza prefrontal pueda aplicar el razonamiento analítico — un fenómeno bien documentado en neurociencia cognitiva. La desinformación sanitaria («Este alimento/vacuna/sustancia te está matando»), la desinformación sobre criminalidad («La delincuencia está aumentando en tu barrio») y las narrativas de amenaza identitaria («Están reemplazando tu cultura») explotan todas las respuestas de miedo. El contenido se propaga rápidamente porque compartirlo parece protector — estás advirtiendo a tu red — lo que crea una motivación prosocial para amplificar información falsa.

Schadenfreude y Satisfacción Tribal

Las historias que validan creencias negativas sobre un exogrupo — adversarios políticos, naciones rivales, enemigos ideológicos — activan circuitos de recompensa en lugar de respuestas de amenaza. Compartirlas produce satisfacción. La investigación de Pennycook & Rand (2019) en Social Psychological and Personality Science encontró que la «congruencia partidista» (contenido que confirmaba creencias políticas existentes) era el predictor más fuerte de la intención de compartir — más fuerte que la precisión percibida del contenido. La gente comparte contenido porque parece verdadero para su visión del mundo, no necesariamente porque crean que es factualmente preciso.

Algoritmos de Plataformas y Optimización del Compromiso

La arquitectura de las plataformas no crea desinformación, pero es un mecanismo de amplificación significativo. El principio de diseño central de los sistemas de recomendación optimizados para el compromiso — maximizar el tiempo en la plataforma — recompensa estructuralmente el contenido que activa emociones, independientemente de su exactitud.

Un estudio interno de Facebook de 2021, reportado por el Wall Street Journal basado en documentos filtrados, encontró que los propios investigadores de Facebook habían identificado que su cambio de algoritmo en 2018 (orientado hacia «interacciones sociales significativas» — contenido que generaba comentarios y reacciones en lugar de vistas pasivas) tuvo el efecto de amplificar el contenido que provoca indignación, incluyendo la desinformación. Los investigadores propusieron soluciones; las soluciones no se implementaron a escala por preocupaciones sobre reducir el compromiso total.

El mecanismo no es exclusivo de Facebook. El algoritmo de recomendación de YouTube, según lo documentado en una auditoría de 2020 de Ribeiro et al., recomendaba consistentemente contenido progresivamente más extremo una vez que un usuario comenzaba a ver contenido en ciertas categorías políticas o conspirativas — un efecto de «agujero de conejo» impulsado por la optimización del tiempo de visualización. La línea de tiempo algorítmica de Twitter/X ha demostrado amplificar el contenido político de tendencia derechista más que el de izquierda en varios países, independientemente de las diferencias de compromiso. El estudio interno de 2021 de la plataforma publicó este hallazgo voluntariamente.

La implicación estructural: las plataformas diseñadas para maximizar el compromiso amplificarán sistemáticamente el contenido que desencadena respuestas emocionales fuertes — que es, por diseño, para lo que están ingeniadas las noticias falsas y engañosas.

El Momento Oportuno: Cuándo las Noticias Falsas Son Más Peligrosas

La información falsa no se propaga uniformemente en el tiempo. Tres contextos específicos crean condiciones donde la desinformación se propaga más rápido y las correcciones son menos eficaces.

Ventanas de Noticias de Última Hora

Los primeros 30-60 minutos después de un evento importante son cuando la información verificada es más escasa y la demanda de la audiencia es más alta. La desinformación llena ese vacío. La investigación del Reuters Institute for the Study of Journalism encuentra consistentemente que las afirmaciones falsas introducidas durante las ventanas de noticias de última hora son más difíciles de corregir que las introducidas después de que los reportajes autorizados estén disponibles, porque la versión falsa a menudo se convierte en el ancla mental que las audiencias usan para evaluar las correcciones posteriores.

Elecciones y Campañas Políticas

Los períodos electorales muestran picos consistentes en el volumen y la velocidad de la desinformación en todos los contextos democráticos estudiados. La base de datos EU vs Disinfo documenta la amplificación en períodos electorales en los estados miembros de la UE en cada ciclo electoral desde 2014. La combinación de altas apuestas políticas, fuerte motivación tribal para compartir contenido favorable y entornos mediáticos fragmentados crea condiciones óptimas para que la información falsa llegue a grandes audiencias antes de que los verificadores puedan responder.

Crisis de Salud Pública

La OMS acuñó el término «infodemia» en febrero de 2020 para describir la epidemia paralela de información sanitaria falsa y engañosa sobre el COVID-19. Su estudio conjunto con organizaciones asociadas encontró que en marzo de 2020, la desinformación sanitaria viajaba más rápido que las directrices oficiales en todas las principales plataformas sociales — consecuencia directa de los mismos mecanismos descritos anteriormente, operando en un entorno de alto miedo e incertidumbre.

Cuentas Superpropagadoras y Efectos de Red

La propagación viral no es uniforme en las redes sociales. Un pequeño número de cuentas muy conectadas y con alto compromiso — a menudo descritas como «superpropagadoras» — son responsables de una parte desproporcionada de la amplificación de la desinformación.

El análisis del Misinformation Monitor de NewsGuard y de investigadores independientes que estudiaron las elecciones de EE.UU. de 2020 encontró consistentemente que un pequeño número de cuentas — a menudo con millones de seguidores, frecuentemente incluyendo figuras políticas prominentes — eran responsables de la mayoría de los episodios de desinformación de alto alcance. El patrón es estructuralmente similar a lo que los epidemiólogos llaman «eventos superspreader» en la transmisión de enfermedades: la mayoría de las personas infectan a cero o una persona; un pequeño número de personas, en las condiciones adecuadas, infectan a cientos.

El análisis de redes a nivel de plataforma de Graphika y el DFRLab ha documentado redes de amplificación coordinada en las que cuentas sin relación orgánica se refuerzan artificialmente el contenido mutuamente — comprimiendo el tiempo entre la publicación inicial y la exposición masiva. Esto hace que la ventana de noticias de última hora sea aún más corta y reduce el tiempo disponible para intervenciones basadas en verificación.

Caso de Estudio: La Anatomía de un Evento Real de Noticias Falsas Virales

En noviembre de 2016, circuló una afirmación falsa de que una pizzería de Washington D.C. llamada Comet Ping Pong era el centro de una red de tráfico de menores dirigida por altos funcionarios del Partido Demócrata. La afirmación — que se conoció como «Pizzagate» — no tenía base probatoria y fue investigada y desestimada por el Departamento de Policía Metropolitana de Washington D.C. Sin embargo, llegó a millones de personas en pocos días y fue citada directamente por un hombre que disparó un rifle dentro del restaurante el 4 de diciembre de 2016, sin causar heridos pero sí daños materiales significativos.

El caso Pizzagate demuestra todos los mecanismos descritos en este artículo operando simultáneamente:

- Disparador emocional: El peligro para menores es una de las preocupaciones morales de mayor activación — desencadenando tanto respuestas de indignación como de miedo.

- El momento oportuno: Surgió inmediatamente después de las elecciones de EE.UU. de 2016, en un momento de máximo compromiso político con alta motivación partidista para compartir información dañina sobre el partido contrario.

- Amplificación por superpropagadores: La afirmación fue promovida por cuentas con grandes audiencias en Twitter y YouTube, incluyendo algunas con cientos de miles de seguidores, antes de que se aplicaran los mecanismos de moderación de las plataformas.

- Optimización algorítmica: El algoritmo de recomendación de YouTube, según análisis posteriores, dirigía a los usuarios desde contenido electoral convencional hacia vídeos de Pizzagate a través de rutas predecibles de escalada de contenido.

- Asimetría de corrección: Para cuando el Washington Post, el New York Times y múltiples verificadores habían publicado desmentidos completos, la versión falsa ya había llegado a más personas de las que alcanzaría cualquier corrección posterior. El hallazgo de Vosoughi et al. sobre la propagación seis veces más rápida de las noticias falsas queda directamente ilustrado aquí.

Un análisis documentado de la operación de información de Pizzagate, incluyendo el mapeo de la propagación, es mantenido por el Observatorio Europeo de Medios Digitales (EDMO) como caso de estudio de referencia en operaciones de influencia coordinada.

Entender estos mecanismos a nivel estructural es el requisito previo fundamental para evaluar el contenido antes de compartirlo. La guía sobre Desinformación vs. Malinformación → explica cómo la intención se relaciona con estas mecánicas virales. El taller de Lenguaje Emocional en los Titulares → proporciona práctica práctica para identificar el encuadre de disparador en titulares reales. Los casos virales documentados con análisis completo de propagación están disponibles en la Base de Datos de Fake News →. Vuelve al Hub de Alfabetización Mediática → para la ruta de aprendizaje completa.