Desinformación e información errónea no son sinónimos. La diferencia — la intención — determina qué contramedidas funcionan y cuáles fracasan. Tratar toda información falsa como engaño deliberado lleva a las intervenciones equivocadas; ignorar la intención maliciosa permite que las campañas coordinadas operen sin resistencia.

Tres categorías, un marco

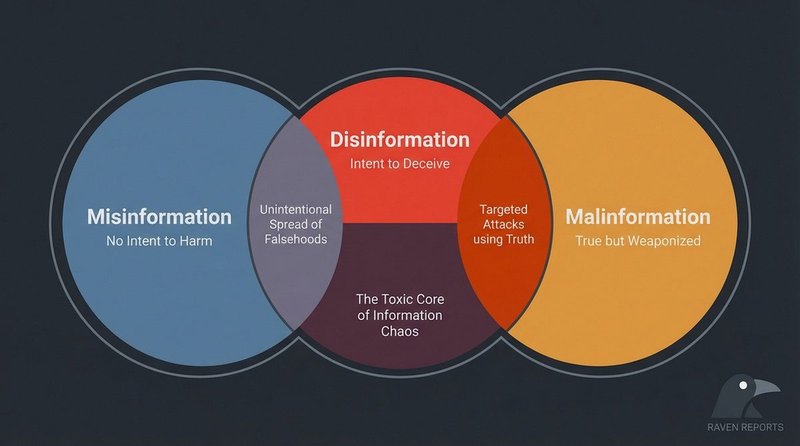

El marco más citado para entender la información falsa proviene de la investigadora Claire Wardle y sus colegas en First Draft, cuyo informe de 2017 Information Disorder — desarrollado posteriormente en un modelo completo para el Consejo de Europa — distingue tres fenómenos distintos que se articulan en torno a dos ejes: si el contenido es falso y si el creador tiene intención de causar daño.

- Información errónea

- Información falsa o inexacta compartida sin intención de causar daño. La persona que la difunde cree que es verdadera. Ejemplos: un padre que comparte en un grupo de WhatsApp familiar un remedio casero refutado, o un periodista que cita de buena fe una estadística no verificada. El contenido está equivocado; el motivo no es malicioso.

- Desinformación

- Información falsa o engañosa creada y difundida con intención deliberada de engañar o causar daño. La fuente sabe que la información es falsa — o actúa con indiferencia temeraria hacia su exactitud — y la distribuye de todas formas para lograr un objetivo: manipulación política, beneficio económico, daño reputacional o desestabilización de la confianza pública. Las citas fabricadas atribuidas a políticos, las campañas coordinadas para desacreditar a periodistas y la interferencia electoral patrocinada por estados entran aquí.

- Malinformación

- Información que es verdadera, pero instrumentalizada para causar daño. Esta categoría es la más contraintuitiva: no se hace ninguna afirmación falsa, pero la divulgación selectiva de información privada precisa — un correo electrónico hackeado, una fotografía filtrada, registros médicos reales — se usa para dañar a un objetivo concreto. El Código de Prácticas sobre Desinformación de la UE y las directrices del Consejo de Europa tratan ambos la malinformación como una categoría diferenciada que requiere respuestas regulatorias distintas a las otras dos.

El currículo de alfabetización mediática e informacional de la UNESCO adopta una taxonomía compatible, subrayando que el término paraguas «noticias falsas» es analíticamente insuficiente y potencialmente engañoso — confunde categorías que requieren respuestas fundamentalmente diferentes.

Por qué la intención lo cambia todo

La intención no es solo una cuestión ética — es una cuestión práctica que determina qué intervenciones son eficaces.

Cuando la información falsa se difunde porque la gente la cree verdadera (información errónea), las respuestas más eficaces son educativas: debunking, prebunking y mejora de la alfabetización mediática. Las personas que compartieron información incorrecta de buena fe suelen rectificar cuando se les facilita información precisa y una forma fácil de hacerlo. La investigación de Pennycook et al. (2020) en PNAS encontró que simplemente pedir a las personas que considerasen la exactitud antes de compartir redujo la difusión de información errónea en estudios simulados.

Cuando la información falsa es desinformación — fabricada deliberadamente — las respuestas educativas por sí solas son insuficientes. La fuente no actualizará su comportamiento basándose en verificaciones de hechos. Las contramedidas eficaces incluyen la aplicación a nivel de plataforma, marcos legales (como la Ley de Servicios Digitales de la UE), investigación de atribución para exponer el comportamiento inauténtico coordinado, y comunicación estratégica que inocula preventivamente a las audiencias. El proyecto EU vs Disinfo mantiene una base de datos continua de casos documentados de desinformación del Kremlin — más de 16.000 entradas a principios de 2026 — precisamente porque nombrar la fuente es una parte necesaria de la respuesta.

La malinformación exige otro conjunto de herramientas: principalmente mecanismos legales sobre privacidad, protección de datos y transparencia de las plataformas — no verificación de hechos, ya que los hechos subyacentes son precisos.

Ejemplos reales de las tres categorías

Información errónea en la práctica

Durante los primeros meses de la pandemia de COVID-19, afirmaciones de que beber líquidos calientes podía matar el virus SARS-CoV-2 circularon ampliamente en aplicaciones de mensajería. La mayoría de las personas que compartían estos mensajes creían genuinamente estar siendo útiles. La página de desmentidos de la OMS documentó docenas de casos similares en los que el intercambio bienintencionado aceleró la difusión de información sanitaria errónea. No fue necesaria ninguna campaña coordinada; personas ansiosas en un entorno de alta incertidumbre amplificaron información plausible pero falsa de forma orgánica.

Desinformación en la práctica

La evaluación de la Comunidad de Inteligencia de EE.UU. de 2017 sobre la interferencia rusa en las elecciones de 2016 documentó una campaña de desinformación coordinada que implicaba contenido fabricado, personas falsas y amplificación algorítmica. Operativos de la Internet Research Agency crearon miles de cuentas en redes sociales para hacerse pasar por voces americanas auténticas sobre cuestiones políticas divisivas — una operación de desinformación de manual donde los creadores sabían que el contenido era falso y la intención era la manipulación política explícita.

Malinformación en la práctica

La publicación en 2016 de los correos electrónicos privados de John Podesta — obtenidos a través de un ataque de phishing dirigido a su cuenta de Gmail y publicados a través de WikiLeaks — es un caso documentado de malinformación. Los correos eran reales. No se fabricó ningún contenido. Pero su publicación selectiva, cronometrada para dañar una campaña política, constituye información verdadera instrumentalizada según la definición establecida en el marco de Wardle/First Draft. El rastreador de operaciones cibernéticas del Council on Foreign Relations clasifica esta operación bajo operaciones de información.

Las zonas grises

El modelo de tres categorías es una herramienta analítica útil, no una taxonomía hermética. Los casos reales frecuentemente ocupan territorio superpuesto.

Considera una publicación viral en redes sociales que contiene una estadística genuina presentada sin contexto, de una forma que el publicante sabe que llevará a las audiencias a una conclusión falsa. El dato es verdadero; el encuadre es deliberadamente engañoso. Esto se sitúa entre la información errónea (ninguna afirmación falsa) y la desinformación (engaño deliberado). El marco de Wardle recoge esto con un espectro de «siete tipos de desinformación e información errónea» que van desde la sátira y la parodia hasta el contenido fabricado — reconociendo que la intención y la falsedad son variables continuas, no interruptores binarios.

Una segunda zona gris habitual es la amplificación partidista: cuando una narrativa de desinformación, creada originalmente por un actor coordinado, es recogida y compartida por ciudadanos ordinarios que ahora la creen genuinamente. La creación inicial fue desinformación; la difusión posterior es información errónea. La investigación de atribución de organizaciones como Graphika y el Digital Forensic Research Lab (DFRLab) se centra en identificar la fuente coordinada original, precisamente porque el intercambio orgánico posterior no es el problema principal.

Una tercera complejidad son los hechos contestados: afirmaciones en áreas donde existe genuina incertidumbre científica, o donde la opinión experta está legítimamente dividida. Clasificar una afirmación empírica contestada como desinformación requiere establecer tanto que es falsa como que la fuente lo sabía. Esta distinción importa enormemente para la libertad de expresión: el exceso en la etiquetación de discurso contestado como desinformación es en sí mismo un vector de abuso documentado, utilizado por gobiernos autoritarios para suprimir la disidencia legítima.

Implicaciones para las contramedidas

Entender la categoría de información falsa con la que se está tratando es un requisito previo para elegir una respuesta eficaz. La siguiente lista mapea los tipos de intervención con las categorías del desorden informativo:

- Educación en alfabetización mediática — aborda principalmente la información errónea, donde la capacidad de la audiencia para evaluar fuentes es la variable clave.

- Prebunking / teoría de la inoculación — eficaz ante información errónea y desinformación en fase temprana; la investigación de Lewandowsky & van der Linden (2021) muestra que exponer a las audiencias a formas debilitadas de técnicas de manipulación genera resistencia.

- Aplicación en plataformas (eliminación de contenido, reducción de alcance, etiquetado) — apunta a la desinformación en la capa de distribución; la eficacia depende de la velocidad de aplicación relativa a la difusión viral.

- Atribución y exposición — apunta a la desinformación en la fuente; nombrar a los actores coordinados eleva el coste de llevar a cabo operaciones de influencia.

- Herramientas legales y regulatorias — relevantes tanto para la desinformación (DSA de la UE, leyes nacionales de integridad electoral) como para la malinformación (ley de protección de datos, acciones por privacidad).

- Correcciones y debunking — más eficaces para la información errónea; menos eficaces para la desinformación, donde la fuente no se actualizará, y donde las correcciones pueden paradójicamente amplificar la afirmación falsa original a través del «dividendo del mentiroso» — el fenómeno en que las acusaciones de desinformación se despliegan para desacreditar informaciones precisas.

Para un método estructurado de evaluar cualquier afirmación concreta antes de compartirla, consulta nuestra guía del Método SIFT →. Para casos del mundo real ordenados por categoría y patrón, la Base de Datos de Noticias Falsas → ofrece ejemplos documentados con notas metodológicas completas. El Hub de Alfabetización Mediática → conecta todos los conceptos tratados aquí en un camino de aprendizaje estructurado.