Detectar noticias falsas es una habilidad que se aprende, no un rasgo de personalidad. Esta sección del taller desglosa cuatro métodos prácticos — cada uno aplicable sin herramientas especializadas, acceso institucional ni formación previa.

Qué cubre este taller

Los métodos aquí documentados no son marcos teóricos. Son flujos de trabajo de verificación que usan verificadores de hechos profesionales, periodistas e investigadores digitales — adaptados para cualquier persona con acceso a internet y mente crítica.

Cada método está documentado en una guía específica con instrucciones paso a paso, ejemplos reales de la Base de Datos de Noticias Falsas y una lista de comprobación para consulta rápida. Esta página presenta los cuatro métodos. Sigue los enlaces a las guías completas para aplicarlos en la práctica.

El taller es gratuito y no requiere registro. Todas las guías están redactadas para uso independiente — no es necesario seguirlas en orden. Elige el método más relevante para el tipo de contenido que quieres evaluar.

Al completar este taller, serás capaz de:

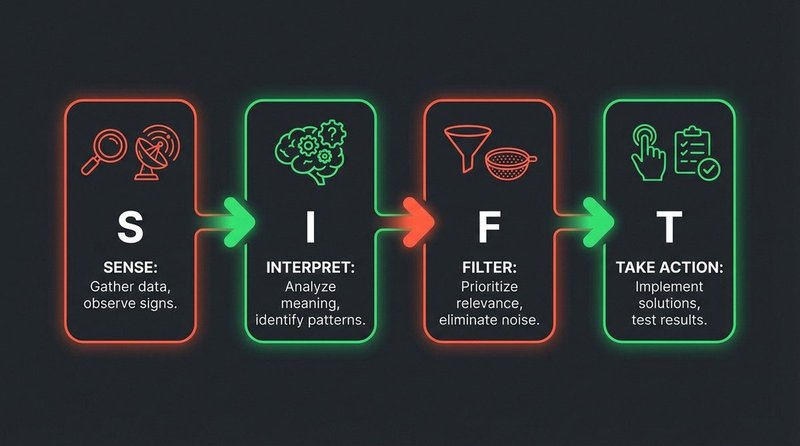

- Aplicar el método SIFT para evaluar cualquier información en línea antes de compartirla

- Usar la búsqueda inversa de imágenes para verificar o refutar afirmaciones visuales

- Reconocer los patrones de lenguaje emocional que señalan contenido manipulador

- Identificar los marcadores técnicos y de comportamiento clave de los vídeos generados por IA (deepfakes)

Método 1 — SIFT: un marco de verificación en cuatro pasos

SIFT es el método de verificación de información más ampliamente adoptado en la educación para la alfabetización mediática. Fue desarrollado por Mike Caulfield en la Universidad Estatal de Washington y actualmente se usa en currículos de educación primaria y secundaria, programas universitarios y formación periodística profesional en Estados Unidos y Europa.

El método aborda un problema concreto: la mayoría de las personas evalúan la información según cómo les hace sentir, no según la evidencia. SIFT interrumpe ese automatismo introduciendo una fricción estructurada — cuatro pasos deliberados que ocurren antes de compartir o formarse una opinión.

Método 2 — Búsqueda inversa de imágenes

Las imágenes reutilizadas son uno de los vectores más comunes en las noticias falsas. Una foto de una inundación de 2013 se comparte como prueba de un desastre de 2024. Una imagen de una protesta en un país se presenta con el pie de foto de otro. La búsqueda inversa de imágenes desmonta esta táctica en menos de dos minutos.

El proceso principal: haz clic derecho sobre cualquier imagen en línea y selecciona «Buscar imagen» (Chrome/Edge), o súbela directamente a Google Images, TinEye o Yandex Images. La búsqueda devuelve todas las instancias indexadas de esa imagen — con fechas, fuentes y pies de foto originales. Una imagen que apareció por primera vez años antes del evento que afirma documentar casi con certeza está siendo utilizada de forma engañosa.

Las principales técnicas avanzadas que cubre la guía completa: buscar por captura de pantalla cuando la subida directa falla, usar Yandex para mayor cobertura (especialmente eficaz para fuentes de Europa del Este y en ruso), y combinar la búsqueda inversa con la inspección de metadatos EXIF para imágenes que no han sido ampliamente indexadas. La guía también explica cómo manejar copias recortadas o con ajustes de color, que pueden eludir una búsqueda inversa básica.

Guía completa de búsqueda inversa de imágenes — paso a paso con herramientas →

Método 3 — Reconocer el lenguaje emocional en los titulares

El lenguaje cargado emocionalmente en los titulares no es, por sí solo, evidencia de noticias falsas — los eventos reales pueden y generan reacciones intensas. Pero un conjunto consistente de técnicas de manipulación emocional es una señal de alarma fiable de que el contenido prioriza la reacción sobre la precisión.

Los patrones que hay que vigilar: lenguaje absoluto («NUNCA», «SIEMPRE», «DESTROZA», «DEMUESTRA DE UNA VEZ POR TODAS»), atribución vaga pero alarmante («los expertos advierten», «las fuentes confirman» sin nombres ni instituciones), encuadre de urgencia («antes de que lo borren», «comparte antes de que lo quiten»), y encuadre de amenaza identitaria («lo que están haciendo a tus hijos/tu comunidad/tu país»). Estos patrones aparecen tanto en el clickbait de baja calidad como en la desinformación sofisticada patrocinada por estados, razón por la cual reconocerlos es una habilidad transferible entre tipos de contenido.

Ninguno de estos patrones prueba que una afirmación sea falsa. Indican que el contenido está diseñado para producir una reacción antes de que el lector evalúe la evidencia. El paso «Para» del método SIFT es la respuesta conductual directa a esta técnica — ralentiza el impulso de compartir el tiempo suficiente para aplicar aunque sea un escrutinio mínimo.

Guía completa: Lenguaje emocional en titulares — patrones y ejemplos →

Método 4 — Identificar deepfakes

El vídeo sintético generado por IA (deepfakes) se ha vuelto técnicamente accesible hasta el punto de que cualquier persona con hardware doméstico puede producir intercambios de cara y clones de voz convincentes. La detección es cada vez más difícil, pero no imposible — los métodos actuales de generación de deepfakes dejan patrones de artefactos consistentes que siguen siendo identificables con un análisis atento.

Los indicadores visuales más fiables en la actualidad: patrones de parpadeo antinaturales o ausencia de parpadeo, iluminación inconsistente entre el rostro del sujeto y el entorno, desenfoque o distorsión en los bordes de la línea del cabello y los oídos, sincronización de audio con los labios inconsistente visible fotograma a fotograma, y suavizado antinatural de la textura de la piel (un subproducto del proceso de renderizado neuronal). Ningún indicador aislado es concluyente. Una combinación de tres o más justifica un escrutinio serio.

Las herramientas técnicas que cubre la guía completa incluyen Deepware Scanner y el método FakeCatcher desarrollado por Intel Research. El análisis conductual y de procedencia es igualmente importante: las preguntas de quién publicó este vídeo, a través de qué canal, con qué historia de origen declarada y si el contexto coincide con el contenido suelen resolverse más rápido que el análisis de artefactos técnicos.

Guía completa de detección de deepfakes — herramientas y análisis paso a paso →

A quién va dirigido este taller

Estudiantes

Estudiantes de secundaria y universidad que navegan en entornos saturados de información. Cada método está diseñado para aplicarse rápidamente — una comprobación SIFT lleva dos minutos, una búsqueda inversa de imágenes lleva uno. No se requieren herramientas ni cuentas especializadas. Las guías usan casos reales de la base de datos como ejemplos resueltos, en lugar de escenarios hipotéticos.

Profesores y educadores

Cada guía incluye ejemplos resueltos y listas de comprobación descargables aptas para uso en el aula. Las guías sobre SIFT y lenguaje emocional se ajustan directamente a los estándares de competencia en alfabetización mediática de los currículos de Alemania, Austria y la UE. Para materiales de taller personalizados o apoyo en la planificación de sesiones, usa el formulario de contacto.

Periodistas e investigadores

Las guías de búsqueda inversa de imágenes y detección de deepfakes profundizan más en los aspectos técnicos y hacen referencia a herramientas de nivel profesional junto a las opciones gratuitas. La Base de Datos de Noticias Falsas ofrece casos de estudio documentados organizados por categoría de método, útiles para investigación o como material docente en programas de periodismo.

Common Misinformation Patterns

These patterns appear repeatedly in fake news content. Learning to recognise them is the first step toward media literacy.

Ready to practice?

Browse real documented cases in our database and test your ability to spot the patterns.

Open the Database