Los deepfakes son vídeo y audio generados o manipulados por IA que hacen que una persona parezca decir o hacer algo que nunca dijo ni hizo. El análisis de artefactos visuales detecta los deepfakes de menor calidad, pero el análisis de procedencia — rastrear dónde apareció por primera vez un vídeo y quién lo publicó — es el método más fiable para la mayoría de los medios manipulados que circulan en línea.

Qué Son los Deepfakes y Qué Frecuencia Tienen

El término «deepfake» se refiere específicamente a medios generados o manipulados mediante aprendizaje profundo — redes neuronales entrenadas con grandes conjuntos de datos de vídeo o audio real para producir contenido sintético que se asemeja a una persona específica. La tecnología tiene dos categorías principales: deepfakes de intercambio facial (que reemplazan el rostro de una persona por el de otra en un vídeo existente) y síntesis completa (que genera a una persona hablando desde cero, típicamente para clones de audio).

El deepfake político más documentado es el vídeo de rendición del presidente ucraniano Volodímir Zelenski de marzo de 2022. El vídeo apareció en el sitio web de noticias ucraniano Ukraine 24 tras un hackeo, circuló ampliamente en redes sociales y fue eliminado por Meta, YouTube y Twitter/X el mismo día. Zelenski respondió en pocas horas en Telegram confirmando que el vídeo era fabricado. El investigador de visión por computadora de UC Berkeley Hany Farid analizó el vídeo públicamente, identificando una estrategia de codificación de baja resolución usada para disimular distorsiones faciales, un patrón de movimiento de cabeza antinatural y una sincronización labial que no coincidía completamente con la fonética ucraniana. El caso completo documentado está en la base de datos de Fake Off →.

El vídeo de Zelenski fue inusual por su objetivo político. La mayoría de los deepfakes en circulación son imágenes íntimas no consentidas (estimadas en más del 90% de todo el contenido deepfake por volumen, según la investigación de Sensity AI de 2023) y clones de audio sintéticos usados para fraude financiero. Los deepfakes políticos de alto perfil como el vídeo de Zelenski son relativamente raros pero desproporcionadamente reportados.

Consulta también el resumen de IA y noticias falsas: 2025 → para ver casos documentados del año pasado.

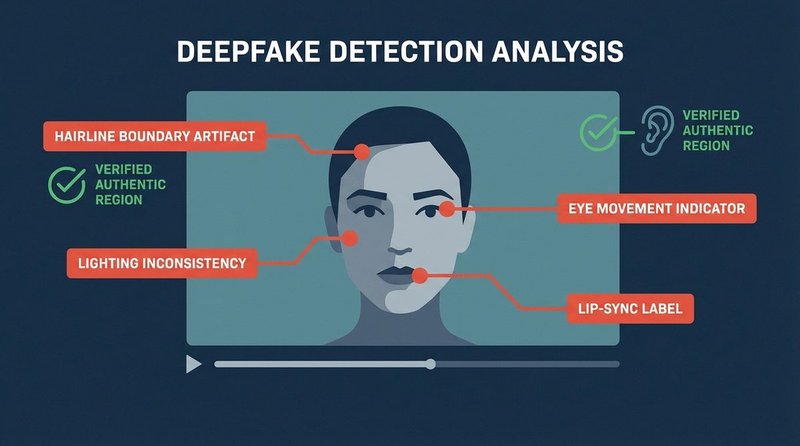

Indicadores Visuales: Qué Buscar

El análisis de artefactos visuales funciona mejor con deepfakes de menor calidad. Los vídeos sintéticos de alta calidad producidos por actores estatales u operaciones profesionales pueden no mostrar ninguno de estos artefactos. Aplica el análisis visual como primera comprobación — puede confirmar rápidamente un falso de baja calidad — pero no confíes en la ausencia de artefactos como confirmación de autenticidad.

Parpadeo y Movimiento Ocular

Los modelos de deepfake de primera generación (anteriores a 2020) tenían dificultades con el parpadeo realista porque los conjuntos de datos de entrenamiento contenían menos fotogramas con ojos cerrados que con ojos abiertos. Esto producía vídeos donde el sujeto parpadeaba raramente o en absoluto. Los modelos actuales han corregido en gran medida esto, pero el movimiento lateral rápido de los ojos y las sacadas antinaturales (los micro-saltos que hacen los ojos al explorar) siguen siendo difíciles de sintetizar de forma convincente. Reproduce un segmento a velocidad 0,25x y observa si el movimiento ocular parece físicamente plausible para alguien hablando de forma conversacional.

Línea del Cabello y Bordes de las Orejas

Los deepfakes de intercambio facial fusionan un rostro sintético sobre un vídeo existente, y la región de la frontera — especialmente la línea del cabello, las orejas y el borde de la mandíbula — es donde la fusión suele fallar. Busca: bordes suaves o borrosos donde el cabello se une a la piel, iluminación inconsistente entre el rostro y el cabello, distorsiones geométricas cuando el sujeto gira la cabeza, y lóbulos de oreja que parecen estirarse o deformarse ligeramente durante el movimiento. Estos artefactos son más visibles en fotogramas estáticos de alta resolución extraídos del vídeo que durante la reproducción.

Consistencia de Iluminación y Sombras

El rostro sintético en un deepfake de intercambio facial se renderiza con iluminación derivada del metraje fuente, no de las condiciones de iluminación del vídeo objetivo. Cuando una persona mueve la cabeza bajo luz natural, el patrón de luz y sombra en su rostro se mueve de forma consistente con la fuente de luz. En un deepfake, esta consistencia puede romperse: el rostro puede parecer tener una fuente de luz ambiental diferente a la del fondo y el cuello, o las sombras pueden no seguir correctamente el movimiento de la cabeza.

Sincronización Labial y Coincidencia Fonética

La precisión de la sincronización labial es una de las áreas donde la generación de deepfakes ha mejorado más rápidamente. Sin embargo, el mapeo fonema-forma de boca — las posiciones labiales específicas requeridas para cada sonido en un idioma particular — sigue siendo un área de síntesis imperfecta, especialmente para idiomas distintos del inglés. El vídeo de Zelenski fue identificado parcialmente mediante este mecanismo: la fonética ucraniana requiere movimientos bilabiales específicos que el modelo sintético no reprodujo completamente. Para deepfakes solo de audio (clones de voz), escucha: pausas antinaturales entre palabras, prosodia que no coincide con la estructura de la frase y un piso de ruido constante que no varía como lo haría una grabación real.

Textura de Piel y Detalle de Alta Frecuencia

Las redes neuronales sintetizan la piel como una superficie lisa. La piel humana real tiene poros, líneas finas y textura irregular que varía en distintas regiones del rostro. En vídeo, la textura de la piel se renderiza dinámicamente — cambia con el movimiento y la iluminación. La piel sintética tiende a ser demasiado lisa bajo iluminación poco favorecedora y puede mostrar una reflectividad parecida al plástico. Esto es más visible alrededor de la nariz, la frente y las mejillas cuando el sujeto está bien iluminado.

Herramientas de Detección: Qué Hacen y Qué No Hacen

Las herramientas de detección automatizadas deben usarse como evidencia de apoyo, no como veredictos definitivos. La precisión de detección varía significativamente según el método de generación utilizado para crear el deepfake, y las herramientas entrenadas con conjuntos de datos de deepfakes más antiguos pueden no detectar técnicas de generación más recientes.

Deepware Scanner

Deepware Scanner (gratuito, basado en navegador) analiza archivos de vídeo subidos en busca de firmas de deepfakes usando modelos de aprendizaje profundo. Devuelve una puntuación de probabilidad en lugar de un veredicto binario. Las puntuaciones superiores al 80% indican contenido sintético probable; las puntuaciones entre 40-80% son no concluyentes; por debajo del 40% indica probable autenticidad. Usa Deepware para una primera evaluación rápida, no como determinación final.

Intel FakeCatcher

FakeCatcher de Intel, desarrollado en colaboración con investigadores de la Universidad Estatal de Nueva York en Binghamton y anunciado en noviembre de 2022, usa un enfoque de detección fundamentalmente distinto. En lugar de buscar artefactos visuales, analiza señales de fotopletismografía (PPG) — los sutiles cambios de color en la piel causados por el flujo sanguíneo a medida que bombea el corazón. Los rostros humanos reales muestran señales PPG coherentes en toda la cara; los rostros sintéticos no replican esta señal biológica de forma realista. Intel afirma una tasa de precisión de detección del 96% en pruebas controladas. FakeCatcher está disponible principalmente para uso institucional y de plataformas; actualmente no es una herramienta de consumo, pero su metodología representa la dirección hacia la que se dirige la detección automatizada.

Sensity AI

Sensity AI proporciona detección de deepfakes empresarial para redacciones y plataformas, con una división de investigación que publica informes anuales sobre el volumen y los patrones de distribución de deepfakes. Su API de detección no es gratuita públicamente, pero su investigación publicada es una fuente autorizada para entender la escala actual de los medios sintéticos.

Lo Que las Herramientas No Pueden Hacer

Ninguna herramienta de detección automatizada es fiable contra los deepfakes adversariales de nivel estatal — medios sintéticos específicamente optimizados para eludir los métodos de detección conocidos. La existencia de deepfakes adversariales está bien documentada en la literatura académica. Esto significa que las herramientas automatizadas pueden confirmar un deepfake de calidad baja o media, pero un resultado negativo («probablemente auténtico») no garantiza la autenticidad cuando el riesgo es alto. Combina los resultados de las herramientas con el análisis visual y, sobre todo, con la investigación de procedencia.

Análisis de Procedencia: El Método Más Fiable

Para la mayoría de los deepfakes que circulan en redes sociales, el análisis de procedencia — rastrear el origen y la cadena de distribución del contenido — es más fiable que el análisis visual o automatizado. Un vídeo que circula primero en cuentas vinculadas a operaciones de influencia estatales conocidas, que aparece sin una cadena verificable de documentación del evento y que ninguna organización de noticias creíble puede corroborar debe tratarse como no verificado independientemente de lo que muestre.

El análisis de procedencia para vídeo sigue los mismos principios que la búsqueda inversa de imágenes para fotografías. Aplica el flujo de trabajo de Búsqueda Inversa de Imágenes → usando el plugin InVID/WeVerify para extraer fotogramas clave y buscar cada uno de forma independiente. Para vídeos completos:

- Encuentra la primera aparición. ¿Quién publicó este vídeo primero? Una búsqueda en la plataforma donde lo encontraste, combinada con una búsqueda inversa de fotogramas clave, suele mostrar la subida original. Un vídeo publicado primero por cuentas anónimas sin conexión con el evento afirmado es una señal de alerta.

- Comprueba si algún medio creíble ha verificado de forma independiente el evento representado. Si un vídeo afirma mostrar a una figura política haciendo una declaración, esa declaración debería ser verificable a través de canales oficiales — ruedas de prensa, redes sociales oficiales, reportajes de agencias de noticias. La ausencia de cualquier corroboración es significativa.

- Comprueba si el supuesto hablante ha emitido una declaración. La mayoría de los deepfakes políticos son repudiados rápidamente por la persona representada. Busca respuestas de las cuentas verificadas oficiales y las comunicaciones oficiales de la persona representada.

- Examina la red de distribución. Las cuentas que difunden primero un deepfake sospechoso a menudo tienen historiales de difundir otro contenido sintético o manipulado sospechoso. Herramientas como el Botometer de la Universidad de Indiana pueden ayudar a evaluar si las cuentas amplificadoras muestran patrones de comportamiento automatizado.

Clones de Voz con IA: El Deepfake Solo de Audio

Los deepfakes de audio — clones de voz que replican la voz de una persona específica mediante IA — se usan cada vez más en fraudes financieros dirigidos, suplantación no consentida y desinformación política. No requieren vídeo y son significativamente más baratos y rápidos de producir que los deepfakes de vídeo.

Un tipo de caso documentado: un clon de voz de una figura política o CEO se usa para instruir a empleados, familiares o al público a que realicen una acción — transferir fondos, cambiar una contraseña de seguridad o apoyar una narrativa falsa. La tecnología de clonación requiere tan solo tres segundos de audio de entrenamiento de cualquier grabación disponible públicamente, según investigaciones del modelo VALL-E de Microsoft y sistemas similares publicadas en 2023.

Los indicadores de verificación de audio incluyen: ausencia de variación natural del ruido de fondo (las grabaciones reales tienen un piso de ruido que cambia; el audio sintético suele ser uniformemente antinatural), inconsistencias prosódicas (los patrones de ritmo y énfasis del habla no coinciden con el estilo documentado del hablante), y ausencia de sonidos de respiración o ruidos de boca entre palabras. Para audio de alta importancia, la comparación con grabaciones autenticadas del mismo período de tiempo es la comprobación más fiable.

Referencia Rápida para Identificar Deepfakes

- Comprobación visual (30 segundos): Busca artefactos de fusión en la línea del cabello, inconsistencia de iluminación entre rostro y fondo, movimiento ocular antinatural y textura de piel excesivamente suave a velocidad 0,25x.

- Comprobación de sincronización labial: ¿La forma de la boca coincide con los sonidos que se pronuncian? Presta especial atención si el discurso está en un idioma distinto del inglés.

- Ejecuta Deepware Scanner para una evaluación automatizada de probabilidad. Úsalo solo como evidencia de apoyo, no como veredicto final.

- La procedencia primero: ¿Quién publicó el vídeo primero? ¿Puede el evento representado corroborarse de forma independiente a través de canales oficiales y redacciones creíbles?

- Busca repudio oficial: ¿Ha respondido la persona representada en cuentas oficiales verificadas?

- Para clips solo de audio: Escucha piso de ruido uniforme, inconsistencias prosódicas y ausencia de respiración natural o sonidos de boca.

- Recuerda: La ausencia de artefactos visuales no confirma autenticidad en deepfakes de alta calidad. El análisis de procedencia es el método que escala.