El número de deepfakes reportados a nivel mundial pasó de aproximadamente 500.000 en 2023 a un estimado de 8 millones en 2025 — un aumento del 1.500% en dos años. Esa cifra no es una predicción. Es una escalada documentada, visible en bases de datos de casos, informes de transparencia de plataformas y los archivos forenses de las organizaciones de verificación. Este artículo cubre las principales categorías de casos, los métodos de detección que funcionan y el marco regulatorio que está tomando forma.

De 2024 a 2025: Qué Cambió

La desinformación generada por IA documentada en nuestra revisión anual de 2024 fue, en retrospectiva, un período de transición. Para 2025, tres cosas habían cambiado: la calidad de generación mejoró lo suficiente como para que la inspección visual casual ya no detectara de forma fiable los fakes; la infraestructura de distribución se volvió más sofisticada, con contenido sintético sembrado en agregadores de noticias de apariencia legítima; y los objetivos se ampliaron desde principalmente figuras políticas a un rango más amplio que incluye periodistas, activistas, ejecutivos de empresas e individuos privados.

Cuatro categorías de noticias falsas generadas por IA dominaron 2025: vídeos deepfake de figuras políticas, imágenes de protestas y conflictos generadas por IA, clones de voz usados en campañas de desinformación y portales de noticias completamente sintéticos. Cada uno está documentado a continuación con casos verificados. Para detalles a nivel de caso, nuestra base de datos incluye entradas para el deepfake de rendición de Zelenski y fotos de protestas generadas por IA que proporcionan contexto metodológico para los patrones descritos aquí.

Categoría 1: Vídeos Deepfake de Figuras Políticas

Los vídeos deepfake dirigidos a figuras políticas en 2025 fueron más numerosos, más distribuidos geográficamente y más difíciles de detectar que en 2024. Los casos documentados más significativos compartían una estructura común: una figura política reconocible, una declaración fabricada alineada con una narrativa conspirativa existente y una estrategia de distribución que explotaba los algoritmos de recomendación de las plataformas antes de que los verificadores pudieran responder.

Deepfakes en las Elecciones Canadienses

En el período previo a las elecciones federales canadienses de 2025, clips deepfake que imitaban boletines de noticias de CBC y CTV circularon en redes sociales. Un clip pretendía mostrar un segmento informativo de CBC citando al líder liberal Mark Carney haciendo declaraciones que nunca había hecho. Los clips fueron identificados por la organización MediaSmarts y el propio equipo de verificación de CBC en pocas horas, pero habían acumulado decenas de miles de comparticiones antes de ser eliminados. El uso de formatos de transmisión de noticias — incluyendo rótulos en pantalla y encuadre con mesa de presentador — fue deliberado: la credibilidad institucional prestada es un patrón documentado en las campañas de deepfakes políticos.

Deepfakes de Fraude de Inversión en el Sudeste Asiático

A mediados de 2025, la Policía Real de Malasia desmanteló una red que usaba vídeos generados por IA de políticos y figuras empresariales — incluyendo al primer ministro Anwar Ibrahim, Elon Musk y Donald Trump — para promocionar esquemas de inversión fraudulentos. Los vídeos se distribuían a través de canales de WhatsApp y Telegram. La calidad del intercambio facial era suficientemente alta como para que muchos receptores no pudieran identificar la manipulación sin herramientas técnicas. Este caso ilustra un cambio que los investigadores del proyecto Detect DeepFakes del MIT Media Lab habían documentado en su investigación: los deepfakes diseñados para engañar en un contexto financiero o de fraude son a menudo de mayor calidad que los diseñados para mensajes políticos, porque el beneficio financiero justifica una mayor inversión en producción.

El Deepfake de Voz de Rubio

Un clip de audio con voz clonada falsamente atribuido al secretario de Estado de EE.UU. Marco Rubio circuló a principios de 2025, mostrándole haciendo declaraciones inconsistentes con las posiciones oficiales de la política exterior estadounidense. El clip fue detectado por el sistema de autenticación de voz de Pindrop y analizado posteriormente por varios equipos independientes de forense de audio. La detección se basó en el análisis espectral — los clones de voz producen consistentemente artefactos en rangos de frecuencia específicos que los oídos humanos no registran pero que las herramientas de visualización espectral muestran inmediatamente. Este caso impulsó renovadas llamadas a estándares de autenticación de voz en las comunicaciones políticas, incluyendo de la FCC, que ya estaba desarrollando orientaciones tras la resolución sobre la robocall de Biden de 2024.

Categoría 2: Imágenes de Protestas y Conflictos Generadas por IA

Las imágenes de protestas y eventos de conflicto generadas por IA representan un modelo de amenaza distinto al de los vídeos deepfake: son más baratas de producir, más difíciles de rastrear y explotan el momento de noticias de última hora cuando la presión de verificación es más alta y el escepticismo de la audiencia es más bajo.

El Patrón de los Disturbios del Reino Unido (Establecido en 2024, Continuado en 2025)

Durante los disturbios del Reino Unido de agosto de 2024, imágenes generadas por IA se propagaron en horas de los incidentes reales — incluyendo una fotografía fabricada que mostraba falsamente a agentes de policía británicos postrándose ante un grupo musulmán. La imagen fue identificada como generada por IA mediante análisis forense en 24 horas, pero ya había sido compartida cientos de miles de veces en X. La iteración de 2025 de este patrón — documentada en múltiples contextos de protestas en Europa y América del Norte — mostró mayor calidad de generación y una siembra inicial más rápida, lo que sugiere una distribución más coordinada en lugar de compartición orgánica. La documentación completa del caso está disponible en nuestra entrada de la base de datos sobre fotos de protestas generadas por IA.

Las Imágenes de la Protesta «No Kings»

En junio de 2025, imágenes generadas por IA que mostraban a celebridades incluyendo a Taylor Swift y Travis Kelce en protestas políticas de EE.UU. circularon por Facebook y X. La verificación de PolitiFact confirmó que ninguna de las dos personas estaba presente en los eventos representados. Las imágenes usaban artefactos visuales consistentes — manos anatómicamente distorsionadas, gradientes de densidad de multitud inverosímiles, texturas de cielo de apariencia sintética — que serían evidentes bajo una inspección cercana, pero circulaban principalmente como miniaturas comprimidas donde esos detalles son invisibles. Este caso está documentado en nuestra base de datos como ejemplo del patrón de manipulación de proximidad con celebridades: adjuntar una figura pública reconocida y de confianza a un mensaje político mediante imágenes sintéticas para tomar prestada legitimidad percibida.

Manipulación de la Cobertura de Desastres

Cada desastre natural significativo de 2025 fue acompañado, en cuestión de horas, por imágenes generadas por IA que mostraban destrucciones fabricadas o exageradas. AFP Fact Check y BBC Verify documentaron este patrón de forma consistente en eventos de inundaciones en el sur de Asia, incendios forestales en América del Norte y terremotos en Asia Central. El tiempo de producción para la generación de imágenes con IA — ahora medido en segundos — significa que las imágenes sintéticas de desastres llegan a las redes sociales antes que la fotografía oficial desde el lugar. Las plataformas que habían implementado el etiquetado de contenido con IA captaron algunos casos; las que no lo habían hecho captaron muy pocos.

Categoría 3: Clones de Voz en Campañas de Desinformación

La clonación de voz es el vector de engaño con IA de crecimiento más rápido en 2025. Las herramientas disponibles comercialmente — incluyendo ElevenLabs, Voice Engine de OpenAI y varias alternativas de código abierto — pueden producir un clon de voz convincente a partir de tan solo tres segundos de audio fuente. La tasa de ataques deepfake basados en voz aumentó más de un 1.300% entre 2023 y 2025, de aproximadamente un incidente al mes a más de siete al día, según el Informe de Inteligencia y Seguridad de Voz de Pindrop de 2025.

Campañas de Robocalls

Siguiendo el precedente de la robocall de Biden de 2024, campañas de robocalls con voz clonada dirigidas a votantes aparecieron en al menos seis países durante elecciones o referendos de 2025. La resolución de la FCC de enero de 2024 que clasifica las robocalls con voz de IA como ilegales bajo la TCPA ha limitado — pero no eliminado — su uso en EE.UU. Los casos internacionales se enfrentaron a marcos legales inconsistentes: varios estados miembros de la UE no tenían legislación específica que cubriera el contenido de voz generado por IA antes de que las disposiciones de transparencia de la Ley de IA de la UE entraran en vigor operativa en 2026.

Estafas Telefónicas a Escala

El impacto más dañino de la clonación de voz en 2025 no fue político sino financiero. El Centro de Denuncias de Delitos en Internet del FBI (IC3) documentó un fuerte aumento en variantes de la «estafa del abuelo» que usaban voces clonadas de familiares para solicitar transferencias bancarias de emergencia. Una encuesta publicada en 2026 estimó que 1 de cada 4 estadounidenses había tenido una interacción con voz deepfake en el año anterior — aunque no todas eran estafas. Las pérdidas financieras derivadas del fraude con clones de voz en 2025 se estimaron en más de 2.500 millones de dólares solo en EE.UU.

Categoría 4: Portales de Noticias Completamente Sintéticos

El desarrollo estructuralmente más preocupante de 2025 no fue un vídeo falso específico ni una voz clonada, sino la proliferación de sitios web de noticias completamente generados por IA — portales sin personal editorial humano, sin periodistas reales y sin estructuras de responsabilidad, que producen un flujo continuo de contenido de apariencia plausible diseñado para ser indexado por los motores de búsqueda y recomendado por las plataformas sociales.

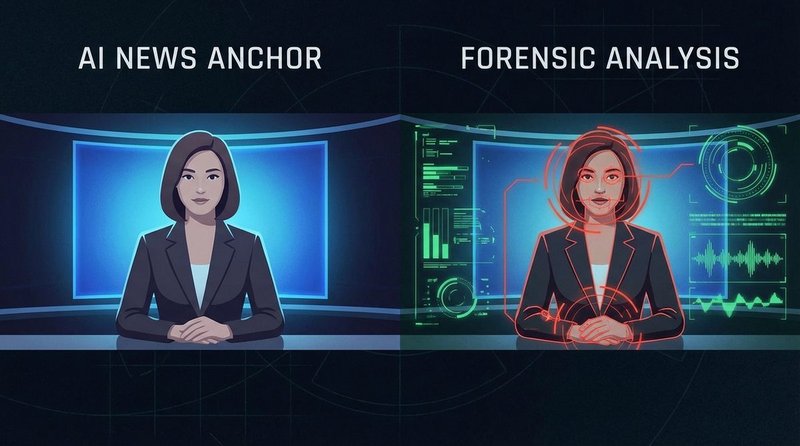

Los Informes de Amenazas Adversariales de Meta de 2024 ya habían documentado portales de noticias sintéticos vinculados a Estados que usaban avatares presentadores de noticias con IA. Para 2025, esta técnica ya no estaba limitada a actores estatales. El monitoreo de NewsGuard identificó cientos de lo que denomina sitios UAIN (Unreliable AI-Generated News — Noticias No Fiables Generadas por IA) — dominios que producen contenido completamente generado por máquinas en una serie de nichos políticos, monetizados mediante publicidad programática. Estos sitios típicamente no fabrican hechos individuales tanto como fabrican contexto: eventos reales descritos a través de un encuadre editorial consistentemente engañoso, sin proceso de corrección, sin firmas y sin metodología declarada.

La red «Pravda» documentada antes de las elecciones europeas de 2024 fue una versión temprana de este modelo. Sus sucesoras de 2025 eran más numerosas, lingüísticamente más sofisticadas y más difíciles de rastrear hasta sus actores de origen.

Detección: Métodos Técnicos

La detección técnica de deepfakes opera en tres capas: análisis de artefactos, forense de metadatos y verificación de procedencia. Ningún método es suficiente por sí solo. Usados conjuntamente, aumentan drásticamente la precisión de detección.

Análisis de Artefactos Visuales

La generación de imágenes y vídeo con IA actual produce consistentemente artefactos característicos: inconsistencias en el límite facial en líneas del cabello y márgenes de oreja; manos anatómicamente incorrectas (dedos de más, dígitos fusionados, ángulos de articulación inverosímiles); reflejos oculares antinaturales que no coinciden con la iluminación de la escena; y textura de piel renderizada con resolución inconsistente en toda la cara. Estos artefactos no siempre son visibles al tamaño de visualización normal pero aparecen claramente bajo un zoom del 200% o herramientas de mejora forense como Forensically (29a.ch) o FotoForensics.

Para vídeo, las inconsistencias temporales son igualmente reveladoras: geometría facial que no se sigue de forma consistente entre fotogramas, tasas de parpadeo antinaturales (los deepfakes entrenados con datos de ojos abiertos tienden a parpadear menos) e iluminación que cambia entre planos de forma inconsistente con un único entorno físico.

Análisis de Metadatos y EXIF

Las fotografías auténticas incorporan metadatos técnicos (datos EXIF) que incluyen modelo de cámara, especificaciones del objetivo, marca de tiempo de captura y — cuando los servicios de ubicación estaban activos — coordenadas GPS. Las imágenes generadas por IA típicamente tienen datos EXIF eliminados o ausentes, o metadatos genéricos inconsistentes con el dispositivo afirmado. Jeffrey’s Exif Viewer y ExifTool (línea de comandos) muestran ambos esta información. Una foto que afirma documentar un evento en directo pero que no muestra datos GPS y un bloque EXIF genérico generado por software justifica verificación inmediata.

Análisis Espectral de Audio

Los clones de voz producen artefactos en rangos de frecuencia específicos — particularmente por encima de los 8 kHz, donde los armónicos de voz natural se vuelven irregulares en la síntesis. Las herramientas de espectrograma que visualizan la frecuencia de audio a lo largo del tiempo (Audacity, iZotope RX, Adobe Audition) hacen visibles estas anomalías. El sistema de autenticación de voz de grado empresarial de Pindrop usa más de 1.300 características acústicas para distinguir la voz clonada de la auténtica — un nivel de sofisticación no disponible para usuarios casuales, pero accesible para redacciones y organizaciones de monitoreo electoral.

Búsqueda Inversa de Imágenes y Vídeo

El primer paso más sencillo y consistentemente eficaz sigue siendo la búsqueda inversa de imágenes: Google Imágenes, TinEye y Yandex Imágenes pueden localizar apariciones anteriores de fotografías recicladas en segundos. Para vídeo, el plugin de navegador InVID/WeVerify permite la extracción fotograma a fotograma y la búsqueda inversa, lo que hace posible identificar metraje reciclado incluso cuando ha sido re-editado o reencuadrado. Esta técnica no detecta contenido sintético recién generado — detecta contenido auténtico malinterpretado, que sigue siendo la mayoría de la desinformación en circulación.

Detección: Métodos Periodísticos

Las herramientas técnicas identifican artefactos. Los métodos periodísticos establecen la procedencia — la cadena documentada de custodia desde la creación hasta la publicación. La verificación de procedencia es el enfoque recomendado por el método SIFT, cubierto en detalle en nuestro taller sobre deepfakes.

Triangulación de Fuentes

Ninguna fuente única debe tratarse como suficiente para verificar afirmaciones sobre medios sintéticos. La triangulación requiere como mínimo: la fuente original (¿quién publicó o compartió primero el contenido?), una segunda fuente independiente con acceso directo al evento o persona representados, y una organización de verificación de terceros (Reuters Fact Check, AFP Fact Check, BBC Verify o el equipo de verificación de AP). Si dos de estos tres no pueden confirmarse, el contenido debe tratarse como no verificado independientemente de su calidad aparente.

Verificación de Contexto

Un deepfake técnicamente indetectable puede seguir siendo expuesto a través de inconsistencias contextuales. El equipo de investigación del MIT Media Lab — que realizó cinco experimentos aleatorizados pre-registrados con 2.215 participantes sobre la detección humana de deepfakes de discurso político — encontró que las transcripciones de texto a menudo eran suficientes para identificar la inverosimilitud, incluso cuando el audio y el vídeo parecían realistas. Comprobar si las declaraciones representadas son consistentes con las posiciones documentadas del sujeto, su estilo de comunicación y su ubicación física en el momento afirmado es un paso de verificación fundamental que no requiere herramientas técnicas.

Historial de Dominio y Publicación

Para el contenido de portales de noticias sintéticos: la fecha de registro WHOIS, el historial del dominio a través de la Wayback Machine y la verificación de firmas (¿tienen los periodistas listados historiales profesionales verificables fuera del sitio?) son las tres comprobaciones rápidas más fiables. Las organizaciones de noticias legítimas tienen historiales de publicación que preceden a la historia que se comparte. Los portales de noticias generados por IA típicamente muestran un registro de dominio en los últimos 12 meses y firmas sin rastro de verificación externo.

La Respuesta Regulatoria: Ley de IA de la UE y C2PA

Dos marcos paralelos están convergiendo para crear la primera infraestructura legalmente ejecutable para la divulgación de medios sintéticos: las obligaciones de transparencia de la Ley de IA de la UE y el estándar técnico C2PA de la Content Authenticity Initiative.

Ley de IA de la UE: Obligaciones de Transparencia del Artículo 50

El artículo 50 de la Ley de IA de la UE exige a los proveedores de sistemas de IA que generan contenido de audio, imagen, vídeo o texto sintéticos que marquen las salidas en un formato legible por máquina detectable como artificialmente generado o manipulado. Los implementadores deben revelar cuándo se usa IA para crear contenido sintético realista. Los deepfakes deben etiquetarse incluso cuando el contenido es lícito; solo el contenido «evidentemente artístico, creativo, satírico o ficticio» cumple los requisitos para requisitos de divulgación reducidos.

Las obligaciones de transparencia del artículo 50 se vuelven ejecutables el 2 de agosto de 2026. La Comisión Europea publicó el primer borrador del Código de Práctica sobre marcado y etiquetado del contenido generado por IA el 17 de diciembre de 2025, estableciendo estándares técnicos para la marca de agua y los metadatos de procedencia antes de la fecha de aplicación legal. Las sanciones por incumplimiento alcanzan los 35 millones de euros o el 7% de los ingresos anuales globales — un nivel destinado a crear presión de cumplimiento en las principales plataformas y proveedores de IA.

El ámbito territorial de la regulación se extiende más allá de las fronteras de la UE: cualquier empresa cuyos sistemas de IA o contenido sintético llegue a usuarios de la UE debe cumplir, independientemente de dónde esté ubicada la empresa. Esto convierte a la Ley de IA de la UE, en efecto, en un estándar global para las plataformas que llegan a audiencias europeas.

Credenciales de Contenido C2PA

La Coalición para la Procedencia y Autenticidad del Contenido (C2PA), que incluye a Adobe, Microsoft, Google, OpenAI, Meta y las principales organizaciones de noticias, ha desarrollado un estándar técnico que incrusta metadatos de procedencia firmados criptográficamente en archivos de imagen, audio y vídeo. Las Credenciales de Contenido registran quién creó el contenido, qué herramientas se usaron, qué ediciones se aplicaron y si estuvo involucrada la generación de IA — creando una cadena de custodia a prueba de manipulaciones desde la creación hasta la publicación.

Adobe ha integrado C2PA en Photoshop, Lightroom y Firefly. YouTube añadió etiquetas basadas en procedencia en 2024. El Departamento de Defensa de EE.UU. publicó orientaciones en enero de 2025 recomendando la adopción de C2PA para las comunicaciones gubernamentales. DALL-E 3 y Sora de OpenAI incorporan metadatos C2PA por defecto.

Una limitación crítica: C2PA verifica el contenido auténtico — no detecta deepfakes. La ausencia de metadatos C2PA no significa que el contenido sea sintético; el contenido creado en dispositivos más antiguos o con herramientas que aún no admiten el estándar también carecerá de credenciales. Como señala la propia documentación del estándar, las credenciales ausentes deben motivar un escrutinio adicional, no el rechazo automático. Una implementación C2PA completa proporciona evidencia sólida de procedencia; su ausencia es ausencia de evidencia, no evidencia de manipulación.

Las implicaciones para la privacidad también están bajo debate activo. Los metadatos C2PA pueden incluir marcas de tiempo, geolocalización e historiales de edición. La investigación de Fortune publicada en septiembre de 2025 documentó casos donde los metadatos C2PA capturaron datos de ubicación que los creadores de contenido no pretendían compartir. El estándar incluye disposiciones para eliminar metadatos sensibles antes de la publicación, pero la consistencia de implementación en las plataformas sigue siendo desigual.

Qué Esperar en 2026

Tres desarrollos darán forma al panorama de la desinformación generada por IA a lo largo de 2026 y más allá.

Comienza la aplicación. Las disposiciones del artículo 50 de la Ley de IA de la UE se vuelven legalmente ejecutables en agosto de 2026. Esto creará la primera prueba a gran escala de si los requisitos regulatorios de divulgación pueden frenar la producción y distribución de desinformación de medios sintéticos. Las señales tempranas de cumplimiento de las principales plataformas son dispares: Adobe, Google y OpenAI han hecho compromisos creíbles; los proveedores de IA más pequeños y las plataformas de distribución están menos preparados.

La carrera armamentista de detección continúa. Las capacidades de generación y detección evolucionan en paralelo. La investigación del MIT Media Lab — y la literatura más amplia — muestra consistentemente que ni los observadores humanos ni las herramientas de detección automatizadas son fiables de forma consistente en todos los tipos de deepfakes. La combinación de juicio humano y análisis asistido por máquinas supera a cualquiera de los dos por separado. Las redacciones, los monitores electorales y los equipos de confianza y seguridad de las plataformas están invirtiendo en flujos de trabajo de detección híbridos; los consumidores individuales de medios tienen en gran medida las mismas herramientas que en 2024.

La infraestructura de verificación se está expandiendo, lentamente. El método SIFT, la adopción de C2PA y las redes de verificación multiplataforma representan un progreso genuino. La capacidad de verificación del ecosistema de alfabetización mediática más amplio — docentes, bibliotecarios, organizaciones cívicas — está creciendo a través de talleres y herramientas como las cubiertas en nuestro taller de identificación de deepfakes. La brecha entre la capacidad de producción y la capacidad de verificación sigue siendo amplia, pero ya no se está ampliando tan rápido como en 2023.

Para los casos fundacionales que establecieron el panorama de amenazas actual — incluyendo el deepfake de rendición de Zelenski y la oleada de fotos de protestas con IA de 2024 — el índice de verificación y la base de datos de casos proporcionan documentación completa con notas metodológicas.