L’alfabetizzazione mediatica è la capacità di trovare, valutare e usare le informazioni in modo efficace — e di riconoscere quando le informazioni sono progettate per manipolare anziché informare. Non è una competenza fissa ma una pratica, e le condizioni che affronta stanno cambiando più velocemente di qualsiasi altro momento precedente nella storia dei media.

Cosa significa davvero l’alfabetizzazione mediatica

Il termine viene usato in modo approssimativo, ma una definizione operativa è necessaria. L’alfabetizzazione mediatica comprende tre competenze distinte: la capacità di riconoscere contenuti falsi o fuorvianti, la capacità di verificare le affermazioni attraverso fonti e strumenti indipendenti, e la capacità di prendere decisioni informate su cosa condividere. La mancanza di una sola di queste crea una lacuna che i malintenzionati sfruttano sistematicamente.

La definizione dell’UNESCO, che informa la maggior parte dei quadri europei di educazione ai media, descrive l’alfabetizzazione mediatica come “la capacità di accedere, analizzare, valutare e creare media in varie forme”. Il Media Literacy Framework del Consiglio d’Europa del 2021 aggiunge una quarta dimensione: la capacità di confrontarsi con i contenuti mediatici come partecipanti ai processi democratici — non solo come consumatori passivi.

Un chiarimento importante: l’alfabetizzazione mediatica non è la stessa cosa dello scetticismo mediatico. L’obiettivo non è diffidare di tutte le fonti — è calibrare la fiducia in base alle prove. La sfiducia generalizzata nei confronti dei media mainstream è essa stessa un prodotto documentato delle campagne di disinformazione, non una prova di pensiero critico.

Perché il 2025 ha alzato la posta

Tre sviluppi convergenti hanno reso la pratica più urgente negli ultimi due anni che in qualsiasi momento del decennio precedente.

Media sintetici generati dall’IA su larga scala

Fino al 2023, la produzione di deepfake di alta qualità richiedeva hardware specializzato e competenze tecniche significative. Entro la fine del 2024, strumenti consumer basati su Stable Diffusion, sintesi vocale ElevenLabs e più piattaforme di generazione video avevano ridotto quella barriera quasi a zero. Un video sintetico convincente di un personaggio pubblico può ora essere prodotto in pochi minuti su hardware disponibile in commercio. Il divario forense — il tempo tra la circolazione di un contenuto sintetico e la sua smentita definitiva — si misura in ore o giorni. Quella finestra è sufficiente a spostare l’opinione pubblica su questioni sensibili al tempo prima che la correzione raggiunga lo stesso pubblico che ha visto l’originale.

Comportamento inauthenticato coordinato a costo ridotto

Il Rapporto sulle Minacce Avversariali di Meta del 2024 ha documentato un aumento del 61% delle campagne di comportamento inauthenticato coordinato (CIB) assistite dall’IA rispetto al 2023. La caratteristica distintiva delle campagne attuali non è la scala ma la specificità: i contenuti generati da LLM possono essere personalizzati per comunità, lingue e profili emotivi specifici a un costo che era proibitivo per la propaganda scritta da umani solo tre anni fa.

Erosione della fiducia istituzionale

Il Digital News Report 2024 del Reuters Institute ha registrato una fiducia media nelle notizie del 40% nei 47 paesi esaminati — in calo dal 44% del 2022. La diminuzione della fiducia istituzionale non rende di per sé le popolazioni più suscettibili alla disinformazione. Ma rimuove uno degli ancoraggi principali che le persone usano per calibrare le informazioni: la reputazione della fonte. Quando nessuna fonte è fidata, tutte le affermazioni vengono trattate come ugualmente plausibili — il che avvantaggia chi produce disinformazione ad alto volume.

Le tre competenze fondamentali

1. Riconoscere i contenuti falsi e fuorvianti

Il riconoscimento è il punto di ingresso. Richiede familiarità con gli schemi strutturali che i contenuti fuorvianti utilizzano: linguaggio emotivo nei titoli, attribuzione vaga, statistiche decontestualizzate, assenza di fonti originali e cornice di urgenza. Questi schemi non sono prova di falsità — sono segnali che è necessaria un’ulteriore indagine prima di fidarsi o condividere.

La guida sul Linguaggio Emotivo nei Titoli tratta i modelli linguistici specifici in dettaglio, con esempi da casi documentati su tutto lo spettro politico.

2. Verificare le affermazioni

La verifica è la pratica centrale. Significa risalire alle affermazioni fino alle fonti primarie — studi originali, documenti ufficiali, testimonianze dirette — e valutare le prove in base ai loro meriti propri, non attraverso sintesi intermedie o cornici dei social media. La maggior parte della disinformazione virale è tracciabile, in dieci minuti e con gli strumenti giusti.

La sezione Laboratorio tratta quattro metodi di verifica pratici: il framework SIFT, la ricerca inversa delle immagini, l’analisi del linguaggio emotivo e il rilevamento dei deepfake. La guida agli Strumenti di Verifica dei Fatti elenca i migliori strumenti gratuiti per ciascun compito di verifica.

3. Condivisione responsabile

La disinformazione si diffonde principalmente attraverso persone che la credono vera. La decisione di condividere è quindi importante quanto la decisione di creare. La condivisione responsabile significa applicare almeno un controllo di verifica di base prima di amplificare un’affermazione — in particolare per affermazioni che confermano credenze preesistenti, che la ricerca mostra costantemente vengono condivise più velocemente e con meno esame critico rispetto alle affermazioni che le mettono in discussione.

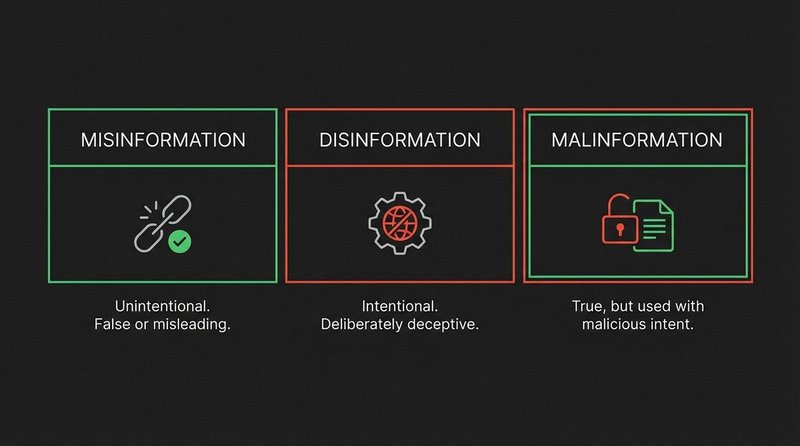

Concetti chiave: misinformazione, disinformazione, malinformazione

Questi tre termini vengono usati in modo intercambiabile nel dibattito pubblico, ma descrivono fenomeni diversi con cause diverse e rimedi diversi. La distinzione è importante per una diagnosi accurata.

- Misinformazione

- Informazioni false o imprecise condivise senza intenzione di ingannare. Chi le diffonde le crede vere. Esempio: un utente condivide un mito sulla salute che ha incontrato e crede genuinamente. La risposta appropriata è un’informazione accurata presentata in modo accessibile, senza condiscendenza.

- Disinformazione

- Informazioni false create e diffuse con deliberata intenzione di ingannare. Il produttore sa che il contenuto è falso e ha un obiettivo strategico — di solito politico, finanziario o sociale. La risposta appropriata è l’esposizione dell’inganno e della sua fonte, combinata con il prebunking.

- Malinformazione

- Informazioni accurate usate con l’intenzione di causare danni — tipicamente strappando il contesto, sbagliando il momento della divulgazione o usando informazioni private per colpire individui. Esempio: una fuga di comunicazioni private deliberatamente programmata per danneggiare un candidato nei giorni finali prima di un’elezione. La risposta appropriata è il ripristino del contesto e l’analisi della fonte, non il fact-checking del contenuto.

Per un’analisi dettagliata di come queste tre categorie interagiscono e si sovrappongono nei casi documentati, vedi Disinformazione vs. Misinformazione: cosa significa davvero la differenza.

Prebunking: anticipare la disinformazione

Il debunking — correggere le informazioni false dopo che si sono diffuse — è necessario ma limitato. Le correzioni raramente raggiungono lo stesso pubblico dell’affermazione originale, e l’esposizione ripetuta a una falsa affermazione, anche nel contesto del debunking, può paradossalmente aumentarne la memorabilità (l’effetto della verità illusoria, documentato nella ricerca di Fazio et al., 2015, e replicato in molteplici studi successivi).

Il prebunking affronta questa limitazione inoculando le persone contro le tecniche di disinformazione prima che incontrino specifiche affermazioni false. Invece di correggere i contenuti, il prebunking insegna gli schemi strutturali che i contenuti falsi usano — così la tecnica è riconoscibile indipendentemente dall’affermazione specifica a cui viene applicata. La ricerca del Social Decision-Making Lab dell’Università di Cambridge e del team jigsaw.google.com ha dimostrato che brevi interventi di prebunking riducono la suscettibilità alle tecniche di disinformazione in trial controllati.

Il ruolo degli algoritmi delle piattaforme nella diffusione della disinformazione

Il pensiero critico individuale è necessario ma non sufficiente. Il design della piattaforma determina quali informazioni raggiungono le persone, a monte di qualsiasi valutazione individuale. Capire come funziona l’amplificazione algoritmica fa parte dell’alfabetizzazione mediatica nel 2025.

Gli algoritmi di raccomandazione delle principali piattaforme social sono ottimizzati principalmente per il coinvolgimento — non per l’accuratezza, non per la rilevanza e non per il beneficio pubblico. La ricerca del MIT Media Lab pubblicata su Science (Vosoughi, Roy e Aral, 2018) ha riscontrato che le false notizie si diffondono significativamente più velocemente e più lontano delle notizie vere sui social media, raggiungendo in media sei volte più persone. Un fattore chiave è la novità: le informazioni false tendono ad essere più sorprendenti di quelle accurate, e la sorpresa è un segnale affidabile di coinvolgimento.

Risorse in questa sezione

- Disinformazione vs. Misinformazione — Cosa Significa Davvero la Differenza

- Strumenti di Verifica dei Fatti — Le Migliori Risorse Gratuite per la Verifica Indipendente

La sezione Laboratorio tratta metodi di verifica pratici con guide passo dopo passo. Il Database delle Fake News fornisce casi reali documentati per ogni concetto trattato in questo hub.