Le notizie false si diffondono più velocemente, più lontano e più in profondità delle notizie vere sui social media — non perché le persone siano irrazionali, ma perché le storie false sono progettate per sfruttare le stesse scorciatoie cognitive che ci rendono processori di informazioni efficienti. Capire il meccanismo è il primo passo per resistervi.

I Dati: Cosa ha Trovato lo Studio del MIT

Il riferimento empirico fondamentale su questo argomento è uno studio del 2018 di Soroush Vosoughi, Deb Roy e Sinan Aral, pubblicato su Science (Vol. 359, Issue 6380). I ricercatori hanno analizzato la diffusione di circa 126.000 storie verificate dai fact-checker condivise su Twitter tra il 2006 e il 2017, da circa 3 milioni di persone, più di 4,5 milioni di volte.

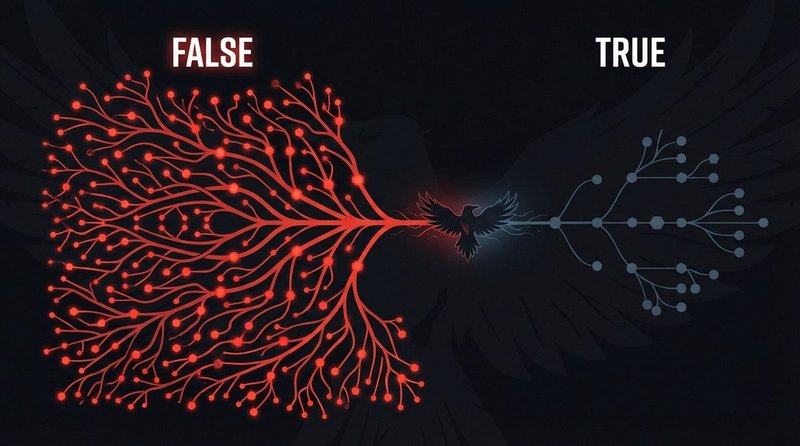

I risultati erano inequivocabili. Le notizie false raggiungevano 1.500 persone circa sei volte più velocemente delle storie vere. Si diffondevano a utenti unici più ampiamente (più persone vedevano le storie false rispetto a quelle vere) e più in profondità (le storie false penetravano più in profondità nelle reti sociali attraverso catene di diffusione più lunghe). L’effetto era più forte per la disinformazione politica. E, aspetto cruciale: i ricercatori hanno controllato i bot. Gli esseri umani, non gli account automatizzati, erano il vettore primario della diffusione delle notizie false. I bot diffondevano storie vere e false a circa la stessa velocità; il differenziale di amplificazione umana era il dato significativo.

La spiegazione dello studio per l’asimmetria: le notizie false sono più nuove (contengono informazioni che il pubblico non ha mai visto prima) e più emotivamente coinvolgenti. Le storie segnalate come false dai fact-checker generavano risposte significativamente più elevate nelle categorie di sorpresa, paura e disgusto. Le storie vere generavano più tristezza e anticipazione — stati emotivi a bassa attivazione che producono meno comportamento di condivisione.

Trigger Emotivi: L’Architettura dei Contenuti Falsi Virali

La disinformazione virale sfrutta sistematicamente tre categorie di risposta emotiva. Conoscerle non rende immuni — le risposte sono fisiologiche — ma crea una breve finestra di valutazione deliberata prima di agire sull’impulso di condividere.

Indignazione

L’indignazione morale è il predittore più affidabile del comportamento di condivisione sui social media. Uno studio del 2017 di Brady et al. in PNAS ha rilevato che ogni parola morale-emotiva aggiunta a un tweet aumentava i tassi di retweet di circa il 20%. Le storie di fake news virali usano sistematicamente il framing dell’indignazione — presentano gli eventi come ingiustizie, tradimenti o minacce ai valori del gruppo. Il contenuto non deve essere interamente falso per scatenare l’indignazione; il framing selettivo di eventi reali, privati del contesto, funziona altrettanto bene.

Paura

La disinformazione basata sulla minaccia attiva l’amigdala prima che la corteccia prefrontale possa applicare il ragionamento analitico — un fenomeno ben documentato nelle neuroscienze cognitive. La disinformazione sanitaria (“Questo cibo/vaccino/sostanza ti sta uccidendo”), la disinformazione sulla criminalità (“La criminalità sta aumentando nel tuo quartiere”) e le narrazioni di minaccia all’identità (“Stanno sostituendo la tua cultura”) sfruttano tutte le risposte alla paura. Il contenuto si diffonde rapidamente perché condividerlo sembra protettivo — stai avvertendo la tua rete — il che crea una motivazione prosociale per amplificare le informazioni false.

Schadenfreude e Soddisfazione Tribale

Le storie che convalidano credenze negative su un out-group — avversari politici, nazioni rivali, nemici ideologici — attivano i circuiti della ricompensa piuttosto che le risposte alla minaccia. Condividerle fa stare bene. La ricerca di Pennycook & Rand (2019) in Social Psychological and Personality Science ha rilevato che la “congruenza partigiana” (contenuti che confermavano le credenze politiche esistenti) era il predittore più forte dell’intenzione di condividere — più forte della percezione dell’accuratezza del contenuto. Le persone condividono i contenuti perché sembrano veri alla loro visione del mondo, non necessariamente perché credono che siano fattualmente accurati.

Algoritmi delle Piattaforme e Ottimizzazione del Coinvolgimento

L’architettura delle piattaforme non crea disinformazione, ma è un meccanismo di amplificazione significativo. Il principio di progettazione fondamentale dei sistemi di raccomandazione ottimizzati per il coinvolgimento — massimizzare il tempo sulla piattaforma — premia strutturalmente i contenuti emotivamente attivanti, indipendentemente dalla loro accuratezza.

Uno studio interno di Facebook del 2021, riportato dal Wall Street Journal sulla base di documenti trapelati, ha rilevato che i ricercatori di Facebook avevano identificato che il cambiamento dell’algoritmo del 2018 (orientarsi verso le “interazioni sociali significative” — contenuti che generavano commenti e reazioni piuttosto che visualizzazioni passive) aveva l’effetto di amplificare i contenuti che inducevano indignazione, inclusa la disinformazione. I ricercatori proposero delle soluzioni; le soluzioni non furono implementate su larga scala per timori di ridurre il coinvolgimento complessivo.

Il meccanismo non è esclusivo di Facebook. L’algoritmo di raccomandazione di YouTube, come documentato in un audit del 2020 di Ribeiro et al., raccomandava costantemente contenuti sempre più estremi una volta che un utente iniziava a guardare contenuti in determinate categorie politiche o complottiste — un effetto “rabbit hole” guidato dall’ottimizzazione del tempo di visione. La timeline algoritmica di Twitter/X è stata dimostrata dai propri ricercatori amplificare i contenuti politici di destra più di quelli di sinistra in diversi paesi, indipendentemente dalle differenze di coinvolgimento. Lo studio interno del 2021 della piattaforma ha pubblicato volontariamente questo risultato.

L’implicazione strutturale: le piattaforme costruite per massimizzare il coinvolgimento amplificheranno sistematicamente i contenuti che innescano forti risposte emotive — che è esattamente ciò che le notizie false e fuorvianti sono progettate per fare.

Tempistica: Quando le Fake News Sono Più Pericolose

Le informazioni false non si diffondono uniformemente nel tempo. Tre specifici contesti creano condizioni in cui la disinformazione si diffonde più velocemente e le correzioni sono meno efficaci.

Finestre di Breaking News

I primi 30–60 minuti dopo un evento importante sono quelli in cui le informazioni verificate sono più scarse e la domanda del pubblico è più alta. La disinformazione colma il vuoto. La ricerca del Reuters Institute for the Study of Journalism rileva costantemente che le false affermazioni introdotte durante le finestre di breaking news sono più difficili da correggere rispetto a quelle introdotte dopo che i reportage autorevoli sono disponibili, perché la versione falsa spesso diventa l’ancora mentale che il pubblico usa per valutare le successive correzioni.

Elezioni e Campagne Politiche

I periodi elettorali mostrano picchi costanti nel volume e nella velocità della disinformazione in ogni contesto democratico studiato. Il database EU vs Disinfo documenta l’amplificazione nei periodi elettorali in tutti gli Stati membri dell’UE in ogni ciclo elettorale dal 2014. La combinazione di alti rischi politici, forte motivazione tribale a condividere contenuti favorevoli e ambienti mediatici frammentati crea condizioni ottimali perché le informazioni false raggiungano grandi pubblici prima che i fact-checker possano rispondere.

Crisi di Salute Pubblica

L’OMS ha coniato il termine “infodemia” nel febbraio 2020 per descrivere l’epidemia parallela di informazioni false e fuorvianti sul COVID-19. Il suo studio congiunto con organizzazioni partner ha rilevato che entro marzo 2020 la disinformazione sanitaria viaggiava più velocemente delle linee guida ufficiali su ogni principale piattaforma social — una diretta conseguenza degli stessi meccanismi descritti sopra, operanti in un ambiente ad alta paura e alta incertezza.

Account Super-Diffusori ed Effetti Rete

La diffusione virale non è uniforme nelle reti sociali. Un piccolo numero di account altamente connessi e ad alto coinvolgimento — spesso descritti come “super-diffusori” — è responsabile di una quota sproporzionata dell’amplificazione della disinformazione.

Le analisi del NewsGuard Misinformation Monitor e dei ricercatori indipendenti che studiano le elezioni USA del 2020 hanno costantemente rilevato che un piccolo numero di account — spesso con milioni di follower, spesso inclusi personaggi politici di rilievo — era responsabile della maggior parte degli episodi di disinformazione ad alto impatto. Il pattern è strutturalmente simile a quello che gli epidemiologi chiamano “eventi super-diffusori” nella trasmissione delle malattie: la maggior parte delle persone infetta zero o una persona; un piccolo numero di persone, nelle condizioni giuste, ne infetta centinaia.

L’analisi delle reti a livello di piattaforma condotta da Graphika e dal DFRLab ha documentato reti di amplificazione coordinate in cui account senza relazione organica si amplificano artificialmente a vicenda — comprimendo il tempo tra la pubblicazione iniziale e l’esposizione di massa. Questo rende la finestra di breaking news ancora più breve e riduce il tempo disponibile per gli interventi basati sulla verifica.

Caso Studio: L’Anatomia di un Evento Reale di Fake News Virale

Nel novembre 2016, si diffuse la falsa affermazione che una pizzeria di Washington D.C. chiamata Comet Ping Pong fosse il centro di una rete di traffico di minori gestita da alti funzionari del Partito Democratico. L’affermazione — diventata nota come “Pizzagate” — non aveva alcuna base probatoria e fu indagata e archiviata dalla Polizia Metropolitana di Washington D.C. Ciononostante, si diffuse a milioni di persone in pochi giorni e fu direttamente citata da un uomo che sparò all’interno del ristorante il 4 dicembre 2016, senza fare feriti ma causando ingenti danni materiali.

Il caso Pizzagate dimostra ogni meccanismo descritto in questo articolo che opera simultaneamente:

- Trigger emotivo: Il pericolo per i bambini è tra le preoccupazioni morali ad altissima attivazione — innescando sia risposte di indignazione che di paura.

- Tempistica: È emerso immediatamente dopo le elezioni USA del 2016, in un momento di picco di coinvolgimento politico con forte motivazione partigiana a condividere informazioni dannose sul partito avversario.

- Amplificazione dei super-diffusori: L’affermazione fu promossa da account con vasti pubblici su Twitter e YouTube, inclusi alcuni con centinaia di migliaia di follower, prima che i meccanismi di enforcement delle piattaforme venissero applicati.

- Ottimizzazione algoritmica: L’algoritmo di raccomandazione di YouTube, secondo analisi successive, indirizzava gli utenti dai contenuti elettorali mainstream ai video di Pizzagate attraverso prevedibili percorsi di escalation dei contenuti.

- Asimmetria della correzione: Al momento in cui il Washington Post, il New York Times e più fact-checker avevano pubblicato le smentite complete, la versione falsa aveva già raggiunto più persone di quante qualsiasi successiva correzione avrebbe mai raggiunto. Il dato di Vosoughi et al. sulla diffusione sei volte più veloce delle notizie false è qui direttamente illustrato.

Un’analisi documentata dell’operazione informativa di Pizzagate, inclusa la mappatura della diffusione, è mantenuta dall’European Digital Media Observatory (EDMO) come caso studio di riferimento nelle operazioni di influenza coordinate.

Comprendere questi meccanismi a livello strutturale è il prerequisito fondamentale per valutare i contenuti prima di condividerli. La guida Disinformazione vs. Misinformazione → spiega come l’intento si mappa su queste dinamiche virali. Il laboratorio sul Linguaggio Emotivo nei Titoli → fornisce pratica concreta per identificare il framing dei trigger nei titoli reali. I casi virali documentati con analisi completa della diffusione sono disponibili nel Database delle Fake News →. Torna all’Hub Alfabetizzazione Mediatica → per il percorso di apprendimento completo.