Misinformazione e disinformazione non sono sinonimi. La differenza — l’intenzione — determina quali contromisure funzionano e quali falliscono. Trattare tutte le informazioni false come inganno deliberato porta agli interventi sbagliati; ignorare l’intento malevolo lascia operare indisturbate le campagne coordinate.

Tre categorie, un framework

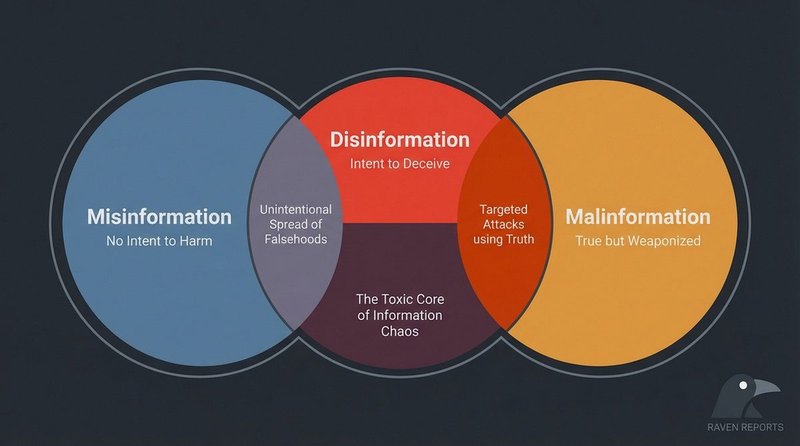

Il framework più citato per comprendere le informazioni false viene dalla ricercatrice Claire Wardle e dai suoi colleghi di First Draft, il cui rapporto del 2017 Information Disorder — sviluppato successivamente in un modello completo per il Consiglio d’Europa — distingue tre fenomeni distinti basandosi su due assi: se il contenuto è falso e se il creatore intende causare danni.

- Misinformazione

- Informazioni false o imprecise condivise senza intenzione di causare danni. Chi le diffonde le crede vere. Esempi: un genitore che condivide in un gruppo WhatsApp di famiglia un rimedio casalingo smentito, o un giornalista che cita in buona fede una statistica non verificata. Il contenuto è sbagliato; il movente non è malevolo.

- Disinformazione

- Informazioni false o fuorvianti create e diffuse con deliberata intenzione di ingannare o causare danni. La fonte sa che le informazioni sono false — o è incurante della sua accuratezza — e le distribuisce comunque per raggiungere un obiettivo: manipolazione politica, guadagno finanziario, danno reputazionale o destabilizzazione della fiducia pubblica. Le citazioni inventate attribuite a politici, le campagne di rete coordinate per screditare i giornalisti e l’interferenza elettorale sponsorizzata dallo stato rientrano tutte qui.

- Malinformazione

- Informazioni che sono vere, ma usate come arma per causare danni. Questa categoria è la più controintuitiva: non viene fatta alcuna affermazione falsa, ma il rilascio selettivo di informazioni private accurate — un’e-mail hackerata, una fotografia trapelata, reali cartelle cliniche — viene usato per danneggiare un obiettivo specifico. Il Codice di pratica sulla disinformazione dell’UE e le linee guida del Consiglio d’Europa trattano entrambi la malinformazione come una categoria distinta che richiede risposte normative diverse dalle altre due.

Il curriculum di media e informazione literacy dell’UNESCO adotta una tassonomia compatibile, sottolineando che il termine ombrello “fake news” è analiticamente insufficiente e potenzialmente fuorviante — confonde categorie che richiedono risposte fondamentalmente diverse.

Perché l’intenzione cambia tutto

L’intenzione non è solo una questione etica — è una questione pratica che determina quali interventi sono efficaci.

Quando le informazioni false si diffondono perché le persone credono che siano vere (misinformazione), le risposte più efficaci sono educative: debunking, prebunking e miglioramento della media literacy. Le persone che hanno condiviso informazioni errate in buona fede di solito si autocorreggeranno quando vengono fornite informazioni accurate e un modo a bassa frizione per farlo. La ricerca di Pennycook et al. (2020) su PNAS ha riscontrato che semplicemente chiedere alle persone di considerare l’accuratezza prima di condividere riduceva la diffusione della disinformazione in studi simulati.

Quando le informazioni false sono disinformazione — deliberatamente prodotta — le sole risposte educative sono insufficienti. La fonte non aggiornerà il suo comportamento in base ai fact-check. Le contromisure efficaci includono l’applicazione a livello di piattaforma, i framework legali (come il Digital Services Act dell’UE), la ricerca sull’attribuzione per esporre il comportamento inauthenticato coordinato e la comunicazione strategica che inocula preventivamente il pubblico. Il progetto EU vs Disinfo mantiene un database in corso di casi documentati di disinformazione del Cremlino — oltre 16.000 voci all’inizio del 2026 — precisamente perché nominare la fonte è una parte necessaria della risposta.

La malinformazione richiede ancora un altro toolkit: principalmente meccanismi legali riguardanti la privacy, la protezione dei dati e la trasparenza delle piattaforme — non il fact-checking, poiché i fatti sottostanti sono accurati.

Esempi reali di tutte e tre le categorie

Misinformazione in pratica

Durante i primi mesi della pandemia COVID-19, le affermazioni secondo cui bere liquidi caldi potesse uccidere il virus SARS-CoV-2 circolavano ampiamente sulle app di messaggistica. La maggior parte delle persone che condividevano questi messaggi credeva genuinamente di essere utile. La pagina dei miti da sfatare dell’OMS ha documentato decine di casi simili in cui la condivisione in buona fede ha accelerato la diffusione della disinformazione sanitaria. Non era necessaria alcuna campagna coordinata; persone ansiose in un ambiente ad alta incertezza hanno amplificato organicamente informazioni plausibili ma false.

Disinformazione in pratica

La valutazione 2017 dell’Intelligence Community statunitense sull’interferenza russa nelle elezioni USA del 2016 ha documentato una campagna di disinformazione coordinata che coinvolgeva contenuti inventati, false identità e amplificazione algoritmica. Gli operativi della Internet Research Agency hanno creato migliaia di account sui social media per spacciarsi per autentiche voci americane su questioni politiche divisive — un’operazione di disinformazione da manuale in cui i creatori sapevano che il contenuto era falso e l’intento era esplicita manipolazione politica.

Malinformazione in pratica

La pubblicazione nel 2016 delle e-mail private di John Podesta — ottenute tramite un attacco di phishing mirato al suo account Gmail e pubblicate tramite WikiLeaks — è un caso documentato di malinformazione. Le e-mail erano reali. Nessun contenuto era inventato. Ma il loro rilascio selettivo, programmato per danneggiare una campagna politica, costituisce informazioni vere usate come arma secondo la definizione stabilita nel framework Wardle/First Draft. Il tracker delle operazioni cyber del Council on Foreign Relations classifica questa operazione sotto le operazioni di informazione.

Le zone grigie

Il modello a tre categorie è uno strumento analitico utile, non una tassonomia ermetica. I casi reali occupano frequentemente un territorio sovrapposto.

Considera un post virale sui social media che contiene una statistica genuina presentata senza contesto, in un modo che il poster sa porterà il pubblico a una conclusione falsa. Il dato è vero; l’inquadratura è deliberatamente ingannevole. Questo si colloca tra misinformazione (nessuna affermazione falsa) e disinformazione (inganno deliberato). Il framework di Wardle tiene conto di questo con uno spettro di “sette tipi di mis- e disinformazione” che vanno dalla satira e parodia ai contenuti inventati — riconoscendo che l’intento e la falsità sono variabili continue, non interruttori binari.

Una seconda zona grigia comune è l’amplificazione partigiana: quando una narrativa di disinformazione, originariamente creata da un attore coordinato, viene raccolta e condivisa da cittadini ordinari che ora la credono genuinamente. La creazione iniziale era disinformazione; la successiva diffusione è misinformazione. La ricerca sull’attribuzione da parte di organizzazioni come Graphika e il Digital Forensic Research Lab (DFRLab) si concentra sull’identificazione della fonte coordinata originale, proprio perché la successiva condivisione organica non è il problema principale.

Una terza complessità è quella dei fatti contestati: affermazioni in aree dove esiste genuina incertezza scientifica, o dove l’opinione degli esperti è legittimamente divisa. Classificare un’affermazione empirica contestata come disinformazione richiede di stabilire sia che sia falsa sia che la fonte lo sapesse. Questa distinzione è enormemente importante per la libertà di espressione: l’eccesso nell’etichettare il discorso contestato come disinformazione è essa stessa un vettore documentato di abuso, usato da governi autoritari per reprimere il legittimo dissenso.

Implicazioni per le contromisure

Capire la categoria di informazione falsa con cui hai a che fare è un prerequisito per scegliere una risposta efficace. Il seguente elenco mappa i tipi di intervento alle categorie di disturbo dell’informazione:

- Educazione alla media literacy — affronta principalmente la misinformazione, dove la capacità del pubblico di valutare le fonti è la variabile chiave.

- Prebunking / teoria dell’inoculazione — efficace su misinformazione e disinformazione nelle fasi iniziali; la ricerca di Lewandowsky & van der Linden (2021) mostra che esporre il pubblico a forme indebolite di tecniche di manipolazione sviluppa resistenza.

- Applicazione a livello di piattaforma (rimozione, declassamento, etichettatura) — prende di mira la disinformazione a livello di distribuzione; l’efficacia dipende dalla velocità di applicazione rispetto alla diffusione virale.

- Attribuzione ed esposizione — prende di mira la disinformazione alla fonte; nominare gli attori coordinati aumenta il costo della gestione delle operazioni di influenza.

- Strumenti legali e normativi — rilevanti sia per la disinformazione (DSA dell’UE, leggi nazionali sull’integrità elettorale) sia per la malinformazione (legge sulla protezione dei dati, tutele della privacy).

- Correzioni e debunking — più efficaci per la misinformazione; meno efficaci per la disinformazione, dove la fonte non si aggiornerà, e dove le correzioni possono paradossalmente amplificare l’affermazione falsa originale attraverso il “dividendo del bugiardo” — il fenomeno per cui le accuse di disinformazione vengono esse stesse usate per screditare i reportage accurati.

Per un metodo strutturato per valutare qualsiasi affermazione specifica prima di condividerla, consulta la nostra guida al Metodo SIFT →. Per casi reali ordinati per categoria e schema, il Database delle Fake News → fornisce esempi documentati con note metodologiche complete. Il completo Hub di Media Literacy → collega tutti i concetti trattati qui in un percorso di apprendimento strutturato.