Riconoscere le fake news è una competenza che si impara, non un tratto della personalità. Questo laboratorio presenta quattro metodi pratici — ciascuno applicabile senza strumenti specializzati, accesso istituzionale o formazione pregressa.

Di cosa si occupa questo laboratorio

I metodi documentati qui non sono cornici teoriche. Sono procedure di verifica usate da fact-checker professionisti, giornalisti e investigatori digitali — adattati per chiunque abbia accesso a internet e una mentalità critica.

Ogni metodo è documentato in una guida dedicata con istruzioni passo dopo passo, esempi reali dal Database delle Fake News e una checklist per consultazione rapida. Questa pagina introduce tutti e quattro i metodi. Segui i link alle guide complete per applicarli nella pratica.

Il laboratorio è gratuito e non richiede registrazione. Tutte le guide sono scritte per uso autonomo — non è necessario seguirle in ordine. Scegli il metodo più rilevante per il tipo di contenuto che vuoi valutare.

Al termine di questo laboratorio sarai in grado di:

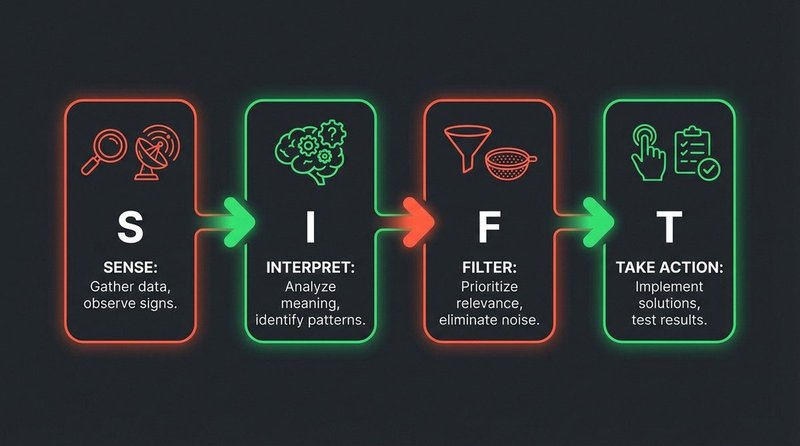

- Applicare il metodo SIFT per valutare qualsiasi informazione online prima di condividerla

- Usare la ricerca inversa delle immagini per verificare o smentire affermazioni visive

- Riconoscere i modelli di linguaggio emotivo che segnalano contenuti manipolativi

- Identificare i principali indicatori tecnici e comportamentali di video generati dall’IA (deepfake)

Metodo 1 — SIFT: un framework di verifica in quattro passi

SIFT è il metodo di verifica delle informazioni più diffuso nell’educazione alla media literacy. È stato sviluppato da Mike Caulfield presso la Washington State University ed è ora utilizzato in curricula scolastici K-12, programmi universitari e formazione giornalistica professionale negli Stati Uniti e in Europa.

Il metodo affronta un problema specifico: la maggior parte delle persone valuta le informazioni in base a come le fa sentire, non in base alle prove. SIFT interrompe questa tendenza introducendo un attrito strutturato — quattro passi deliberati che avvengono prima di qualsiasi condivisione o formazione di opinione.

Metodo 2 — Ricerca inversa delle immagini

Le immagini riutilizzate sono uno dei vettori più comuni nelle fake news. Una foto di un’alluvione del 2013 viene condivisa come prova di un disastro del 2024. Un’immagine di protesta da un paese viene didascaliata come se fosse di un altro. La ricerca inversa delle immagini smonta questa tattica in meno di due minuti.

Il processo di base: clicca con il tasto destro su qualsiasi immagine online e seleziona “Cerca immagine” (Chrome/Edge) oppure caricala direttamente su Google Images, TinEye o Yandex Images. La ricerca restituisce tutte le istanze indicizzate di quell’immagine — con date, fonti e didascalie originali. Un’immagine apparsa per la prima volta anni prima della data dell’evento dichiarato viene quasi certamente utilizzata in modo fuorviante.

La guida completa tratta anche: cercare per screenshot quando il caricamento diretto fallisce, usare Yandex per una copertura più ampia (particolarmente efficace per fonti in lingua dell’Europa orientale e russa) e combinare la ricerca inversa con l’ispezione dei metadati EXIF per immagini non ancora ampiamente indicizzate.

Guida completa alla Ricerca Inversa delle Immagini — passo dopo passo con gli strumenti →

Metodo 3 — Riconoscere il linguaggio emotivo nei titoli

Il linguaggio emotivamente carico nei titoli non è di per sé prova di fake news — eventi reali possono e generano forti reazioni. Ma un gruppo coerente di tecniche di manipolazione emotiva è un segnale d’allarme affidabile che il contenuto privilegia la reazione rispetto all’accuratezza.

Gli schemi da osservare: linguaggio assoluto (“MAI”, “SEMPRE”, “DISTRUGGE”, “PROVATO UNA VOLTA PER TUTTE”), attribuzione vaga ma allarmante (“gli esperti avvertono”, “le fonti confermano” senza nomi o istituzioni), cornice di urgenza (“prima che venga cancellato”, “condividi prima che lo tolgano”) e cornice di minaccia identitaria (“quello che stanno facendo ai tuoi figli/comunità/paese”). Questi schemi appaiono sia nel clickbait di bassa qualità sia nella disinformazione sofisticata sponsorizzata dagli stati, motivo per cui riconoscerli è una competenza trasferibile tra diversi tipi di contenuto.

Nessuno di questi schemi dimostra che un’affermazione sia falsa. Indicano che il contenuto è costruito per produrre una reazione prima che il lettore valuti le prove.

Guida completa: Linguaggio Emotivo nei Titoli — schemi ed esempi →

Metodo 4 — Identificare i deepfake

I video sintetici generati dall’IA (deepfake) sono diventati tecnicamente accessibili al punto che oggi individui con hardware consumer possono produrre face-swap e cloni vocali convincenti. Il rilevamento è sempre più difficile, ma non impossibile — i metodi attuali di generazione deepfake lasciano schemi di artefatti coerenti che rimangono identificabili con un’analisi mirata.

I più affidabili indicatori visivi attuali: schemi di ammiccamento innaturali o assenza di ammiccamento, illuminazione inconsistente tra il volto del soggetto e l’ambiente circostante, sfocatura o distorsione ai bordi della linea dei capelli e delle orecchie, sincronia labiale irregolare, rilevabile analizzando il video fotogramma per fotogramma, e levigatura artificiale della pelle, priva di texture naturale. Nessun indicatore singolo è conclusivo. Una combinazione di tre o più giustifica un esame approfondito.

Gli strumenti tecnici trattati nella guida completa includono Deepware Scanner e il metodo FakeCatcher sviluppato da Intel Research.

Guida completa al Rilevamento dei Deepfake — strumenti e analisi passo dopo passo →

A chi è rivolto questo laboratorio

Studenti

Studenti di scuola secondaria e universitari che navigano in ambienti ricchi di informazioni. Ogni metodo è progettato per essere applicato rapidamente — un controllo SIFT richiede due minuti, una ricerca inversa ne richiede uno. Non sono necessari strumenti specializzati o account. Le guide utilizzano casi reali del database come esempi pratici anziché scenari ipotetici.

Insegnanti e formatori

Ogni guida include esempi pratici e checklist scaricabili adatte all’uso in classe. Le guide su SIFT e linguaggio emotivo si mappano direttamente sugli standard di competenza di media literacy nei curricula tedeschi, austriaci e UE. Contatta il sito per materiali workshop su misura o supporto alla pianificazione delle sessioni.

Giornalisti e ricercatori

Le guide sulla ricerca inversa delle immagini e sul rilevamento dei deepfake approfondiscono aspetti più tecnici e fanno riferimento a strumenti di livello professionale accanto alle opzioni gratuite. Il Database delle Fake News fornisce casi di studio documentati organizzati per categoria di metodo, utili per la ricerca o come materiale didattico nei programmi di giornalismo.

Common Misinformation Patterns

These patterns appear repeatedly in fake news content. Learning to recognise them is the first step toward media literacy.

Ready to practice?

Browse real documented cases in our database and test your ability to spot the patterns.

Open the Database