I deepfake sono video e audio generati o manipolati dall’IA che fanno sembrare che una persona dica o faccia qualcosa che non ha mai detto o fatto. L’analisi degli artefatti visivi individua i deepfake di qualità inferiore, ma l’analisi della provenienza — tracciare dove un video è apparso per la prima volta e chi lo ha pubblicato — è il metodo più affidabile per la maggior parte dei media manipolati che circolano online.

Cosa Sono i Deepfake e Quanto Sono Diffusi

Il termine “deepfake” si riferisce specificamente a media generati o manipolati tramite deep learning — reti neurali addestrate su grandi dataset di video o audio reali per produrre output sintetici che assomigliano a una persona specifica. La tecnologia ha due categorie principali: deepfake di face-swap (sostituire il volto di una persona con quello di un’altra in un video esistente) e sintesi completa (generare una persona che parla da zero, tipicamente per cloni vocali).

Il deepfake politico più documentato è il video di resa di marzo 2022 del presidente ucraino Volodymyr Zelensky. Il video è apparso sul sito di notizie ucraino Ukraine 24 dopo un hack, ha circolato ampiamente sui social media, ed è stato rimosso da Meta, YouTube e Twitter/X lo stesso giorno. Zelensky ha risposto entro poche ore su Telegram, confermando che il video era falso. Il ricercatore di computer vision dell’UC Berkeley Hany Farid ha analizzato pubblicamente il video, identificando una strategia di codifica a bassa risoluzione usata per oscurare le distorsioni facciali, un pattern di movimento della testa innaturale e un lip-sync che non corrispondeva completamente alla fonetica ucraina. Il caso documentato completo è nel database Fake Off →.

Il video di Zelensky era insolito per il suo targeting politico. La maggior parte dei deepfake in circolazione sono immagini intime non consensuali (stimate oltre il 90% di tutti i contenuti deepfake per volume, secondo la ricerca 2023 di Sensity AI) e cloni audio usati per frodi finanziarie. I deepfake politici di alto profilo come il video di Zelensky sono relativamente rari ma sproporzionatamente riportati.

Vedi anche il resoconto IA e fake news 2025 → per i casi documentati dell’ultimo anno.

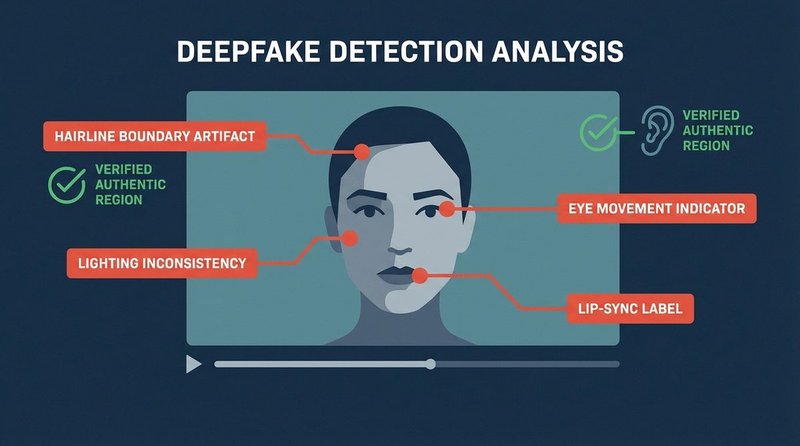

Indicatori Visivi: Cosa Cercare

L’analisi degli artefatti visivi funziona meglio sui deepfake di qualità inferiore. I video sintetici ad alta qualità prodotti da attori statali o da operazioni professionali potrebbero non mostrare nessuno di questi artefatti. Applica l’analisi visiva come primo controllo — può confermare rapidamente un fake di bassa qualità — ma non fare affidamento sull’assenza di artefatti come conferma di autenticità.

Ammiccamento e Movimento degli Occhi

I modelli deepfake di prima generazione (pre-2020) avevano difficoltà con l’ammiccamento realistico perché i dataset di addestramento contenevano meno fotogrammi con occhi chiusi che aperti. Questo produceva video in cui il soggetto ammiccava raramente o per niente. I modelli attuali hanno in gran parte corretto questo problema, ma i rapidi movimenti laterali degli occhi e le saccadi innaturali (i micro-salti che gli occhi fanno durante la scansione) rimangono difficili da sintetizzare in modo convincente. Guarda un segmento a velocità 0,25x e osserva se il movimento degli occhi sembra fisicamente plausibile per una persona che parla in modo colloquiale.

Attaccatura dei Capelli e Bordi delle Orecchie

I deepfake di face-swap fondono un volto sintetico su un video esistente, e la regione di confine — in particolare l’attaccatura dei capelli, le orecchie e il bordo della mascella — è dove la fusione tipicamente fallisce. Cerca: bordi morbidi o sfumati dove i capelli incontrano la pelle, illuminazione incoerente tra il volto e i capelli, distorsioni geometriche quando il soggetto gira la testa, e lobi delle orecchie che sembrano allungarsi o deformarsi leggermente durante il movimento. Questi artefatti sono più visibili nelle immagini fisse ad alta risoluzione estratte dal video che durante la riproduzione.

Consistenza di Illuminazione e Ombre

Il volto sintetico in un deepfake di face-swap è renderizzato con un’illuminazione derivata dal filmato sorgente, non dalle condizioni di illuminazione nel video target. Quando una persona muove la testa nella luce naturale, il pattern di luci e ombre sul suo volto si muove in modo coerente con la sorgente luminosa. In un deepfake, questa coerenza può rompersi: il volto può sembrare avere una sorgente di luce ambientale diversa rispetto allo sfondo e al collo, o le ombre potrebbero non seguire correttamente il movimento della testa.

Accuratezza del Lip-Sync e Corrispondenza Fonetica

L’accuratezza del lip-sync è una delle aree in cui la generazione dei deepfake è migliorata più rapidamente. Tuttavia, la mappatura fonema-forma della bocca — le posizioni specifiche delle labbra richieste per ogni suono in una particolare lingua — rimane un’area di sintesi imperfetta, in particolare per le lingue diverse dall’inglese. Il video di Zelensky è stato parzialmente identificato attraverso questo meccanismo: la fonetica ucraina richiede movimenti bilabiali specifici che il modello sintetico non riproduceva completamente. Per i deepfake solo audio (cloni vocali), ascolta: pause innaturali tra le parole, prosodia che non corrisponde alla struttura della frase e un pavimento del rumore costante che non varia come farebbe una vera registrazione.

Texture della Pelle e Dettagli ad Alta Frequenza

Le reti neurali sintetizzano la pelle come una superficie liscia. La pelle umana reale ha pori, linee sottili e texture irregolare che varia nelle diverse regioni del volto. Nel video, la texture della pelle è renderizzata dinamicamente — cambia con il movimento e l’illuminazione. La pelle sintetica tende ad essere troppo liscia in condizioni di illuminazione sfavorevole e può mostrare una riflettività simile alla plastica. Questo è più visibile intorno al naso, alla fronte e alle guance quando il soggetto è ben illuminato.

Strumenti di Rilevamento: Cosa Fanno e Cosa Non Fanno

Gli strumenti di rilevamento automatizzato devono essere usati come prove di supporto, non come verdetti definitivi. L’accuratezza del rilevamento varia significativamente a seconda del metodo di generazione usato per creare il deepfake, e gli strumenti addestrati su dataset di deepfake più vecchi potrebbero non rilevare le tecniche di generazione più recenti.

Deepware Scanner

Deepware Scanner (gratuito, basato su browser) analizza i file video caricati per le firme dei deepfake usando modelli di deep learning. Restituisce un punteggio di probabilità piuttosto che un verdetto binario. Punteggi superiori all’80% indicano contenuto probabilmente sintetico; punteggi tra 40-80% sono inconcludenti; sotto il 40% indica probabilmente autentico. Usa Deepware per una prima valutazione rapida, non come determinazione finale.

Intel FakeCatcher

FakeCatcher di Intel, sviluppato in collaborazione con ricercatori della State University of New York a Binghamton e annunciato nel novembre 2022, usa un approccio di rilevamento fondamentalmente diverso. Invece di cercare artefatti visivi, analizza i segnali di fotopletismografia (PPG) — i sottili cambiamenti di colore nella pelle causati dal flusso sanguigno mentre il cuore pompa. I volti umani reali mostrano segnali PPG coerenti su tutto il volto; i volti sintetici non replicano realisticamente questo segnale biologico. Intel afferma un tasso di accuratezza del rilevamento del 96% nei test controllati. FakeCatcher è principalmente disponibile per uso istituzionale e delle piattaforme; attualmente non è uno strumento per consumatori, ma la sua metodologia rappresenta la direzione verso cui si sta dirigendo il rilevamento automatizzato.

Sensity AI

Sensity AI fornisce rilevamento deepfake enterprise per redazioni e piattaforme, con una divisione di ricerca che pubblica rapporti annuali sui pattern di volume e distribuzione dei deepfake. La loro API di rilevamento non è liberamente gratuita, ma la loro ricerca pubblicata è una fonte autorevole per comprendere la scala attuale dei media sintetici.

Cosa Non Possono Fare gli Strumenti

Nessun strumento di rilevamento automatizzato è affidabile contro i deepfake avversariali a livello statale — media sintetici specificamente ottimizzati per eludere i metodi di rilevamento noti. L’esistenza di deepfake avversariali è ben documentata nella letteratura accademica. Questo significa che gli strumenti automatizzati possono confermare un deepfake di qualità da bassa a media, ma un risultato negativo (“probabilmente autentico”) non garantisce l’autenticità quando le poste in gioco sono alte. Combina l’output degli strumenti con l’analisi visiva e, soprattutto, l’indagine sulla provenienza.

Analisi della Provenienza: Il Metodo Più Affidabile

Per la maggior parte dei deepfake che circolano sui social media, l’analisi della provenienza — tracciare l’origine e la catena di distribuzione del contenuto — è più affidabile dell’analisi visiva o automatizzata. Un video che circola prima su account noti collegati a operazioni di influenza statale, che appare senza una catena di documentazione dell’evento verificabile e che nessuna organizzazione di notizie credibile può corroborare dovrebbe essere trattato come non verificato indipendentemente da ciò che mostra.

L’analisi della provenienza per i video segue gli stessi principi della ricerca inversa delle immagini per le fotografie. Applica il flusso di lavoro della Ricerca Inversa delle Immagini → usando il plugin InVID/WeVerify per estrarre fotogrammi chiave e cercare ciascuno indipendentemente. Per i video completi:

- Trova la prima apparizione. Chi ha pubblicato questo video per primo? Una ricerca sulla piattaforma dove l’hai incontrato, combinata con una ricerca inversa del fotogramma chiave, spesso porta all’upload originale. Un video pubblicato per la prima volta da account anonimi senza connessione con l’evento dichiarato è un segnale d’allarme.

- Controlla se un organo di stampa credibile ha verificato in modo indipendente l’evento descritto. Se un video afferma di mostrare una figura politica che fa una dichiarazione, quella dichiarazione dovrebbe essere verificabile attraverso canali ufficiali — conferenze stampa, social media ufficiali, reportage delle agenzie di stampa. L’assenza di qualsiasi corroborazione è significativa.

- Controlla se il presunto oratore ha rilasciato una dichiarazione. La maggior parte dei deepfake politici viene smentita rapidamente dalla persona raffigurata. Cerca risposte dagli account ufficiali verificati della persona rappresentata e dalle comunicazioni ufficiali.

- Esamina la rete di distribuzione. Gli account che diffondono per primi un presunto deepfake spesso hanno storie di diffusione di altri contenuti sintetici o manipolati sospetti. Strumenti come il Botometer dell’Università dell’Indiana possono aiutare a valutare se gli account di amplificazione mostrano pattern di comportamento automatizzato.

Cloni Vocali IA: Il Deepfake Solo Audio

I deepfake audio — cloni vocali che replicano la voce di una persona specifica usando l’IA — vengono sempre più usati in frodi finanziarie mirate, impersonificazione non consensuale e disinformazione politica. Non richiedono video e sono significativamente più economici e veloci da produrre rispetto ai deepfake video.

Un tipo di caso documentato: un clone vocale di una figura politica o di un CEO viene usato per istruire dipendenti, parenti o il pubblico a compiere un’azione — trasferire fondi, cambiare una password di sicurezza o sostenere una narrativa falsa. La tecnologia di clonazione richiede appena tre secondi di audio di addestramento da qualsiasi registrazione disponibile pubblicamente, secondo la ricerca del modello VALL-E di Microsoft e sistemi simili pubblicata nel 2023.

Gli indicatori di verifica audio includono: assenza di variazione naturale del rumore di fondo (le registrazioni reali hanno un pavimento del rumore che cambia; l’audio sintetico è spesso innaturalmente uniforme), mismatch della prosodia (il ritmo e i pattern di stress del discorso non corrispondono allo stile documentato dell’oratore), e assenza di suoni respiratori o rumori della bocca tra le parole. Per l’audio ad alto rischio, il confronto con registrazioni autenticate dello stesso periodo di tempo è il controllo più affidabile.

Riferimento Rapido: Identificazione dei Deepfake

- Controllo visivo (30 secondi): Cerca artefatti di fusione all’attaccatura dei capelli, incoerenza dell’illuminazione tra volto e sfondo, movimento innaturale degli occhi e texture della pelle eccessivamente liscia a velocità 0,25x.

- Controllo del lip-sync: La forma della bocca corrisponde ai suoni pronunciati? Presta particolare attenzione se il discorso è in una lingua diversa dall’inglese.

- Esegui Deepware Scanner per una valutazione automatizzata della probabilità. Usalo solo come prova di supporto, non come verdetto finale.

- Prima la provenienza: Chi ha pubblicato il video per primo? L’evento rappresentato può essere corroborato in modo indipendente attraverso canali ufficiali e redazioni credibili?

- Controlla la smentita ufficiale: La persona rappresentata ha risposto su account ufficiali verificati?

- Per i clip solo audio: Ascolta il pavimento del rumore uniforme, i mismatch della prosodia e l’assenza di respirazione naturale o suoni della bocca.

- Ricorda: L’assenza di artefatti visivi non conferma l’autenticità per i deepfake di alta qualità. L’analisi della provenienza è il metodo che scala.