Il numero di deepfake segnalati a livello globale è passato da circa 500.000 nel 2023 a un stima di 8 milioni nel 2025 — un aumento del 1.500% in due anni. Quella cifra non è una previsione. È un’escalation documentata, visibile nei database dei casi, nei rapporti di trasparenza delle piattaforme e negli archivi forensi delle organizzazioni di fact-checking. Questo articolo copre le principali categorie di casi, i metodi di rilevamento che funzionano e il quadro normativo che si sta delineando.

Dal 2024 al 2025: Cosa è Cambiato

La disinformazione generata dall’IA documentata nella nostra rassegna annuale 2024 era, in retrospettiva, un periodo di transizione. Nel 2025, tre cose erano cambiate: la qualità di generazione era migliorata abbastanza da rendere l’ispezione visiva occasionale non più affidabile per individuare i falsi; l’infrastruttura di distribuzione era diventata più sofisticata, con contenuti sintetici seminati in aggregatori di notizie dall’aspetto legittimo; e i bersagli si erano spostati dalle figure politiche principalmente a una gamma più ampia comprendente giornalisti, attivisti, dirigenti aziendali e privati cittadini.

Quattro categorie di fake news generate dall’IA hanno dominato il 2025: video deepfake di figure politiche, immagini di proteste e conflitti generate dall’IA, cloni vocali usati in campagne di disinformazione e portali di notizie interamente sintetici. Ognuna è documentata di seguito con casi verificati. Per i dettagli a livello di singolo caso, il nostro database include voci per il deepfake della resa di Zelensky e le foto di proteste generate dall’IA che forniscono contesto metodologico per i pattern qui descritti.

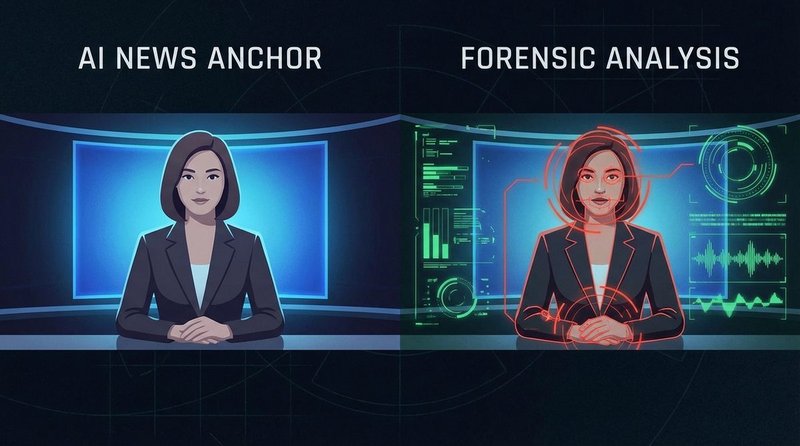

Categoria 1: Video Deepfake di Figure Politiche

I video deepfake che prendevano di mira figure politiche nel 2025 erano più numerosi, più distribuiti geograficamente e più difficili da rilevare rispetto al 2024. I casi documentati più significativi condividevano una struttura comune: una figura politica riconoscibile, una dichiarazione fabbricata allineata a una narrativa complottista esistente e una strategia di distribuzione che sfruttava gli algoritmi di raccomandazione delle piattaforme prima che i fact-checker potessero rispondere.

Deepfake delle Elezioni Canadesi

In vista delle elezioni federali canadesi del 2025, clip deepfake che imitavano i bollettini informativi di CBC e CTV hanno circolato sui social media. Una clip pretendeva di mostrare un segmento del telegiornale CBC che citava il leader liberale Mark Carney fare dichiarazioni che non aveva mai fatto. Le clip sono state identificate dall’organizzazione MediaSmarts e dal team di verifica di CBC stesso entro poche ore, ma avevano accumulato decine di migliaia di condivisioni prima della rimozione. L’uso di formati di trasmissione televisiva — inclusi i titoli in sovrimpressione e l’inquadratura della scrivania del presentatore — era deliberato: la credibilità istituzionale presa in prestito è un pattern documentato nelle campagne deepfake politiche.

Deepfake di Frode agli Investimenti nel Sud-Est Asiatico

A metà 2025, la Polizia Reale della Malaysia ha smantellato una rete che usava video generati dall’IA di politici e figure aziendali — tra cui il Primo Ministro Anwar Ibrahim, Elon Musk e Donald Trump — per promuovere schemi di investimento fraudolenti. I video erano distribuiti tramite canali WhatsApp e Telegram. La qualità del face-swap era abbastanza alta da impedire a molti destinatari di identificare la manipolazione senza strumenti tecnici. Questo caso illustra uno spostamento che i ricercatori del progetto Detect DeepFakes del MIT Media Lab avevano documentato nella loro ricerca: i deepfake progettati per ingannare in un contesto finanziario o di frode sono spesso di qualità superiore a quelli progettati per la messaggistica politica, perché il guadagno finanziario giustifica un investimento produttivo maggiore.

Il Deepfake Vocale di Rubio

Una clip audio clonata vocalmente e falsamente attribuita al Segretario di Stato americano Marco Rubio ha circolato all’inizio del 2025, raffigurandolo fare dichiarazioni incoerenti con le posizioni ufficiali della politica estera statunitense. La clip è stata segnalata dal sistema di autenticazione vocale di Pindrop e successivamente analizzata da diversi team forensi audio indipendenti. Il rilevamento si basava sull’analisi spettrale — i cloni vocali producono costantemente artefatti in specifiche gamme di frequenza che le orecchie umane non registrano ma gli strumenti di visualizzazione spettrale evidenziano immediatamente. Questo caso ha rinnovato le richieste di standard di autenticazione vocale nelle comunicazioni politiche, compresa quella della FCC, che stava già sviluppando linee guida in seguito alla sentenza sulla robocall Biden del 2024.

Categoria 2: Immagini di Proteste e Conflitti Generate dall’IA

Le immagini di proteste ed eventi di conflitto generate dall’IA rappresentano un modello di minaccia distinto dai video deepfake: sono più economiche da produrre, più difficili da tracciare e sfruttano il momento di breaking news in cui la pressione di verifica è più alta e lo scetticismo del pubblico è più basso.

Il Pattern delle Rivolte UK (Stabilito nel 2024, Continuato nel 2025)

Durante le rivolte del Regno Unito dell’agosto 2024, immagini generate dall’IA si sono diffuse entro poche ore dagli incidenti reali — inclusa una fotografia fabbricata che mostrava falsamente agenti di polizia britannici prostrarsi davanti a un gruppo musulmano. L’immagine è stata identificata come generata dall’IA dall’analisi forense entro 24 ore, ma era già stata condivisa centinaia di migliaia di volte su X. L’iterazione 2025 di questo pattern — documentata in molteplici contesti di protesta in Europa e Nord America — mostrava una qualità di generazione migliorata e un seeding iniziale più rapido, suggerendo una distribuzione più coordinata piuttosto che una condivisione organica. La documentazione completa del caso è disponibile nella nostra voce del database foto di proteste generate dall’IA.

Le Immagini delle Proteste “No Kings”

Nel giugno 2025, immagini generate dall’IA che raffiguravano celebrità tra cui Taylor Swift e Travis Kelce alle proteste politiche statunitensi hanno circolato su Facebook e X. La verifica di PolitiFact ha confermato che nessuno dei due era presente agli eventi raffigurati. Le immagini usavano artefatti visivi coerenti — mani anatomicamente distorte, gradienti di densità della folla implausibili, texture del cielo dall’aspetto sintetico — che sarebbero apparenti sotto un’ispezione ravvicinata, ma circolavano principalmente come miniature compresse dove tali dettagli sono invisibili. Questo caso è documentato nel nostro database come esempio del pattern di manipolazione della prossimità alle celebrità: allegare una figura pubblica riconoscibile e fidata a un messaggio politico tramite immagini sintetiche per prendere in prestito legittimità percepita.

Manipolazione della Copertura dei Disastri

Ogni significativo disastro naturale nel 2025 è stato accompagnato, entro poche ore, da immagini generate dall’IA che raffiguravano distruzioni fabbricate o esagerate. AFP Fact Check e BBC Verify hanno documentato questo pattern costantemente attraverso eventi alluvionali nell’Asia meridionale, incendi boschivi in Nord America e terremoti nell’Asia centrale. Il ritardo di produzione per la generazione di immagini IA — ora misurato in secondi — significa che le immagini sintetiche di disastri raggiungono i social media prima della fotografia ufficiale dalla scena. Le piattaforme che avevano implementato l’etichettatura dei contenuti IA hanno catturato alcune istanze; quelle che non lo avevano fatto ne hanno catturate pochissime.

Categoria 3: Cloni Vocali nelle Campagne di Disinformazione

La clonazione vocale è il vettore di inganno IA in più rapida crescita nel 2025. Strumenti disponibili commercialmente — tra cui ElevenLabs, Voice Engine di OpenAI e diverse alternative open-source — possono produrre un clone vocale convincente da appena tre secondi di audio sorgente. Il tasso di attacchi deepfake basati sulla voce è aumentato di oltre il 1.300% tra il 2023 e il 2025, da circa un incidente al mese a più di sette al giorno, secondo il Voice Intelligence and Security Report 2025 di Pindrop.

Campagne Robocall

Sulla scia del precedente della robocall Biden del 2024, campagne robocall con voce clonata che prendevano di mira gli elettori sono apparse in almeno sei paesi durante elezioni o referendum del 2025. La sentenza della FCC del gennaio 2024 che classificava le robocall con voce IA come illegali ai sensi del TCPA ha limitato — ma non eliminato — il loro uso negli Stati Uniti. I casi internazionali hanno affrontato quadri giuridici incoerenti: diversi Stati membri dell’UE non disponevano di legislazione specifica che coprisse i contenuti vocali generati dall’IA prima che le disposizioni di trasparenza dell’AI Act UE diventassero operative nel 2026.

Truffe Telefoniche su Scala

L’impatto più dannoso della clonazione vocale nel 2025 non è stato politico ma finanziario. L’Internet Crime Complaint Center (IC3) dell’FBI ha documentato un forte aumento delle varianti della “truffa del nonno” che utilizzavano voci clonate di familiari per richiedere bonifici bancari di emergenza. Un sondaggio pubblicato nel 2026 stimava che 1 americano su 4 avesse incontrato un’interazione vocale deepfake nell’anno precedente — sebbene non tutte fossero truffe. Le perdite finanziarie dovute alla frode con cloni vocali nel 2025 erano stimate in oltre 2,5 miliardi di dollari solo negli Stati Uniti.

Categoria 4: Portali di Notizie Interamente Sintetici

Lo sviluppo strutturalmente più preoccupante del 2025 non è stato un video falso specifico o una voce clonata, ma la proliferazione di siti web di notizie interamente generati dall’IA — portali senza personale editoriale umano, senza giornalisti reali e senza strutture di responsabilità, che producono un flusso continuo di contenuti dall’aspetto plausibile progettati per essere indicizzati dai motori di ricerca e raccomandati dalle piattaforme social.

I Rapporti sulle Minacce Avversariali di Meta del 2024 avevano già documentato portali di notizie sintetici collegati a stati che usavano avatar di presentatori televisivi IA. Nel 2025, questa tecnica non era più limitata agli attori statali. Il monitoraggio di NewsGuard aveva identificato centinaia di quelli che definisce siti UAIN (Unreliable AI-Generated News — Notizie Generate dall’IA Inaffidabili) — domini che producevano contenuti interamente generati da macchine su una gamma di nicchie politiche, monetizzati attraverso pubblicità programmatica. Questi siti tipicamente non fabbricano fatti individuali quanto piuttosto fabbricano contesto: eventi reali descritti attraverso un frame editoriale costantemente fuorviante, senza processo di correzione, senza firme e senza metodologia dichiarata.

La rete “Pravda” documentata in vista delle elezioni UE del 2024 era una versione precoce di questo modello. I suoi successori del 2025 erano più numerosi, linguisticamente più sofisticati e più difficili da tracciare agli attori di origine.

Rilevamento: Metodi Tecnici

Il rilevamento tecnico dei deepfake opera su tre livelli: analisi degli artefatti, forensica dei metadati e verifica della provenienza. Nessun metodo singolo è sufficiente. Usati insieme, aumentano drammaticamente l’accuratezza del rilevamento.

Analisi degli Artefatti Visivi

La generazione attuale di immagini e video IA produce costantemente artefatti caratteristici: inconsistenze del confine facciale alle attaccature dei capelli e ai margini delle orecchie; mani anatomicamente scorrette (dita in eccesso, dita fuse, angolazioni articolari implausibili); riflessi oculari innaturali che non corrispondono all’illuminazione della scena; e texture della pelle renderizzata a risoluzione incoerente su tutto il volto. Questi artefatti non sono sempre visibili alle dimensioni normali di visualizzazione ma emergono chiaramente con uno zoom al 200% o con strumenti di miglioramento forense come Forensically (29a.ch) o FotoForensics.

Per i video, le inconsistenze temporali sono altrettanto rivelatrici: geometria facciale che non segue in modo coerente i fotogrammi, tassi di ammiccamento innaturali (i deepfake addestrati su dati con occhi aperti tendono ad ammiccare poco) e illuminazione che cambia tra i tagli in modi incoerenti con un singolo ambiente fisico.

Analisi dei Metadati e EXIF

Le fotografie autentiche incorporano metadati tecnici (dati EXIF) inclusi modello della fotocamera, specifiche dell’obiettivo, timestamp di scatto e — dove i servizi di localizzazione erano attivi — coordinate GPS. Le immagini generate dall’IA tipicamente hanno dati EXIF eliminati o assenti, o metadati generici incoerenti con il dispositivo dichiarato. Jeffrey’s Exif Viewer e ExifTool (riga di comando) evidenziano entrambi queste informazioni. Una foto che afferma di documentare un evento in diretta ma che mostra nessun dato GPS e un blocco EXIF generico generato da software merita una verifica immediata.

Analisi Spettrale dell’Audio

I cloni vocali producono artefatti in specifiche gamme di frequenza — in particolare sopra gli 8kHz, dove le armoniche vocali naturali diventano irregolari nella sintesi. Gli strumenti di spettrogramma che visualizzano la frequenza audio nel tempo (Audacity, iZotope RX, Adobe Audition) rendono visibili queste anomalie. Il sistema di autenticazione vocale enterprise di Pindrop usa oltre 1.300 caratteristiche acustiche per distinguere le voci clonate da quelle autentiche — un livello di sofisticazione non disponibile agli utenti occasionali, ma accessibile alle redazioni e alle organizzazioni di monitoraggio elettorale.

Ricerca Inversa di Immagini e Video

Il primo passo più semplice e costantemente più efficace rimane la ricerca inversa delle immagini: Google Immagini, TinEye e Yandex Immagini possono individuare apparizioni precedenti di fotografie riciclate in pochi secondi. Per i video, il plugin browser InVID/WeVerify consente l’estrazione fotogramma per fotogramma e la ricerca inversa, rendendo possibile identificare filmati riciclati anche quando sono stati rimontati o riquadrati. Questa tecnica non rileva contenuti sintetici appena generati — rileva contenuti autentici travisati, che rimane la maggioranza della disinformazione in circolazione.

Rilevamento: Metodi Giornalistici

Gli strumenti tecnici identificano gli artefatti. I metodi giornalistici stabiliscono la provenienza — la catena documentata di custodia dalla creazione alla pubblicazione. La verifica della provenienza è l’approccio raccomandato dal metodo SIFT, trattato in dettaglio nel nostro laboratorio sui deepfake.

Triangolazione delle Fonti

Nessuna singola fonte dovrebbe essere considerata sufficiente per verificare le affermazioni sui media sintetici. Il riferimento incrociato richiede come minimo: la fonte originale (chi ha pubblicato o condiviso il contenuto per primo?), una seconda fonte indipendente con accesso diretto all’evento o alla persona raffigurata e un’organizzazione di verifica di terze parti (Reuters Fact Check, AFP Fact Check, BBC Verify o il desk di fact-checking di AP). Se due di questi tre non possono essere confermati, il contenuto dovrebbe essere trattato come non verificato indipendentemente dalla sua apparente qualità.

Verifica del Contesto

Un deepfake tecnicamente inrilevabile può comunque essere smascherato attraverso l’inconsistenza contestuale. Il team di ricerca del MIT Media Lab — che ha condotto cinque esperimenti randomizzati pre-registrati con 2.215 partecipanti sul rilevamento umano dei deepfake di discorsi politici — ha rilevato che le trascrizioni testuali erano spesso sufficienti per identificare l’implausibilità, anche quando l’audio e il video sembravano realistici. Verificare se le dichiarazioni raffigurate sono coerenti con le posizioni documentate del soggetto, il suo stile comunicativo e la sua posizione fisica nel momento dichiarato è un passo di verifica fondamentale che non richiede strumenti tecnici.

Cronologia del Dominio e della Pubblicazione

Per i contenuti dei portali di notizie sintetici: la data di registrazione WHOIS, la cronologia del dominio tramite la Wayback Machine e la verifica della firma (i giornalisti elencati hanno storie professionali verificabili al di fuori del sito?) sono i tre controlli rapidi più affidabili. Le organizzazioni di notizie legittime hanno storie di pubblicazione che precedono la storia condivisa. I portali di notizie generati dall’IA tipicamente mostrano una registrazione del dominio negli ultimi 12 mesi e firme senza traccia di verifica esterna.

La Risposta Normativa: AI Act UE e C2PA

Due framework paralleli stanno convergendo per creare la prima infrastruttura giuridicamente eseguibile per la divulgazione dei media sintetici: gli obblighi di trasparenza dell’AI Act UE e lo standard tecnico C2PA della Content Authenticity Initiative.

AI Act UE: Obblighi di Trasparenza dell’Articolo 50

L’Articolo 50 dell’AI Act UE impone ai fornitori di sistemi IA che generano contenuti audio, immagini, video o testo sintetici di marcare gli output in un formato leggibile da macchina rilevabile come artificialmente generato o manipolato. I deployer devono divulgare quando l’IA viene usata per creare contenuti sintetici realistici. I deepfake devono essere etichettati anche quando il contenuto è lecito; solo i contenuti “evidentemente artistici, creativi, satirici o fittizi” si qualificano per requisiti di divulgazione ridotti.

Gli obblighi di trasparenza ai sensi dell’Articolo 50 diventano eseguibili il 2 agosto 2026. La Commissione Europea ha pubblicato la prima bozza del Codice di Condotta sulla marcatura e l’etichettatura dei contenuti generati dall’IA il 17 dicembre 2025, stabilendo standard tecnici per la filigranatura e i metadati di provenienza in anticipo rispetto alla data di applicazione legale. Le sanzioni per la non conformità arrivano fino a 35 milioni di euro o al 7% del fatturato annuo globale — un livello inteso a creare pressione di conformità sulle principali piattaforme e fornitori di IA.

L’ambito territoriale del regolamento si estende oltre i confini dell’UE: qualsiasi azienda i cui sistemi IA o contenuti sintetici raggiungano utenti UE deve conformarsi, indipendentemente da dove ha sede l’azienda. Questo rende l’AI Act UE, di fatto, uno standard globale per le piattaforme che raggiungono il pubblico europeo.

C2PA Content Credentials

La Coalition for Content Provenance and Authenticity (C2PA), che include Adobe, Microsoft, Google, OpenAI, Meta e le principali organizzazioni di notizie, ha sviluppato uno standard tecnico che incorpora metadati di provenienza firmati crittograficamente in file di immagini, audio e video. Le Content Credentials registrano chi ha creato il contenuto, quali strumenti sono stati usati, quali modifiche sono state apportate e se è stata coinvolta la generazione IA — creando una catena di custodia a prova di manomissione dalla creazione alla pubblicazione.

Adobe ha integrato C2PA in Photoshop, Lightroom e Firefly. YouTube ha aggiunto etichette basate sulla provenienza nel 2024. Il Dipartimento della Difesa degli Stati Uniti ha pubblicato linee guida nel gennaio 2025 raccomandando l’adozione di C2PA per le comunicazioni governative. DALL-E 3 e Sora di OpenAI incorporano metadati C2PA per impostazione predefinita.

Un limite critico: C2PA verifica i contenuti autentici — non rileva i deepfake. L’assenza di metadati C2PA non significa che il contenuto sia sintetico; anche i contenuti creati su dispositivi più vecchi o con strumenti che non supportano ancora lo standard mancheranno di credenziali. Come nota la stessa documentazione dello standard, le credenziali mancanti dovrebbero suscitare ulteriore scrutinio, non un rifiuto automatico. Un’implementazione C2PA completa fornisce solide prove di provenienza; la sua assenza è un’assenza di prove, non una prova di manipolazione.

Anche le implicazioni sulla privacy sono oggetto di discussione attiva. I metadati C2PA possono includere timestamp, geolocalizzazione e storie di modifica. La indagine di Fortune pubblicata nel settembre 2025 ha documentato casi in cui i metadati C2PA avevano catturato dati di localizzazione che i creatori di contenuti non intendevano condividere. Lo standard include disposizioni per rimuovere i metadati sensibili prima della pubblicazione, ma la coerenza dell’implementazione tra le piattaforme rimane disomogenea.

Cosa Aspettarsi nel 2026

Tre sviluppi plasmeranno il panorama della disinformazione generata dall’IA nel 2026 e oltre.

L’applicazione inizia. Le disposizioni dell’Articolo 50 dell’AI Act UE diventano giuridicamente eseguibili nell’agosto 2026. Questo creerà il primo grande test di verifica se i requisiti normativi di divulgazione possano rallentare la produzione e la distribuzione della disinformazione nei media sintetici. I segnali di conformità precoce delle principali piattaforme sono contrastanti: Adobe, Google e OpenAI hanno assunto impegni credibili; i fornitori di IA più piccoli e le piattaforme di distribuzione sono meno preparati.

La corsa agli armamenti del rilevamento continua. Le capacità di generazione e rilevamento si evolvono in parallelo. La ricerca del MIT Media Lab — e la letteratura più ampia — mostra costantemente che né gli osservatori umani né gli strumenti di rilevamento automatizzati sono affidabilmente accurati su tutti i tipi di deepfake. La combinazione di giudizio umano e analisi assistita da macchina supera entrambi i singoli approcci. Le redazioni, i monitor elettorali e i team di fiducia e sicurezza delle piattaforme stanno investendo in flussi di lavoro di rilevamento ibridi; i singoli fruitori dei media rimangono in gran parte con gli stessi strumenti di cui disponevano nel 2024.

L’infrastruttura di verifica si sta espandendo, lentamente. Il metodo SIFT, l’adozione di C2PA e le reti di fact-checking multi-piattaforma rappresentano un progresso reale. La capacità di verifica del più ampio ecosistema di alfabetizzazione mediatica — insegnanti, bibliotecari, organizzazioni civiche — cresce attraverso workshop e strumenti come quelli coperti nel nostro laboratorio sull’identificazione dei deepfake. Il divario tra la capacità di produzione e quella di verifica rimane ampio, ma non si sta più allargando con la stessa velocità del 2023.

Per i casi fondamentali che hanno stabilito il panorama attuale delle minacce — incluso il deepfake della resa di Zelensky e l’ondata di foto di proteste IA del 2024 — l’indice delle verifiche e il database dei casi forniscono documentazione completa con note metodologiche.