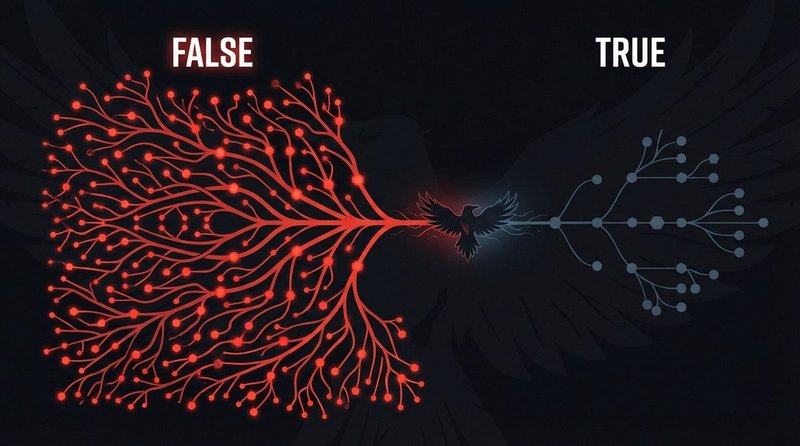

As notícias falsas espalham-se mais depressa, mais longe e com maior profundidade do que as verdadeiras nas redes sociais — não porque as pessoas sejam irracionais, mas porque as histórias falsas são construídas para explorar os mesmos atalhos cognitivos que nos tornam processadores de informação eficientes. Compreender o mecanismo é o primeiro passo para lhe resistir.

Os Dados: O Que o Estudo do MIT Concluiu

A referência empírica fundamental sobre este tema é um estudo de 2018 de Soroush Vosoughi, Deb Roy e Sinan Aral, publicado na revista Science (Vol. 359, n.º 6380). Os investigadores analisaram a propagação de cerca de 126.000 histórias verificadas partilhadas no Twitter entre 2006 e 2017, por aproximadamente 3 milhões de pessoas, mais de 4,5 milhões de vezes.

As conclusões foram inequívocas. As notícias falsas chegaram a 1.500 pessoas aproximadamente seis vezes mais depressa do que as verdadeiras. Espalharam-se de forma mais abrangente para utilizadores únicos (mais pessoas viram histórias falsas do que verdadeiras) e com maior profundidade (as histórias falsas penetraram mais fundo nas redes sociais através de cadeias de partilha mais longas). O efeito foi mais pronunciado na desinformação política. E, de forma crucial: os investigadores controlaram para bots. Os humanos, e não as contas automatizadas, foram o principal vetor de propagação de notícias falsas. Os bots espalharam histórias verdadeiras e falsas a ritmos semelhantes; a diferença de amplificação humana foi a descoberta significativa.

A explicação do estudo para a assimetria: as notícias falsas são mais novidade (contêm informações que o público ainda não viu) e mais envolventes emocionalmente. As histórias classificadas como falsas pelos verificadores de factos geraram respostas significativamente mais elevadas nas categorias de surpresa, medo e nojo. As histórias verdadeiras geraram mais tristeza e antecipação — estados emocionais de menor intensidade que produzem menos comportamento de partilha.

Gatilhos Emocionais: A Arquitetura do Conteúdo Falso Viral

A desinformação viral explora de forma consistente três categorias de resposta emocional. Conhecê-las não torna ninguém imune — as respostas são fisiológicas — mas cria uma breve janela de avaliação deliberada antes de agir por impulso de partilha.

Indignação

A indignação moral é o preditor mais fiável do comportamento de partilha nas redes sociais. Um estudo de 2017 de Brady et al. nas PNAS concluiu que cada palavra moral-emocional acrescentada a um tweet aumentava as taxas de retweet em aproximadamente 20%. As histórias falsas virais utilizam sistematicamente o enquadramento de indignação — apresentam eventos como injustiças, traições ou ameaças aos valores do grupo interno. O conteúdo não precisa de ser inteiramente falso para desencadear indignação; o enquadramento seletivo de eventos reais, desprovido de contexto, funciona igualmente bem.

Medo

A desinformação baseada em ameaças ativa a amígdala antes de o córtex pré-frontal conseguir aplicar raciocínio analítico — um fenómeno bem documentado em neurociência cognitiva. A desinformação sobre saúde («Este alimento/vacina/substância está a matar-nos»), a desinformação sobre criminalidade («A criminalidade está a aumentar no seu bairro») e as narrativas de ameaça à identidade («Estão a substituir a sua cultura») exploram todas respostas de medo. O conteúdo espalha-se rapidamente porque partilhá-lo parece protetor — está a avisar a sua rede — o que cria uma motivação pró-social para amplificar informações falsas.

Schadenfreude e Satisfação Tribal

As histórias que validam crenças negativas sobre um grupo externo — adversários políticos, nações rivais, inimigos ideológicos — ativam circuitos de recompensa em vez de respostas de ameaça. Partilhá-las sente-se bem. A investigação de Pennycook & Rand (2019) na Social Psychological and Personality Science concluiu que a «congruência partidária» (conteúdo que confirmava crenças políticas existentes) era o preditor mais forte da intenção de partilha — mais forte do que a perceção de precisão do conteúdo. As pessoas partilham conteúdo porque parece verdadeiro para a sua visão do mundo, não necessariamente porque acreditam que é factualmente correto.

Algoritmos das Plataformas e Otimização do Envolvimento

A arquitetura das plataformas não cria desinformação, mas é um mecanismo de amplificação significativo. O princípio de design central dos sistemas de recomendação otimizados para o envolvimento — maximizar o tempo na plataforma — recompensa estruturalmente o conteúdo emocionalmente ativador, independentemente da sua precisão.

Um estudo interno do Facebook de 2021, reportado pelo Wall Street Journal com base em documentos filtrados, concluiu que os próprios investigadores do Facebook tinham identificado que a sua alteração de algoritmo de 2018 (que passou a privilegiar «interações sociais significativas» — conteúdo que gerava comentários e reações em vez de visualizações passivas) tinha o efeito de amplificar conteúdo gerador de indignação, incluindo desinformação. Os investigadores propuseram correções; as correções não foram implementadas em escala por preocupações com a redução do envolvimento geral.

O mecanismo não é exclusivo do Facebook. O algoritmo de recomendação do YouTube, tal como documentado numa auditoria de 2020 por Ribeiro et al., recomendava consistentemente conteúdo progressivamente mais extremo assim que um utilizador começava a ver conteúdo em certas categorias políticas ou conspiracionistas — um efeito de «espiral» impulsionado pela otimização do tempo de visualização. O feed algorítmico do Twitter/X demonstrou, nos próprios investigadores da plataforma, amplificar conteúdo político de direita mais do que o de esquerda em vários países, independentemente das diferenças de envolvimento. O estudo interno de 2021 da plataforma publicou esta conclusão voluntariamente.

A implicação estrutural: as plataformas construídas para maximizar o envolvimento amplificarão sistematicamente conteúdo que desencadeia respostas emocionais fortes — que é, por design, o que as notícias falsas e enganosas são construídas para fazer.

Timing: Quando as Notícias Falsas São Mais Perigosas

As informações falsas não se espalham uniformemente ao longo do tempo. Três contextos específicos criam condições onde a desinformação se espalha mais depressa e as correções são menos eficazes.

Janelas de Última Hora

Os primeiros 30 a 60 minutos após um grande evento são quando a informação verificada é mais escassa e a procura do público é mais elevada. A desinformação preenche o vazio. A investigação do Reuters Institute for the Study of Journalism conclui consistentemente que as alegações falsas introduzidas durante janelas de notícias de última hora são mais difíceis de corrigir do que as introduzidas após a existência de reportagens de referência, porque a versão falsa torna-se frequentemente a âncora mental que o público usa para avaliar as correções subsequentes.

Eleições e Campanhas Políticas

Os períodos eleitorais mostram picos consistentes no volume e velocidade da desinformação em todos os contextos democráticos estudados. A base de dados EU vs Disinfo documenta a amplificação em período eleitoral nos estados-membros da UE em cada ciclo eleitoral desde 2014. A combinação de elevadas apostas políticas, forte motivação tribal para partilhar conteúdo favorável e ambientes mediáticos fragmentados cria condições ótimas para que informações falsas cheguem a grandes públicos antes de os verificadores de factos conseguirem responder.

Crises de Saúde Pública

A OMS cunhou o termo «infodemia» em fevereiro de 2020 para descrever a epidemia paralela de informações falsas e enganosas sobre a COVID-19. O seu estudo conjunto com organizações parceiras concluiu que, em março de 2020, a desinformação sobre saúde estava a viajar mais depressa do que as orientações oficiais em todas as principais plataformas sociais — consequência direta dos mesmos mecanismos descritos acima, a operar num ambiente de elevado medo e elevada incerteza.

Contas Super-Disseminadoras e Efeitos de Rede

A propagação viral não é uniforme nas redes sociais. Um pequeno número de contas altamente conectadas e com elevado envolvimento — frequentemente descritas como «super-disseminadoras» — é responsável por uma parte desproporcionada da amplificação de desinformação.

A análise do NewsGuard Misinformation Monitor e de investigadores independentes que estudaram as eleições americanas de 2020 concluiu consistentemente que um pequeno número de contas — frequentemente com milhões de seguidores, frequentemente incluindo figuras políticas proeminentes — era responsável pela maioria dos episódios de desinformação de grande alcance. O padrão é estruturalmente semelhante ao que os epidemiologistas chamam «eventos de superspreader» na transmissão de doenças: a maioria das pessoas infeta zero ou uma pessoa; um pequeno número de pessoas, nas condições certas, infeta centenas.

A análise de rede ao nível das plataformas pela Graphika e pelo DFRLab documentou redes de amplificação coordenada em que contas sem qualquer relação orgânica impulsionam artificialmente o conteúdo umas das outras — comprimindo o tempo entre a publicação inicial e a exposição em massa. Isto torna a janela de notícias de última hora ainda mais curta e reduz o tempo disponível para intervenções baseadas na verificação.

Estudo de Caso: A Anatomia de um Evento Real de Notícias Falsas Virais

Em novembro de 2016, circulou uma alegação falsa de que uma pizzaria em Washington D.C. chamada Comet Ping Pong era o centro de uma rede de tráfico de crianças gerida por altos funcionários do Partido Democrata. A alegação — que ficou conhecida como «Pizzagate» — não tinha qualquer base probatória e foi investigada e rejeitada pela Polícia Metropolitana de Washington D.C. Não obstante, chegou a milhões de pessoas em poucos dias e foi diretamente citada por um homem que disparou uma espingarda dentro do restaurante a 4 de dezembro de 2016, sem ferir ninguém mas causando danos materiais significativos.

O caso Pizzagate demonstra todos os mecanismos descritos neste artigo a operar simultaneamente:

- Gatilho emocional: O perigo para crianças é uma das preocupações morais de maior intensidade emocional — ativando respostas tanto de indignação como de medo.

- Timing: Surgiu imediatamente após as eleições americanas de 2016, num momento político de elevado envolvimento e forte motivação partidária para partilhar informações prejudiciais ao partido oposto.

- Amplificação por super-disseminadores: A alegação foi promovida por contas com grandes audiências no Twitter e no YouTube, incluindo algumas com centenas de milhares de seguidores, antes da aplicação de mecanismos de moderação pelas plataformas.

- Otimização algorítmica: O algoritmo de recomendação do YouTube, segundo análises posteriores, direcionava os utilizadores do conteúdo eleitoral mainstream para vídeos sobre o Pizzagate através de percursos previsíveis de escalada de conteúdo.

- Assimetria da correção: Quando o Washington Post, o New York Times e múltiplos verificadores de factos publicaram desmentidos completos, a versão falsa já havia chegado a mais pessoas do que qualquer correção subsequente conseguiria alcançar. A descoberta de Vosoughi et al. sobre a propagação seis vezes mais rápida das notícias falsas fica aqui diretamente ilustrada.

Uma análise documentada da operação de informação Pizzagate, incluindo mapeamento da propagação, é mantida pelo Observatório Europeu dos Meios de Comunicação Digitais (EDMO) como estudo de caso de referência em operações de influência coordenadas.

Compreender estes mecanismos ao nível estrutural é o pré-requisito fundamental para avaliar conteúdo antes de o partilhar. O guia Desinformação vs. Informação Falsa → explica como a intenção se articula com estas mecânicas virais. O guia Linguagem Emocional em Títulos → oferece prática concreta para identificar enquadramentos de gatilho em títulos reais. Os casos virais documentados com análise completa de propagação estão disponíveis na Base de Dados de Notícias Falsas →. Regresse ao Centro de Literacia Mediática → para o percurso de aprendizagem estruturado completo.