Os deepfakes são vídeos e áudios gerados ou manipulados por IA que fazem uma pessoa parecer dizer ou fazer algo que nunca disse ou fez. A análise de artefactos visuais deteta deepfakes de menor qualidade, mas a análise de proveniência — rastrear onde um vídeo apareceu pela primeira vez e quem o publicou — é o método mais fiável para a maioria dos conteúdos manipulados que circulam online.

O Que São Deepfakes e Qual a Sua Prevalência

O termo “deepfake” refere-se especificamente a conteúdo multimédia gerado ou manipulado com recurso a aprendizagem profunda — redes neurais treinadas em grandes conjuntos de dados de vídeo ou áudio real para produzir resultados sintéticos que se assemelham a uma pessoa específica. A tecnologia tem duas categorias principais: deepfakes de troca de rosto (substituindo o rosto de uma pessoa pelo de outra num vídeo existente) e síntese completa (gerando uma pessoa a falar do zero, tipicamente para clones de voz).

O deepfake político mais documentado é o vídeo de rendição do Presidente ucraniano Volodymyr Zelensky, de março de 2022. O vídeo apareceu no site de notícias ucranianas Ukraine 24 após um ataque informático, circulou amplamente nas redes sociais e foi removido pela Meta, YouTube e Twitter/X no mesmo dia. O próprio Zelensky respondeu em poucas horas no Telegram, confirmando que o vídeo era fabricado. O investigador de visão computacional da UC Berkeley Hany Farid analisou o vídeo publicamente, identificando uma estratégia de codificação de baixa resolução usada para ocultar distorções faciais, um padrão de movimento da cabeça antinatural e sincronização labial que não correspondia completamente à fonética ucraniana. O caso documentado completo está na base de dados da Fake Off →.

O vídeo de Zelensky foi invulgar na sua orientação política. A maioria dos deepfakes em circulação são imagens íntimas não consensuais (estimadas em mais de 90% de todo o conteúdo deepfake por volume, de acordo com a investigação da Sensity AI de 2023) e clones de voz sintéticos usados para fraude financeira. Deepfakes políticos de alto perfil como o vídeo de Zelensky são relativamente raros mas desproporcionalmente noticiados.

Consulte também o resumo de IA e notícias falsas: 2025 → para casos documentados do último ano.

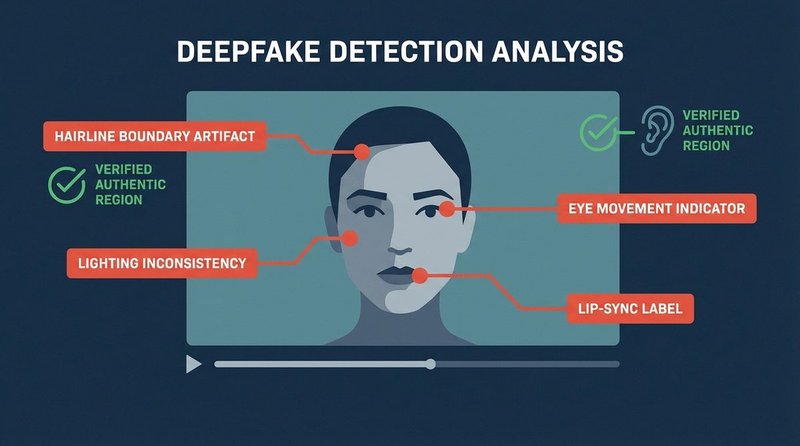

Indicadores Visuais: O Que Procurar

A análise de artefactos visuais funciona melhor em deepfakes de menor qualidade. O vídeo sintético de alta qualidade produzido por atores de nível estatal ou por operações profissionais pode não apresentar nenhum destes artefactos. Aplique a análise visual como primeira verificação — pode confirmar rapidamente um falso de baixa qualidade — mas não confie na ausência de artefactos como confirmação de autenticidade.

Pestanejar e Movimento dos Olhos

Os modelos deepfake de primeira geração (anteriores a 2020) tinham dificuldade com o pestanejar realista porque os conjuntos de dados de treino continham menos fotogramas com olhos fechados do que com olhos abertos. Isto produzia vídeos em que o sujeito pestaneja raramente ou de todo. Os modelos atuais corrigiram em grande parte isto, mas o movimento lateral rápido dos olhos e as sacadas antinatural (os micro-saltos que os olhos fazem ao explorar) continuam a ser difíceis de sintetizar de forma convincente. Observe um segmento a 0,25x de velocidade e verifique se o movimento dos olhos parece fisicamente plausível para uma pessoa a conversar.

Linha do Cabelo e Contornos das Orelhas

Os deepfakes de troca de rosto sobrepõem um rosto sintético a um vídeo existente, e a região de fronteira — em particular a linha do cabelo, as orelhas e o limite do maxilar — é onde a sobreposição tende a falhar. Procure: bordas suaves ou desfocadas onde o cabelo encontra a pele, iluminação inconsistente entre o rosto e o cabelo, distorções geométricas quando o sujeito vira a cabeça, e lóbulos de orelha que parecem estender-se ou deformar-se ligeiramente durante o movimento. Estes artefactos são mais visíveis em fotogramas estáticos de alta resolução extraídos do vídeo do que durante a reprodução.

Consistência da Iluminação e das Sombras

O rosto sintético num deepfake de troca de rosto é renderizado com iluminação derivada do material de origem, não das condições de iluminação no vídeo alvo. Quando uma pessoa move a cabeça à luz natural, o padrão de realces e sombras no rosto move-se de forma consistente com a fonte de luz. Num deepfake, essa consistência pode quebrar: o rosto pode parecer ter uma fonte de luz ambiente diferente do fundo e do pescoço, ou as sombras podem não acompanhar corretamente o movimento da cabeça.

Sincronização Labial e Correspondência Fonética

A precisão da sincronização labial é uma das áreas onde a geração de deepfakes melhorou mais rapidamente. No entanto, o mapeamento fonema-forma da boca — as posições labiais específicas necessárias para cada som numa língua específica — continua a ser uma área de síntese imperfeita, em particular para línguas que não o inglês. O vídeo de Zelensky foi parcialmente identificado através deste mecanismo: a fonética ucraniana requer movimentos bilabiais específicos que o modelo sintético não reproduziu completamente. Para deepfakes apenas de áudio (clones de voz), ouça: pausas antinatural entre palavras, prosódia que não corresponde à estrutura da frase, e um piso de ruído constante que não varia como uma gravação real variaria.

Textura da Pele e Detalhes de Alta Frequência

As redes neurais sintetizam a pele como uma superfície lisa. A pele humana real tem poros, linhas finas e textura irregular que varia entre diferentes regiões do rosto. Em vídeo, a textura da pele é renderizada dinamicamente — muda com o movimento e a iluminação. A pele sintética tende a ser demasiado lisa com iluminação desfavorável e pode apresentar uma refletividade semelhante ao plástico. Isto é mais visível à volta do nariz, testa e bochechas quando o sujeito está bem iluminado.

Ferramentas de Deteção: O Que Fazem e o Que Não Fazem

As ferramentas de deteção automatizada devem ser usadas como prova de apoio, não como veredictos definitivos. A precisão da deteção varia significativamente consoante o método de geração utilizado para criar o deepfake, e as ferramentas treinadas em conjuntos de dados de deepfakes mais antigos podem não detetar técnicas de geração mais recentes.

Deepware Scanner

O Deepware Scanner (gratuito, baseado em browser) analisa ficheiros de vídeo carregados para detetar assinaturas de deepfake usando modelos de aprendizagem profunda. Devolve uma pontuação de probabilidade em vez de um veredicto binário. Pontuações acima de 80% indicam conteúdo provavelmente sintético; entre 40–80% são inconclusivas; abaixo de 40% indica provavelmente autêntico. Use o Deepware para uma primeira avaliação rápida, não como determinação final.

Intel FakeCatcher

O FakeCatcher da Intel, desenvolvido em colaboração com investigadores da State University of New York em Binghamton e anunciado em novembro de 2022, usa uma abordagem de deteção fundamentalmente diferente. Em vez de procurar artefactos visuais, analisa sinais de fotopletismografia (PPG) — as subtis alterações de cor na pele causadas pelo fluxo sanguíneo à medida que o coração bombeia. Os rostos humanos reais mostram sinais PPG coerentes em toda a face; os rostos sintéticos não replicam este sinal biológico de forma realista. A Intel afirma uma taxa de precisão de deteção de 96% em testes controlados. O FakeCatcher está disponível principalmente para uso institucional e de plataformas; não é atualmente uma ferramenta para consumidor, mas a sua metodologia representa a direção que a deteção automatizada está a tomar.

Sensity AI

A Sensity AI oferece deteção de deepfakes empresarial para redações e plataformas, com uma divisão de investigação que publica relatórios anuais sobre o volume e os padrões de distribuição de deepfakes. A sua API de deteção não é publicamente gratuita, mas a sua investigação publicada é uma fonte autorizada para compreender a escala atual dos conteúdos multimédia sintéticos.

O Que as Ferramentas Não Conseguem Fazer

Nenhuma ferramenta de deteção automatizada é fiável contra deepfakes adversariais de nível estatal — conteúdo multimédia sintético especificamente otimizado para contornar os métodos de deteção conhecidos. A existência de deepfakes adversariais está bem documentada na literatura académica. Isto significa que as ferramentas automatizadas podem confirmar um deepfake de baixa a média qualidade, mas um resultado negativo (“provavelmente autêntico”) não garante autenticidade quando os riscos são elevados. Combine os resultados das ferramentas com análise visual e, mais importante, investigação de proveniência.

Análise de Proveniência: O Método Mais Fiável

Para a maioria dos deepfakes que circulam nas redes sociais, a análise de proveniência — rastrear a origem e a cadeia de distribuição do conteúdo — é mais fiável do que a análise visual ou automatizada. Um vídeo que circula primeiro em contas conhecidas de operações de influência ligadas a estados, que aparece sem uma cadeia de documentação verificável do evento, e que nenhuma organização noticiosa credível consegue corroborar, deve ser tratado como não verificado independentemente do que mostra.

A análise de proveniência para vídeo segue os mesmos princípios que a pesquisa inversa de imagens para fotografias. Aplique o fluxo de trabalho de Pesquisa Inversa de Imagens → usando o plugin InVID/WeVerify para extrair fotogramas-chave e pesquisar cada um independentemente. Para vídeos completos:

- Encontre a primeira aparição. Quem publicou este vídeo pela primeira vez? Uma pesquisa na plataforma onde o encontrou, combinada com uma pesquisa inversa de fotogramas-chave, frequentemente encontra o carregamento original. Um vídeo publicado pela primeira vez por contas anónimas sem ligação ao evento alegado é um sinal de alerta.

- Verifique se algum meio credível verificou independentemente o evento retratado. Se um vídeo afirma mostrar uma figura política a fazer uma declaração, essa declaração deve ser verificável através de canais oficiais — conferências de imprensa, redes sociais oficiais, reportagem de agências noticiosas. A ausência de qualquer corroboração é significativa.

- Verifique se o alegado orador emitiu uma declaração. A maioria dos deepfakes políticos é rapidamente repudiada pela pessoa retratada. Pesquise respostas nas contas oficiais verificadas e nas comunicações oficiais do indivíduo retratado.

- Examine a rede de distribuição. As contas que espalharam pela primeira vez um deepfake suspeito frequentemente têm historial de distribuição de outros conteúdos sintéticos ou manipulados suspeitos. Ferramentas como o Botometer da Universidade de Indiana podem ajudar a avaliar se as contas de amplificação mostram padrões de comportamento automatizado.

Clones de Voz de IA: O Deepfake Apenas de Áudio

Os deepfakes de áudio — clones de voz que replicam a voz de uma pessoa específica usando IA — são cada vez mais usados em fraude financeira direcionada, em falsificação não consensual e em desinformação política. Não requerem vídeo e são significativamente mais baratos e rápidos de produzir do que os deepfakes de vídeo.

Um tipo de caso documentado: um clone de voz de uma figura política ou CEO é usado para instruir funcionários, familiares ou o público a tomar uma ação — transferir fundos, alterar uma senha de segurança ou apoiar uma narrativa falsa. A tecnologia de clonagem requer apenas três segundos de áudio de treino de qualquer gravação publicamente disponível, de acordo com a investigação do modelo VALL-E da Microsoft e sistemas similares publicada em 2023.

Os indicadores de verificação de áudio incluem: ausência de variação natural de fundo (as gravações reais têm um piso de ruído que se desloca; o áudio sintético é frequentemente uniformemente antinatural), discrepâncias de prosódia (os padrões de ritmo e stress da fala que não correspondem ao estilo documentado do orador) e ausência de sons de respiração ou de boca entre palavras. Para áudio de alto risco, a comparação com gravações autenticadas do mesmo período é a verificação mais fiável.

Referência Rápida: Identificação de Deepfakes

- Verificação visual (30 segundos): Procure artefactos de mistura na linha do cabelo, inconsistência de iluminação entre rosto e fundo, movimento antinatural dos olhos e textura de pele demasiado lisa a 0,25x de velocidade.

- Verificação da sincronização labial: A forma da boca corresponde aos sons que estão a ser falados? Preste especial atenção se o discurso for numa língua que não o inglês.

- Execute o Deepware Scanner para uma avaliação automatizada de probabilidade. Use apenas como prova de apoio, não como veredicto final.

- Proveniência primeiro: Quem publicou o vídeo pela primeira vez? O evento retratado pode ser corroborado independentemente através de canais oficiais e redações credíveis?

- Verifique repúdios oficiais: A pessoa retratada respondeu nas suas contas oficiais verificadas?

- Para clipes apenas de áudio: Ouça o piso de ruído uniforme, discrepâncias de prosódia e ausência de respiração ou sons naturais de boca.

- Lembre-se: A ausência de artefactos visuais não confirma autenticidade para deepfakes de alta qualidade. A análise de proveniência é o método que escala.