O número de deepfakes reportados globalmente passou de cerca de 500.000 em 2023 para uma estimativa de 8 milhões em 2025 — um aumento de 1.500% em dois anos. Este valor não é uma previsão. É uma escalada documentada, visível nas bases de dados de casos, nos relatórios de transparência das plataformas e nos arquivos forenses das organizações de verificação de factos. Este artigo cobre as principais categorias de casos, os métodos de deteção que funcionam e o quadro regulatório atualmente em formação.

De 2024 a 2025: O Que Mudou

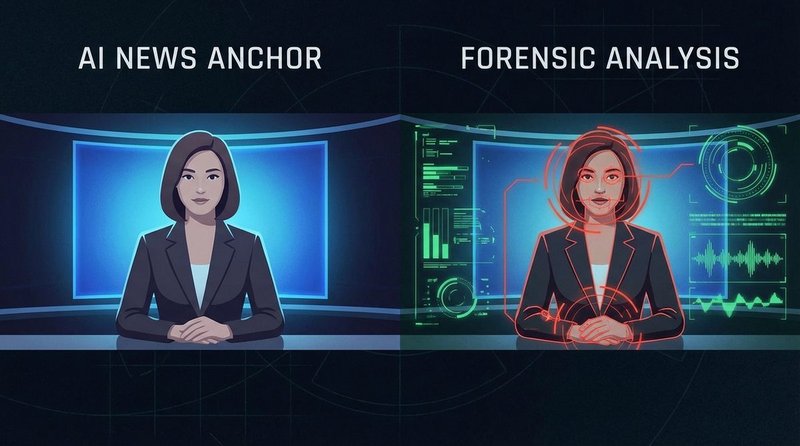

A desinformação gerada por IA documentada na nossa análise anual de 2024 foi, em retrospetiva, um período de transição. Em 2025, três coisas tinham mudado: a qualidade de geração melhorou o suficiente para que a inspeção visual casual já não detetasse de forma fiável os falsos; a infraestrutura de distribuição tornou-se mais sofisticada, com conteúdo sintético inserido em agregadores de notícias de aparência legítima; e os alvos alargaram-se das figuras políticas para um âmbito mais vasto, incluindo jornalistas, ativistas, executivos de empresas e particulares.

Quatro categorias de notícias falsas geradas por IA dominaram 2025: vídeos deepfake de figuras políticas, imagens de protestos e conflitos geradas por IA, clones de voz utilizados em campanhas de desinformação e portais de notícias inteiramente sintéticos. Cada uma é documentada abaixo com casos verificados. Para detalhe ao nível do caso, a nossa base de dados inclui entradas para o deepfake da rendição de Zelensky e fotos de protestos geradas por IA que fornecem contexto metodológico para os padrões descritos aqui.

Categoria 1: Vídeos Deepfake de Figuras Políticas

Os vídeos deepfake visando figuras políticas em 2025 eram mais numerosos, mais distribuídos geograficamente e mais difíceis de detetar do que em 2024. Os casos documentados mais significativos partilhavam uma estrutura comum: uma figura política reconhecível, uma declaração fabricada alinhada com uma narrativa conspiracionista existente, e uma estratégia de distribuição que explorava os algoritmos de recomendação das plataformas antes de os verificadores de factos conseguirem responder.

Deepfakes nas Eleições Canadianas

Na preparação das eleições federais canadianas de 2025, clipes deepfake imitando boletins noticiosos da CBC e da CTV circularam nas redes sociais. Um clipe pretendia mostrar um segmento noticioso da CBC citando o líder liberal Mark Carney a fazer declarações que nunca fez. Os clipes foram identificados pela organização MediaSmarts e pela própria equipa de verificação da CBC em poucas horas, mas tinham acumulado dezenas de milhares de partilhas antes da remoção. O uso de formatos de transmissão noticiosa — incluindo legendas no ecrã e enquadramento de secretária de âncora — foi deliberado: a credibilidade institucional emprestada é um padrão documentado nas campanhas de deepfakes políticos.

Deepfakes de Fraude de Investimento no Sudeste Asiático

Em meados de 2025, a Polícia Real da Malásia desmantelou uma rede que utilizava vídeos gerados por IA de políticos e figuras empresariais — incluindo o Primeiro-Ministro Anwar Ibrahim, Elon Musk e Donald Trump — para promover esquemas de investimento fraudulentos. Os vídeos foram distribuídos através de canais do WhatsApp e do Telegram. A qualidade da troca de rostos era suficientemente elevada para que muitos destinatários não conseguissem identificar a manipulação sem ferramentas técnicas. Este caso ilustra uma mudança que os investigadores do projeto Detect DeepFakes do MIT Media Lab tinham documentado na sua investigação: os deepfakes concebidos para enganar num contexto financeiro ou de fraude são frequentemente de maior qualidade do que os concebidos para mensagens políticas, porque o ganho financeiro justifica um maior investimento na produção.

O Deepfake de Voz de Rubio

Um clipe de áudio com voz clonada, falsamente atribuído ao Secretário de Estado dos EUA Marco Rubio, circulou no início de 2025, representando-o a fazer declarações inconsistentes com as posições oficiais da política externa americana. O clipe foi sinalizado pelo sistema de autenticação de voz da Pindrop e posteriormente analisado por várias equipas independentes de análise forense de áudio. A deteção baseou-se na análise espectral — os clones de voz produzem consistentemente artefactos em gamas de frequência específicas que os ouvidos humanos não registam mas que as ferramentas de visualização espectral tornam imediatamente visíveis. Este caso motivou pedidos renovados de normas de autenticação de voz nas comunicações políticas, incluindo da FCC, que já estava a desenvolver orientações na sequência da decisão sobre as chamadas automáticas com Biden em 2024.

Categoria 2: Imagens de Protestos e Conflitos Geradas por IA

As imagens de protestos e eventos de conflito geradas por IA representam um modelo de ameaça distinto dos vídeos deepfake: são mais baratas de produzir, mais difíceis de rastrear e exploram o momento de última hora em que a pressão de verificação é mais elevada e o ceticismo do público é mais baixo.

O Padrão dos Distúrbios no Reino Unido (Estabelecido em 2024, Continuado em 2025)

Durante os distúrbios no Reino Unido em agosto de 2024, imagens geradas por IA espalharam-se em poucas horas após incidentes reais — incluindo uma fotografia fabricada que mostrava falsamente agentes da polícia britânica a prostrar-se diante de um grupo muçulmano. A imagem foi identificada como gerada por IA por análise forense em 24 horas, mas já tinha sido partilhada centenas de milhares de vezes no X. A iteração de 2025 deste padrão — documentada em múltiplos contextos de protesto na Europa e na América do Norte — mostrou melhor qualidade de geração e inserção inicial mais rápida, sugerindo distribuição mais coordenada em vez de partilha orgânica. A documentação completa do caso está disponível na nossa entrada da base de dados sobre fotos de protestos geradas por IA.

As Imagens dos Protestos «No Kings»

Em junho de 2025, imagens geradas por IA representando celebridades como Taylor Swift e Travis Kelce em protestos políticos americanos circularam no Facebook e no X. A verificação do PolitiFact confirmou que nenhuma das pessoas estava presente nos eventos representados. As imagens utilizavam artefactos visuais consistentes — mãos anatomicamente distorcidas, gradientes de densidade de multidão implausíveis, texturas de céu com aparência sintética — que seriam evidentes numa inspeção cuidadosa, mas circulavam principalmente como miniaturas comprimidas em ecrãs de telemóvel onde esses detalhes são invisíveis. Este caso está documentado na nossa base de dados como exemplo do padrão de manipulação por proximidade com celebridades: associar uma figura pública reconhecida e de confiança a uma mensagem política através de imagens sintéticas para emprestar legitimidade percebida.

Manipulação da Cobertura de Catástrofes

Cada catástrofe natural significativa de 2025 foi acompanhada, em poucas horas, por imagens geradas por IA representando destruição fabricada ou exagerada. O AFP Fact Check e a BBC Verify documentaram este padrão consistentemente em eventos de cheias no Sul da Ásia, incêndios florestais na América do Norte e sismos na Ásia Central. O desfasamento de produção para geração de imagens por IA — agora medido em segundos — significa que as imagens sintéticas de catástrofes chegam às redes sociais antes da fotografia oficial da cena. As plataformas que tinham implementado a rotulagem de conteúdo por IA detetaram alguns casos; as que não o tinham feito detetaram muito poucos.

Categoria 3: Clones de Voz em Campanhas de Desinformação

A clonagem de voz é o vetor de engano por IA de crescimento mais rápido em 2025. As ferramentas disponíveis comercialmente — incluindo o ElevenLabs, o Voice Engine da OpenAI e várias alternativas de código aberto — podem produzir um clone de voz convincente a partir de apenas três segundos de áudio fonte. A taxa de ataques de deepfake baseados em voz aumentou mais de 1.300% entre 2023 e 2025, de cerca de um incidente por mês para mais de sete por dia, de acordo com o Relatório de Inteligência e Segurança de Voz de 2025 da Pindrop.

Campanhas de Chamadas Automáticas

Na sequência do precedente das chamadas automáticas com Biden em 2024, campanhas de chamadas automáticas com voz clonada visando eleitores surgiram em pelo menos seis países durante eleições ou referendos de 2025. A decisão da FCC de janeiro de 2024 que classifica as chamadas automáticas com voz de IA como ilegais ao abrigo da TCPA limitou — mas não eliminou — o seu uso nos EUA. Os casos internacionais enfrentaram quadros jurídicos inconsistentes: vários estados-membros da UE não tinham legislação específica abrangendo o conteúdo de voz gerado por IA antes de as disposições de transparência da Lei de IA da UE entrarem em vigor em 2026.

Burlas Telefónicas em Escala

O impacto mais prejudicial da clonagem de voz em 2025 não foi político mas financeiro. O Centro de Queixas de Crimes na Internet (IC3) do FBI documentou um aumento acentuado nas variantes da «burla do avô» usando vozes clonadas de familiares para solicitar transferências bancárias de emergência. Um inquérito publicado em 2026 estimou que 1 em cada 4 americanos tinha tido uma interação com uma voz deepfake no ano anterior — embora nem todas fossem burlas. As perdas financeiras decorrentes de fraude por clone de voz em 2025 foram estimadas em mais de 2,5 mil milhões de dólares apenas nos EUA.

Categoria 4: Portais de Notícias Inteiramente Sintéticos

O desenvolvimento estruturalmente mais preocupante de 2025 não foi um vídeo falso específico ou uma voz clonada, mas a proliferação de sites de notícias inteiramente gerados por IA — portais sem pessoal editorial humano, sem jornalistas reais e sem estruturas de responsabilização, produzindo um fluxo contínuo de conteúdo de aparência plausível concebido para ser indexado por motores de busca e recomendado por plataformas sociais.

Os Relatórios de Ameaças Adversariais da Meta de 2024 já tinham documentado portais de notícias sintéticos ligados a estados usando avatares de apresentadores de notícias em vídeo com IA. Em 2025, esta técnica já não estava limitada a atores estatais. A monitorização da NewsGuard identificou centenas do que denominam sites UAIN (Unreliable AI-Generated News — Notícias Geradas por IA Não Fiáveis) — domínios produzindo conteúdo inteiramente gerado por máquinas numa série de nichos políticos, monetizados através de publicidade programática. Estes sites tipicamente não fabricam factos individuais tanto quanto fabricam contexto: eventos reais descritos através de um enquadramento editorial consistentemente enganoso, sem processo de correção, sem assinaturas e sem metodologia declarada.

A rede «Pravda» documentada antes das eleições europeias de 2024 foi uma versão inicial deste modelo. Os seus sucessores de 2025 eram mais numerosos, mais sofisticados linguisticamente e mais difíceis de rastrear até aos atores de origem.

Deteção: Métodos Técnicos

A deteção técnica de deepfakes opera em três camadas: análise de artefactos, análise forense de metadados e verificação de proveniência. Nenhum método isolado é suficiente. Usados em conjunto, aumentam dramaticamente a precisão da deteção.

Análise de Artefactos Visuais

A geração atual de imagens e vídeos por IA produz consistentemente artefactos característicos: inconsistências nos limites faciais nas linhas do cabelo e nas margens das orelhas; mãos anatomicamente incorretas (dedos a mais, dígitos fundidos, ângulos de articulação implausíveis); reflexos oculares não naturais que não correspondem à iluminação da cena; e textura da pele renderizada com resolução inconsistente em toda a face. Estes artefactos nem sempre são visíveis ao tamanho de visualização normal, mas tornam-se evidentes com zoom a 200% ou ferramentas de aperfeiçoamento forense como Forensically (29a.ch) ou FotoForensics.

Para vídeo, as inconsistências temporais são igualmente reveladoras: geometria facial que não rastreia consistentemente entre fotogramas, taxas de pestanejo não naturais (os deepfakes treinados com dados de olhos abertos tendem a pestanejar pouco) e iluminação que muda entre cortes de formas inconsistentes com um único ambiente físico.

Análise de Metadados e EXIF

As fotografias autênticas incorporam metadados técnicos (dados EXIF) incluindo modelo de câmara, especificações de objetiva, carimbo de data/hora da captura e — quando os serviços de localização estavam ativos — coordenadas GPS. As imagens geradas por IA tipicamente têm dados EXIF eliminados ou ausentes, ou metadados genéricos inconsistentes com o dispositivo alegado. O Jeffrey’s Exif Viewer e o ExifTool (linha de comandos) disponibilizam ambos esta informação. Uma fotografia que alega documentar um evento ao vivo mas que não mostra dados GPS e tem um bloco EXIF genérico gerado por software justifica verificação imediata.

Análise Espectral de Áudio

Os clones de voz produzem artefactos em gamas de frequência específicas — particularmente acima dos 8kHz, onde os harmónicos naturais da voz se tornam irregulares na síntese. As ferramentas de espectrograma que visualizam a frequência do áudio ao longo do tempo (Audacity, iZotope RX, Adobe Audition) tornam estas anomalias visíveis. O sistema empresarial de autenticação de voz da Pindrop utiliza mais de 1.300 características acústicas para distinguir voz clonada de voz autêntica — um nível de sofisticação não disponível para utilizadores casuais, mas acessível a redações e organizações de monitorização eleitoral.

Pesquisa Inversa de Imagem e Vídeo

O primeiro passo mais simples e consistentemente eficaz continua a ser a pesquisa inversa de imagens: o Google Images, o TinEye e o Yandex Images conseguem localizar aparições anteriores de fotografias recicladas em segundos. Para vídeo, o plugin de browser InVID/WeVerify permite a extração fotograma a fotograma e a pesquisa inversa, tornando possível identificar material reciclado mesmo quando foi reeditado ou reenquadrado. Esta técnica não deteta conteúdo sintético recentemente gerado — deteta conteúdo autêntico mal representado, que continua a ser a maioria da desinformação em circulação.

Deteção: Métodos Jornalísticos

As ferramentas técnicas identificam artefactos. Os métodos jornalísticos estabelecem a proveniência — a cadeia de custódia documentada desde a criação até à publicação. A verificação da proveniência é a abordagem recomendada pelo método SIFT, coberto em detalhe no nosso guia de identificação de deepfakes.

Triangulação de Fontes

Nenhuma fonte isolada deve ser tratada como suficiente para verificar alegações de meios de comunicação sintéticos. A verificação cruzada requer no mínimo: a fonte original (quem publicou ou partilhou o conteúdo pela primeira vez?), uma segunda fonte independente com acesso direto ao evento ou pessoa representada, e uma organização de verificação terceira (Reuters Fact Check, AFP Fact Check, BBC Verify ou a mesa de verificação de factos da AP). Se duas das três não puderem ser confirmadas, o conteúdo deve ser tratado como não verificado independentemente da sua qualidade aparente.

Verificação de Contexto

Um deepfake tecnicamente indetetável pode ainda ser exposto através de inconsistência contextual. A equipa de investigação do MIT Media Lab — que realizou cinco experiências aleatorizadas pré-registadas com 2.215 participantes sobre a deteção humana de deepfakes de discurso político — concluiu que as transcrições de texto eram frequentemente suficientes para identificar implausibilidade, mesmo quando o áudio e o vídeo pareciam realistas. Verificar se as declarações representadas são consistentes com as posições documentadas do sujeito, o seu estilo de comunicação e a sua localização física no momento alegado é um passo de verificação fundamental que não requer quaisquer ferramentas técnicas.

Histórico de Domínio e Publicação

Para conteúdo de portais de notícias sintéticos: a data de registo WHOIS, o histórico do domínio via Wayback Machine e a verificação de assinaturas (os jornalistas listados têm histórias profissionais verificáveis fora do site?) são as três verificações rápidas mais fiáveis. As organizações noticiosas legítimas têm históricos de publicação que antecedem a história que está a ser partilhada. Os portais de notícias gerados por IA tipicamente mostram registo de domínio nos últimos 12 meses e assinaturas sem rasto de verificação externo.

A Resposta Regulatória: Lei de IA da UE e C2PA

Dois quadros paralelos estão a convergir para criar a primeira infraestrutura legalmente aplicável para a divulgação de meios de comunicação sintéticos: as obrigações de transparência da Lei de IA da UE e a norma técnica C2PA da Iniciativa de Autenticidade de Conteúdos.

Lei de IA da UE: Obrigações de Transparência do Artigo 50

O artigo 50 da Lei de IA da UE exige que os fornecedores de sistemas de IA que geram conteúdo de áudio, imagem, vídeo ou texto sintéticos marquem os resultados num formato legível por máquina detetável como artificialmente gerado ou manipulado. Os utilizadores devem divulgar quando a IA é utilizada para criar conteúdo sintético realista. Os deepfakes devem ser rotulados mesmo quando o conteúdo é lícito; apenas o conteúdo «evidentemente artístico, criativo, satírico ou ficcional» se qualifica para requisitos de divulgação reduzidos.

As obrigações de transparência ao abrigo do artigo 50 tornam-se aplicáveis a 2 de agosto de 2026. A Comissão Europeia publicou o primeiro projeto do Código de Práticas sobre marcação e rotulagem de conteúdo gerado por IA a 17 de dezembro de 2025, estabelecendo normas técnicas para marcação e metadados de proveniência antes da data de aplicação legal. As sanções por incumprimento chegam a 35 milhões de euros ou 7% da receita anual global — um nível destinado a criar pressão de conformidade nas principais plataformas e fornecedores de IA.

O âmbito territorial do regulamento estende-se para além das fronteiras da UE: qualquer empresa cujos sistemas de IA ou conteúdo sintético alcancem utilizadores da UE deve cumprir, independentemente de onde a empresa esteja sediada. Isto torna efetivamente a Lei de IA da UE uma norma global para as plataformas que alcançam audiências europeias.

Credenciais de Conteúdo C2PA

A Coligação para a Proveniência e Autenticidade de Conteúdos (C2PA), que inclui a Adobe, a Microsoft, a Google, a OpenAI, a Meta e as principais organizações noticiosas, desenvolveu uma norma técnica que incorpora metadados de proveniência com assinatura criptográfica em ficheiros de imagem, áudio e vídeo. As Credenciais de Conteúdo registam quem criou o conteúdo, que ferramentas foram utilizadas, que edições foram aplicadas e se a geração por IA esteve envolvida — criando uma cadeia de custódia inviolável desde a criação até à publicação.

A Adobe integrou o C2PA no Photoshop, Lightroom e Firefly. O YouTube adicionou etiquetas baseadas em proveniência em 2024. O Departamento de Defesa dos EUA publicou orientações em janeiro de 2025 recomendando a adoção do C2PA nas comunicações governamentais. O DALL-E 3 e o Sora da OpenAI incorporam metadados C2PA por padrão.

Uma limitação crítica: o C2PA verifica conteúdo autêntico — não deteta deepfakes. A ausência de metadados C2PA não significa que o conteúdo seja sintético; o conteúdo criado em dispositivos mais antigos ou com ferramentas que ainda não suportam a norma também não terá credenciais. Como a própria documentação da norma refere, a ausência de credenciais deve motivar maior escrutínio, não rejeição automática. Uma implementação C2PA completa fornece evidências fortes de proveniência; a sua ausência é uma ausência de provas, não uma prova de manipulação.

As implicações para a privacidade estão também em discussão ativa. Os metadados C2PA podem incluir carimbos de data/hora, geolocalização e históricos de edição. A investigação da Fortune publicada em setembro de 2025 documentou casos em que os metadados C2PA capturaram dados de localização que os criadores de conteúdo não tinham pretendido partilhar. A norma inclui disposições para eliminar metadados sensíveis antes da publicação, mas a consistência de implementação entre plataformas continua desigual.

O Que Esperar em 2026

Três desenvolvimentos irão moldar o panorama de desinformação gerada por IA ao longo de 2026 e além.

A aplicação começa. As disposições do artigo 50 da Lei de IA da UE tornam-se legalmente aplicáveis em agosto de 2026. Isto criará o primeiro teste em grande escala para avaliar se os requisitos regulatórios de divulgação conseguem abrandar a produção e distribuição de desinformação por meios de comunicação sintéticos. Os sinais de conformidade antecipada das principais plataformas são mistos: a Adobe, a Google e a OpenAI assumiram compromissos credíveis; os fornecedores de IA mais pequenos e as plataformas de distribuição estão menos preparados.

A corrida ao armamento na deteção continua. As capacidades de geração e deteção estão a evoluir em paralelo. A investigação do MIT Media Lab — e a literatura mais ampla — mostra consistentemente que nem os observadores humanos nem as ferramentas de deteção automatizada são fiáveis em todos os tipos de deepfakes. A combinação de julgamento humano e análise assistida por máquina supera qualquer um individualmente. As redações, os monitores eleitorais e as equipas de confiança e segurança das plataformas estão a investir em fluxos de trabalho de deteção híbridos; os consumidores individuais de meios de comunicação ficam, em grande medida, com as mesmas ferramentas que tinham em 2024.

A infraestrutura de verificação está a expandir-se, lentamente. O método SIFT, a adoção do C2PA e as redes de verificação de factos entre plataformas representam progressos genuínos. A capacidade de verificação do ecossistema mais amplo de literacia mediática — professores, bibliotecários, organizações cívicas — está a crescer através de oficinas e ferramentas como as cobertas no nosso guia de identificação de deepfakes. O fosso entre a capacidade de produção e a capacidade de verificação mantém-se amplo, mas já não se alarga tão depressa como em 2023.

Para os casos fundamentais que estabeleceram o atual panorama de ameaças — incluindo o deepfake da rendição de Zelensky e a vaga de fotos de protestos com IA de 2024 — o índice de verificação de factos e a base de dados de casos fornecem documentação completa com notas metodológicas.